Народ, видел сюда предлагают скидывать идеи на обсуждение. Так вот, чисто теоретически было ли бы вам интересно увидеть попытку реализацию модульной c2 платформы с gui на java?)

-

XSS.stack #1 – первый литературный журнал от юзеров форума

[ // XSSware] - конкурс проектов. Призовые 20.000$

- Автор темы admin

- Дата начала

- Статус

- Закрыто для дальнейших ответов.

Cobalt Strike?Народ, видел сюда предлагают скидывать идеи на обсуждение. Так вот, чисто теоретически было ли бы вам интересно увидеть попытку реализацию модульной c2 платформы с gui на java?)

Лучше, почти кобальт но опенсурс и с модулями на питоне и возможностью замутить в нем почти что угодноCobalt Strike?

Я думаю это заявка на призовое местоЛучше, почти кобальт но опенсурс и с модулями на питоне и возможностью замутить в нем почти что угодно

Я думаю крут будет то кто напишет реально крутой код для аудита смарт котракто! Заявка на успех!!!

Пожалуйста, обратите внимание, что пользователь заблокирован

Идея годная и я бы за такое проголосовал. Но с другой стороны, сделав такой код бесплатным, если он будет действительно хорошим, ты наплодишь очень много скрипткиддисов и вместо того чтобы дать людям интересные знания/концепт для интеграции в свои продукты, привлечёшь лишнее внимание к себе и к форуму. Ну и соответственно твой труд очень быстро убьют малолетние локерщики, которые даже приблизительно не понимают, как нужно вести себя с таким софтом. Всё начнет палитьсяНарод, видел сюда предлагают скидывать идеи на обсуждение. Так вот, чисто теоретически было ли бы вам интересно увидеть попытку реализацию модульной c2 платформы с gui на java?)

Я тоже над этим думал, и пришел к выводу, что я дам не полностью готовый для работы фреймворк. По сути, мой проект это просто очень удобная модульная система с собственным api, в которую можно засунуть все, что угодно. То есть он ближе к метасплоиту, чем к кобальту. Так вот, для того чтобы избежать всех этих проблем, я поделюсь именно клиентской частью. При желании люди могут писать собственные приватные плагины и скрипты, импланты, бэкдоры и даже эксплоиты.Идея годная и я бы за такое проголосовал. Но с другой стороны, сделав такой код бесплатным, если он будет действительно хорошим, ты наплодишь очень много скрипткиддисов и вместо того чтобы дать людям интересные знания/концепт для интеграции в свои продукты, привлечёшь лишнее внимание к себе и к форуму. Ну и соответственно твой труд очень быстро убьют малолетние локерщики, которые даже приблизительно не понимают, как нужно вести себя с таким софтом. Всё начнет палиться

А касательно внимания к форуму, я хотел презентовать этот проект как подарок самому форуму, так что ничего плохо не вижу в этом) Ну и наконец проект ещё в альфа версии, и дорабатываться будет долго

Пожалуйста, обратите внимание, что пользователь заблокирован

Главное, чтобы была нормальная модульность, а не просто подгруз автономных частей кода в память. Сколько смотрю на паблик малварь, никто не додумался как минимум при мапе длл в память передавать структурку с адресами функций для посылки отчетов ядру бота, которое крутится в том же процессе. Нужен будет полноценный СДК для разработки модулей на твоей платформе, примерно как у БОФов кобальта

good gesture. now with a taste of trojanforge. Up xss!

If ransomware is prohibited, how come the ransomware groups are still wandering on this forum?Прошу прощения, но это не проект. Это материал-статья. Хотя статья классная, интересно вышло.

Нет, ransom в чистом виде не принимаем. Ransomware на форуме запрещен.

They are not posting anything ransomware related. They are members of the forum like you and me.If ransomware is prohibited, how come the ransomware groups are still wandering on this forum?

А сделайте софт, чтобы с казика бабки выводились на мой Сбербанк Кидс по кнопке бабло, реально

Тогда уж сразу бота с автоматическим вбивом сс в шопы с апи системой под перекуп/прокси сервисы и анонимный конвертаром криптовалюты в валюту. Еще важно, чтобы принимал сс в любом форматеА сделайте софт, чтобы с казика бабки выводились на мой Сбербанк Кидс по кнопке бабло, реально

Некоторые из вас ищут идею, мне нужна помощь с проектом - https://xss.pro/threads/101947/

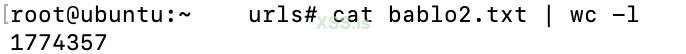

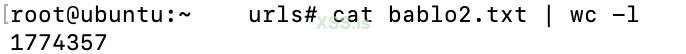

Бабло написан на го, краулер сам крут, но работает далеко не стабильно и я не в силах исправить. Я не надеюсь с этим занять первое место, но аналога такого краулера тоже нет, так что попрошу чтобы помогли, если какое то место займём то 50/50 само собой.

Что мне нужно (в основном):

Раз он такой кривой, почему он всё ещё в конкурсе?

Потому что я умудрился автоматизировать и нормально скраулил:

Я понимаю что звучит абсурдно.

Бабло написан на го, краулер сам крут, но работает далеко не стабильно и я не в силах исправить. Я не надеюсь с этим занять первое место, но аналога такого краулера тоже нет, так что попрошу чтобы помогли, если какое то место займём то 50/50 само собой.

Что мне нужно (в основном):

- Чтобы он останавливался после того как больше ссылок на краулинг не осталось

- Саппорт хидеров (чтобы можно было добавлять сразу несколько)

- Редирект, чтобы стоял как дефолт, а отключать можно было через такую опцию например -dr (disable redirect)

- Краулил только домен и его субдомены, а то из скопа выходит.

- Саппорт хромиум, это нужно чтобы парсил через уже загруженную страницу, а не просто через сорс код.

- Чтобы показывал стратистику во время краулинга, когда результат сохраняется в файле. Например: ./bablo -t 10 xss.pro -o xss.txt (пользователь будет видеть статистику, а в xss.txt будут ссылки)

- Поддержка проксей

Раз он такой кривой, почему он всё ещё в конкурсе?

Потому что я умудрился автоматизировать и нормально скраулил:

Код:

cat domains.txt | xargs -P10 -I{} timeout 300s bablo -t 100 '{}' >> bablo.txt

Я понимаю что звучит абсурдно.

Некоторые из вас ищут идею, мне нужна помощь с проектом - https://xss.pro/threads/101947/

Бабло написан на го, краулер сам крут, но работает далеко не стабильно и я не в силах исправить. Я не надеюсь с этим занять первое место, но аналога такого краулера тоже нет, так что попрошу чтобы помогли, если какое то место займём то 50/50 само собой.

Что мне нужно (в основном):

Что было бы прям идеально:

- Чтобы он останавливался после того как больше ссылок на краулинг не осталось

- Саппорт хидеров (чтобы можно было добавлять сразу несколько)

- Редирект, чтобы стоял как дефолт, а отключать можно было через такую опцию например -dr (disable redirect)

- Краулил только домен и его субдомены, а то из скопа выходит.

Учтите что вы это делаете не ради меня и не ради денег, а просто как поддержка форума, опен сорс проектов и вообще самой идеи.

- Саппорт хромиум, это нужно чтобы парсил через уже загруженную страницу, а не просто через сорс код.

- Чтобы показывал стратистику во время краулинга, когда результат сохраняется в файле. Например: ./bablo -t 10 xss.pro -o xss.txt (пользователь будет видеть статистику, а в xss.txt будут ссылки)

- Поддержка проксей

Раз он такой кривой, почему он всё ещё в конкурсе?

Потому что я умудрился автоматизировать и нормально скраулил:

Код:cat domains.txt | xargs -P10 -I{} timeout 300s bablo -t 100 '{}' >> bablo.txt

Я понимаю что звучит абсурдно.

Код:

package main

import (

"flag"

"fmt"

"net/http"

"net/url"

"os"

"strings"

"sync"

"time"

"github.com/gocolly/colly/v2"

)

func main() {

customTextDone := make(chan bool)

go displayCustomText(customTextDone)

<-customTextDone

threadCount := flag.Int("t", 1, "Number of threads")

headers := flag.String("h", "", "Request headers")

disableRedirect := flag.Bool("dr", false, "Disable redirect")

flag.Parse()

if flag.NArg() < 1 {

fmt.Println("Usage: go run main.go -t <threadCount> -h <header1: value1, header2: value2> -dr <URL>")

os.Exit(1)

}

startURL := flag.Arg(0)

var visitedURLs sync.Map

var wg sync.WaitGroup

var totalURLs int

urlQueue := make(chan string, 100000)

maxURLLength := 200

for i := 0; i < *threadCount; i++ {

wg.Add(1)

go func() {

defer wg.Done()

c := colly.NewCollector()

c.UserAgent = "Mozilla/5.0 (Macintosh; Intel Mac OS X 10.15; rv:109.0) Gecko/20100101 Firefox/119.0"

c.OnHTML("a[href]", func(e *colly.HTMLElement) {

href := e.Attr("href")

parsedURL, err := url.Parse(href)

if err != nil {

return

}

absURL := e.Request.AbsoluteURL(parsedURL.String())

// Check the URL length before processing

if len(absURL) <= maxURLLength {

if strings.HasPrefix(absURL, startURL) {

_, loaded := visitedURLs.LoadOrStore(absURL, true)

if !loaded {

urlQueue <- absURL

}

}

}

})

for url := range urlQueue {

fmt.Println(url)

c.Visit(url)

if totalURLs++; totalURLs >= 1000000 {

close(urlQueue)

return

}

}

}()

}

c := colly.NewCollector()

if *headers != "" {

headerList := strings.Split(*headers, ",")

for _, h := range headerList {

keyValue := strings.Split(h, ":")

if len(keyValue) != 2 {

fmt.Println("Invalid header format:", h)

os.Exit(1)

}

c.SetRequestHeaders(map[string]string{

strings.TrimSpace(keyValue[0]): strings.TrimSpace(keyValue[1]),

})

}

}

if *disableRedirect {

c.SetRedirectHandler(func(req *http.Request, via []*http.Request) error {

return http.ErrUseLastResponse // отключение редиректа

})

}

urlQueue <- startURL

wg.Wait()

}

func displayCustomText(customTextDone chan<- bool) {

customText := "Made with ˗ˋˏ ♡ ˎˊ˗ by GrozdniyAndy of xss.pro"

for i := 0; i <= len(customText); i++ {

fmt.Print("\r" + customText[:i] + "_")

time.Sleep(100 * time.Millisecond)

}

fmt.Print("\r" + customText)

time.Sleep(1000 * time.Millisecond)

customTextDone <- true

fmt.Println("")

}В первую очередь, вам нужно добавить проверку, чтобы программа останавливалась, когда больше нет ссылок для краулинга. Для этого вы можете добавить проверку, когда urlQueue закрывается:

Код:

for url := range urlQueue {

fmt.Println(url)

c.Visit(url)

if totalURLs++; totalURLs >= 1000000 {

close(urlQueue)

return

}

}

Код:

headers := flag.String("h", "", "Request headers")

flag.Parse()

if *headers != "" {

headerList := strings.Split(*headers, ",")

for _, h := range headerList {

keyValue := strings.Split(h, ":")

if len(keyValue) != 2 {

fmt.Println("Invalid header format:", h)

os.Exit(1)

}

c.SetRequestHeaders(map[string]string{

strings.TrimSpace(keyValue[0]): strings.TrimSpace(keyValue[1]),

})

}

}По умолчанию, редирект включен. Чтобы добавить возможность отключить редирект, вы можете добавить флаг -dr и передавать его значение в метод SetRedirectHandler:

Код:

disableRedirect := flag.Bool("dr", false, "Disable redirect")

flag.Parse()

if *disableRedirect {

c.SetRedirectHandler(func(req *http.Request, via []*http.Request) error {

return http.ErrUseLastResponse // отключение редиректа

})

}Наконец, чтобы ограничить краулинг только на домене и его субдоменах, вы можете использовать метод strings.HasPrefixдля проверки наличия домена в URL:

Код:

if strings.HasPrefix(absURL, startURL) {

_, loaded := visitedURLs.LoadOrStore(absURL, true)

if !loaded {

urlQueue <- absURL

}

}Это ИИ, если что

Последнее редактирование:

Если хочешь, доработай, скинь в готвой форме и будет 50/50. Без разницы как пишешь, главное чтобы работало.Это ИИ, если что

хорошо я попробуюЕсли хочешь, доработай, скинь в готвой форме и будет 50/50. Без разницы как пишешь, главное чтобы работало.

- Автор темы

- Добавить закладку

- #98

Ребята, напишите кто-то на конкурс Tox клиент (под toxcore). Желательно, нечто более безбажное, чем qTox/µTox.

автоботы подъемТогда уж сразу бота с автоматическим вбивом сс в шопы с апи системой под перекуп/прокси сервисы и анонимный конвертаром криптовалюты в валюту. Еще важно, чтобы принимал сс в любом формате

- Статус

- Закрыто для дальнейших ответов.