Хм, выходит, что кто-то, встал после 11 утра, зашел на сервер и выключил парсинг онлайн форума в 12.09.2021 в 11:40 , написал админу и позднее,

запостил и топик об этом. Админ же, несмотря на его постоянную занятость и нескорые ответы, ответил спустя ровно 34 минуты - что он в курсе т.к. они с автором уже предварительно говорили об этом.

Когда мета-данные превращаются в данные - из них можно снова извлечь мета данные! Но без отдела дата саентистов которым платят зп не просто так - не обойтись.

А по делу, мне бы тоже хотелось бы от степаныча узнать что-то новенькое, но врядли это будет. Но начну набрасывать первым, надеюсь вызов будет принят.

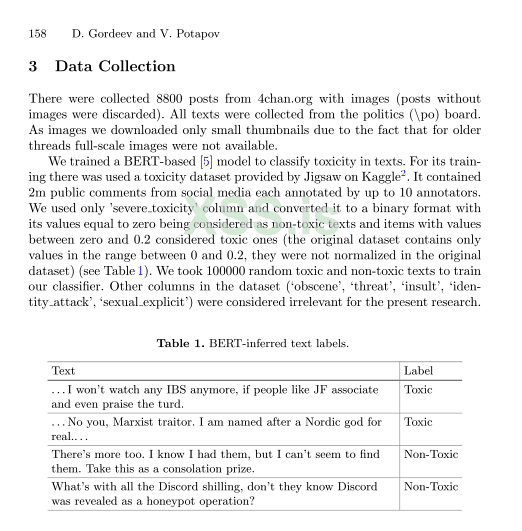

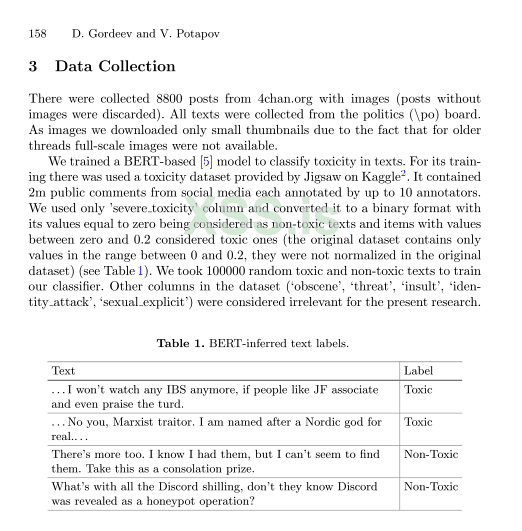

Чтобы чему-то обучить нейронку, нужно сперва собрать датасет и его разметить. Например вот методология сбора и разметки датасета комментариев на степень токсичности.

Подобный датасет( правда комменты тут с википедии ) можно скачать здесь: https://www.kaggle.com/c/jigsaw-toxic-comment-classification-challenge/data

Там же и был объявлен конкурс а 35к$ на самую лучшую модельку по определению токсичности.

А про граф модель построения текстов, нлп и маркова, не надо рассказывать, приведите пример. На форуме это очень маленькие данные, в теории можно собрать все сообщения и скормить их анализатору собрать их в пачки по похожести, да и самообучающуюся нейроку сделать, которая сама себя будет проверять по авторству этих сообщений. Но хз какой будет результат. Было бы интересно, чтобы пытливые умы потестили, а не работали на датасет))

Автору топика респект, кстати

запостил и топик об этом. Админ же, несмотря на его постоянную занятость и нескорые ответы, ответил спустя ровно 34 минуты - что он в курсе т.к. они с автором уже предварительно говорили об этом.

Когда мета-данные превращаются в данные - из них можно снова извлечь мета данные! Но без отдела дата саентистов которым платят зп не просто так - не обойтись.

А по делу, мне бы тоже хотелось бы от степаныча узнать что-то новенькое, но врядли это будет. Но начну набрасывать первым, надеюсь вызов будет принят.

Чтобы чему-то обучить нейронку, нужно сперва собрать датасет и его разметить. Например вот методология сбора и разметки датасета комментариев на степень токсичности.

Подобный датасет( правда комменты тут с википедии ) можно скачать здесь: https://www.kaggle.com/c/jigsaw-toxic-comment-classification-challenge/data

Там же и был объявлен конкурс а 35к$ на самую лучшую модельку по определению токсичности.

Таким же макаром, можно собрать датасет из сообщений на форуме и разметить его по степени угрозы или еще чего. Ваши предложения принимаются, кстати, ибо сходу не придумать что толковое. Тут вживую не понятно кто че из себя представляет.In this competition, you’re challenged to build a multi-headed model that’s capable of detecting different types of of toxicity like threats, obscenity, insults, and identity-based hate better than Perspective’s current models. You’ll be using a dataset of comments from Wikipedia’s talk page edits. Improvements to the current model will hopefully help online discussion become more productive and respectful.

А про граф модель построения текстов, нлп и маркова, не надо рассказывать, приведите пример. На форуме это очень маленькие данные, в теории можно собрать все сообщения и скормить их анализатору собрать их в пачки по похожести, да и самообучающуюся нейроку сделать, которая сама себя будет проверять по авторству этих сообщений. Но хз какой будет результат. Было бы интересно, чтобы пытливые умы потестили, а не работали на датасет))

Автору топика респект, кстати