Шодан теперь по страницам. К примеру 100кредитов = 100 страниц вроде.Shodan API KEY : запросов там нормальное количество доступно! пользуйтесь

Скрытое содержимое

-

XSS.stack #1 – первый литературный журнал от юзеров форума

Elasticsearch/MongoDB | Поиск открытых баз в интернете

- Автор темы amstrot

- Дата начала

Пожалуйста, обратите внимание, что пользователь заблокирован

можно подробнее?Шодан теперь по страницам. К примеру 100кредитов = 100 страниц вроде.

ключ апи для работы с cli выше выставил

можно подробнее?

https://help.shodan.io/the-basics/credit-types-explained1 export credit lets you download up to 10,000 results

1 query credit lets you download 100 results

The Shodan Membership includes 20 export credits.

P.s. Пока, что максимум, что удалось набрутить это Member: yes | Credit: 100

Последнее редактирование:

Пожалуйста, обратите внимание, что пользователь заблокирован

как раз я про апи и писал. данные запросы считаются по скачке с апишки =)https://help.shodan.io/the-basics/credit-types-explained

P.s. Пока, что максимум, что удалось набрутить это Member: yes | Credit: 100

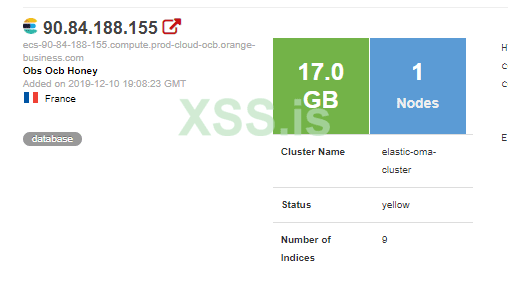

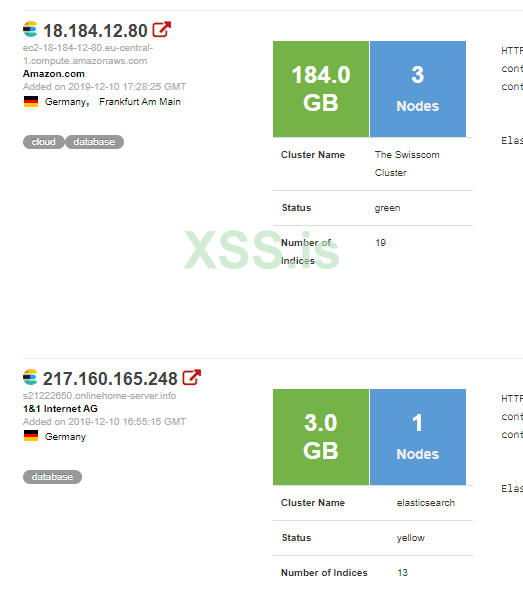

Кто разбирается в Elasticsearch, такой вопрос.

В индексах по линке .../indexname/_search?size=500 бывает содержится не мало Мб а то и Гб информации. Обычным запросом через браузер можно вывести максимум .../_search?size=10000 инфы. Сообственно вопрос, как можно скачать весь индекс? Есть одна прога для винды - Kaizen, как раз для этого, только очень глючная и при скачивании индекса почти сразу выдает ошибку.

Буду рад услышать любые соображения по данному вопросу.

В индексах по линке .../indexname/_search?size=500 бывает содержится не мало Мб а то и Гб информации. Обычным запросом через браузер можно вывести максимум .../_search?size=10000 инфы. Сообственно вопрос, как можно скачать весь индекс? Есть одна прога для винды - Kaizen, как раз для этого, только очень глючная и при скачивании индекса почти сразу выдает ошибку.

Буду рад услышать любые соображения по данному вопросу.

eshyo huje kogda etot ara nachinaet svoe mnenie pisat kasatelno teh ili inih situciiДрузья, отличная тема! Очень здравая идея,amstrot

Я всячески готов поддерживать такие инициативы. Просто ситуация сейчас с открытыми базами такая. Их много, они есть и это ОЧЕНЬ интересный способ получать свежие и порой отличные базы данных.

Меня очень парит то, что белые компании, например "DeviceLock" очень оперативно их находят, и сливают информацию как баг репорт, т.е. после них - как потоп. Сами скачали - остальным хрен. Надо создать инициативную группу людей, которая готова развернуть все требующиеся скрипты и мониторить ситуацию, сливать базы, а дальше - не наши проблемы.

Ко мне сразу возникнет вопрос, если ты такой умный, чё сам не сделал???

Я реально зарываюсь со своей БД из этой темы:

http://xssforum7mmh3n56inuf2h73hvhnzobi7h2ytb3gvklrfqm7ut3xdnyd.onion/threads/26244/#post-145844это постоянная работа по обработке и заливу информации, постоянная, день и ночь. Без шуток, в квартал, параллельно с задачами в реале я лью около 700 млн. "хороших" записей в базу. Плюс большие проекты по сбору информации с некоторых сайтов. Я честно, физически не могу взять на себя такую задачу. Поэтому у меня будет чем с вами поделиться, это не одностороннее сотрудничество будет. Плюс как обычно, я складываю исключительно в базу и на этом "жизнь" базы у меня заканчивается. НИКОГДА она не продаётся, не спамится и тд. А вы делайте что хотите с ней)

Более подробное видение ситуации я ещё изложу в теме, где расскажу своё видение развития раздела БД. Кому вообще интересна эта тема - отпишитесь в теме, дайте о себе знать. Высказывайте свои мысли.

tema horoshaya. inogda perepadaet toje shtoto iz shodana. vstanu blije k kormushke.

m00r, куда делась твоя кириллица? Раньше же писал на ней...

spsЕщё пример поиска: blockchain product:"CouchDB"

Здесь пример работы с этим продуктом

m00r, куда делась твоя кириллица? Раньше же писал на ней...

eto vsyo linuks, izvinite))

Шодан теперь по страницам. К примеру 100кредитов = 100 страниц вроде.

zaca$hirovali))

Пишите подробный мануал как сдампить:

elastic

mongo

couch

Желательно:

виндоуз

консолька

выбор БД, столбцов

в идеале сразу в .sql формат

в идеале клиент типа Navicat

elastic

mongo

couch

Желательно:

виндоуз

консолька

выбор БД, столбцов

в идеале сразу в .sql формат

в идеале клиент типа Navicat

Как исследователи обнаруживают открытые базы данных MongoDB и Elasticsearch

#Полезное Какое-то время назад среди исследователей безопасности было очень «модно» находить неправильно сконфигурированные облачные хранилища AWS с разного рода конфиденциальной информацией. Однако, время идет и акцент в исследовательских изысканиях сместился на поиск оставленных в открытом...

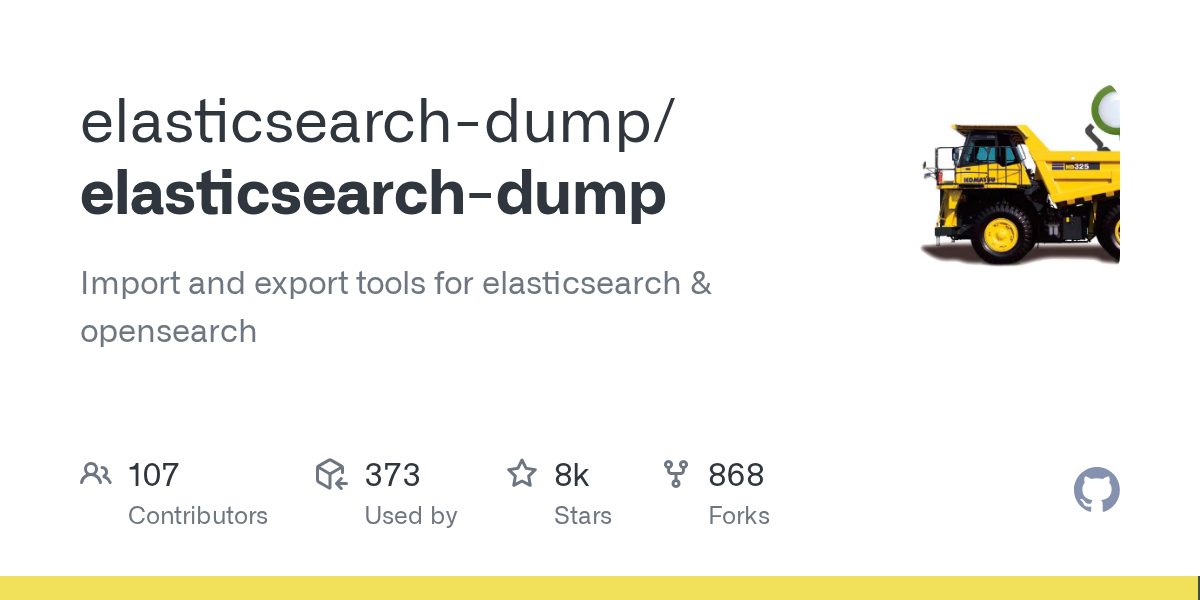

Нашел прогу а может и не то совсем, для дампа индексов Elasticsearch, только не знаю как юзать. Знающие люди, помогите разобраться.

github.com

github.com

GitHub - elasticsearch-dump/elasticsearch-dump: Import and export tools for elasticsearch & opensearch

Import and export tools for elasticsearch & opensearch - elasticsearch-dump/elasticsearch-dump

The best tool I have found and ez mode https://github.com/Ibonok/elastic_scan good luck brothers.

Похоже на тестовые данные.

Письма являются поддельными

Пожалуйста, обратите внимание, что пользователь заблокирован

elastic, mongo, couchdb, rsync, sonarqube, jenkins, gitlab, kibana, cassandra, rethinkdb в одном флаконе, nohup + >> output.txt, и забирай каждый день кучу всего полезного, дает отчет о названии баз их размере и тд..

github.com

github.com

были мысли по эластику, поставить его на хороший сервер, с возможностью добавления в конфиге других эластиков, для поиска сразу по всем эластикам. Если есть энтузиасты, мог бы помочь. Эластик хорошо и с монгой будет работать да и вообще с чем угодно. Кормим список открытых доступов, получаем возможность искать внутри с веб морды.

GitHub - woj-ciech/LeakLooker: Find open databases - Powered by Binaryedge.io

Find open databases - Powered by Binaryedge.io. Contribute to woj-ciech/LeakLooker development by creating an account on GitHub.

были мысли по эластику, поставить его на хороший сервер, с возможностью добавления в конфиге других эластиков, для поиска сразу по всем эластикам. Если есть энтузиасты, мог бы помочь. Эластик хорошо и с монгой будет работать да и вообще с чем угодно. Кормим список открытых доступов, получаем возможность искать внутри с веб морды.

Последнее редактирование:

Пожалуйста, обратите внимание, что пользователь заблокирован

все очень просто, указываем url и индекс который хотим забрать в input, в output название файла.Нашел прогу а может и не то совсем, для дампа индексов Elasticsearch, только не знаю как юзать. Знающие люди, помогите разобраться.

GitHub - elasticsearch-dump/elasticsearch-dump: Import and export tools for elasticsearch & opensearch

Import and export tools for elasticsearch & opensearch - elasticsearch-dump/elasticsearch-dumpgithub.com

elasticdump --input=http://production.es.com:9200/my_index --output=query.json --type=data

Последнее редактирование:

А никто не юзал Clickhouse вместо эластика? Спецы говорят, что прирост скорости несколько сотен процентов.

Пожалуйста, обратите внимание, что пользователь заблокирован

ну клик дампится очень быстро ) за короткое время помню 300-400 гигов дампил без проблемА никто не юзал Clickhouse вместо эластика? Спецы говорят, что прирост скорости несколько сотен процентов.

Пожалуйста, обратите внимание, что пользователь заблокирован

Пожалуйста, обратите внимание, что пользователь заблокирован

Не могу подключица по таймауту. Мб у вас получиться. Интересно, что там.

У вас должно быть более 5 реакций для просмотра скрытого контента.

account_index

docs count 15.753.492

docs count 15.753.492