Автор: hipeople

Источник https://xss.pro

Рад снова всех приветствовать!

В прошлых статьях я уже рассказывал про использование антидетект-браузеров статья про Firefox , статья про Chorme часть 1, часть 2 (правда, часть про Tor ещё впереди - думаю, это будет моя следующая статья после этой) и в целом про настройку приватности на уровне Linux.

Теперь я хочу продолжить тему приватности и поговорить о безопасности сети на Linux. Многие думают, что для приватности достаточно просто настроить цепочку VPN -> Tor -> VPN, менять MAC-адрес и, может, подкрутить свой DNS. Но на деле всё далеко не так просто.

Есть распространённое заблуждение, что приватность и безопасность сети никак не связаны друг с другом, но я с этим не согласен. Потому что, если любой злоумышленник может легко вас взломать или обойти шифрование, то о какой приватности может идти речь? Так что без защиты сети приватность невозможна. В этой статье я подробно расскажу, какие есть методы для приватности в сети, как их можно автоматизировать, а также напишу пару инструментов для этого. Погнали разбираться!

Как составить модель угроз для сети?

Прежде чем перейти к методам защиты, важно разобраться, кто может угрожать твоей сети и какие атаки чаще всего можно ожидать. Это необходимо, чтобы ты мог составить свою модель угроз и с умом использовать методы, описанные в статье.

Какие бывают противники?

Если говорить о противниках, то они бывают разные, и каждый из них несёт свои риски. Начиная с школьника, который хочет тебя взломать ради забавы, или твоего интернет-провайдера, который просматривает трафик, заканчивая корпорациями, которым нужны твои данные, или государством, которое, хоть и редко интересуется конкретными людьми, но в случае его внимания стоит ждать беды. У каждого из этих злоумышленников есть свои цели, методы и угрозы. Поэтому в этом разделе я подробно расскажу, что каждый из них может сделать и какие риски это понесёт для твоей приватности. Но помни: ты можешь столкнуться и с другими, уникальными для тебя угрозами, поэтому подходи к созданию модели угроз с учётом своего случая.

Интернет-провайдеры

Начнём с интернет-провайдеров. Они видят весь твой трафик и могут получить к нему доступ, если он не зашифрован. Провайдеры обычно собирают метаданные: какие сайты ты посещаешь, сколько времени на них проводишь и какой объём данных скачиваешь. Даже при использовании HTTPS они знают IP-адреса серверов, с которыми ты соединяешься, а через незашифрованные DNS-запросы - точные домены. Благодаря этим данным они создают твой профиль, который потом могут продать рекламщикам или передать властям. Хуже того, при необходимости провайдер может подменять DNS-ответы, перенаправив тебя на фишинговый сайт. Более того, при необходимости провайдер может подменять DNS-ответы, перенаправляя тебя на фишинговый сайт. Он также может блокировать VPN или Tor, применяя DPI - глубокий анализ пакетов, чтобы определить используемые тобой протоколы.

А, как ты понимаешь, если VPN внезапно отключается, твой реальный IP сразу засветится в логах, что на руку злоумышленникам. Потому что это открывает прямой путь к твоему реальному местоположению и, возможно, личности.

Вот пример реального кода из библиотеки nDPI (от ntop), которая использует DPI для обнаружения трафика OpenVP. Это фрагмент из файла src/lib/protocols/openvpn.c (на основе коммита в репозитории GitHub).

Сам код:

Это функция ndpi_search_openvpn, которая в составе библиотеки nDPI анализирует пакеты, чтобы вычислить, принадлежат ли они OpenVPN. Сначала она берёт текущий пакет из структуры потока. Если это UDP или TCP (OpenVPN работает через оба), и длина полезной нагрузки не меньше 14 байт, начинается разбор. Из первого байта пакета выдираются opcode (старшие 5 бит) и key (младшие 3 бита). Если opcode - это один из кодов начального рукопожатие OpenVPN (типа P_CONTROL_HARD_RESET_CLIENT_V1 или V2), а key равен нулю, проверяется длина пакета: байты 1-2 должны совпадать с фактической длиной минус 14. Если всё сходится, функция пишет в лог "found OpenVPN" и помечает поток как OpenVPN. Если после 5 пакетов ничего не нашлось, поток исключается из анализа, чтобы не тратить время.

Методы, описанные выше, обычно подходят для выявления VPN-протоколов, таких как WireGuard или OpenVPN, как показано в примере.

Однако для Tor чаще используется подход, основанный на проверке списка IP-адресов exit-нод. Для примера как это работает, я написал псевдокод, который обнаруживает Tor-трафик. Я написал на основе метода из интересной, хотя и старенькой статьи 2016 года, посвящённой поиска трафика Tor: ссылка на статью.

Сам псевдокод:

Код работает так: функция detect_tor_traffic анализирует входящий пакет, проверяя, является ли он TLS-рукопожатием. Если да, она извлекает структуру ClientHello и смотрит на набор шифров (cipher_suites). Tor использует специфический набор шифров, который можно сопоставить с известным паттерном. Далее проверяется поле server_name в расширениях ClientHello - Tor часто использует домены вида www.[случайная_строка].[com|net] для мостов. Если имя сервера подходит, код извлекает сертификат и проверяет, соответствует ли его субъект (issuer или commonName) шаблону имени сервера. При совпадении всех условий соединение логируется как Tor, а IP-адрес назначения блокируется. Если хоть одна проверка не проходит, возвращается false.

Для полноты картины приведу пример, как провайдер (или любой, у кого есть доступ к сети) может перехватывать DNS-запросы с помощью Python и библиотеки Scapy:

Код запускает сниффер, который отслеживает DNS-запросы на порту 53. Если ты не используешь шифрование DNS (например, DNS-over-HTTPS), провайдер легко увидит все запрашиваемые тобой домены и сможет построить твой профиль без особых усилий. Это может привести к таргетированной рекламе или, что хуже, к передаче данных властям, если ты посещаешь запрещённые сайты.

Локальные злоумыленники

Теперь про локальных атакующих в публичных Wi-Fi, вроде кафе или аэропортов. Эти ребята обожают перехватывать незашифрованный трафик. Даже если ты сидишь через HTTPS, они могут ловить метаданные: IP-адреса, объём трафика, временные метки. А если ты по глупости отправляешь файлы с метаданными (например, фотки с геолокацией), то отдаёшь им информацию о себе на блюдечке. Хуже того, они могут подменять DNS или запускать фишинговые атаки, перенаправляя тебя на поддельные сайты, чтобы украсть пароли. Приватность тут страдает моментально: твои действия в сети становятся открытой книгой, а в худшем случае - это кража данных или доступ к твоим аккаунтам. Вот пример, как хакер может перехватить трафик в локальной сети, используя scapy:

Этот код перехватывает TCP-пакеты в локальной сети (например, через Wi-Fi-интерфейс wlan0). Если ты не используешь VPN или HTTPS, хакер увидит содержимое твоего трафика, а даже с HTTPS - метаданные, такие как IP и объём данных. Это может выдать твои привычки, а в случае утечки метаданных файлов - точное местоположение.

Государственные структуры

Гос-структуры обладают гораздо большими возможностями, чем интернет-провайдеры, и их методы сбора данных значительно шире. Всё, что могут делать провайдеры - перехватывать DNS-запросы, собирать метаданные, подменять DNS-ответы или блокировать VPN и Tor с помощью DPI, - доступно и государственным структурам. Но их инструментарий этим не ограничивается. Если ты не привлёк их внимания, достаточно базовых мер защиты: шифрования, VPN или Tor. Однако если ты на их радаре, уклонение становится крайне сложным.

Государства могут анализировать трафик через DPI для выявления протоколов, таких как Tor или VPN, а также проводить атаки на инфраструктуру. Например, они способны подменять HTTPS-сертификаты через компрометацию центров сертификации или внедрять вредоносное ПО через уязвимости в устройствах и программах. Также они могут использовать социальную инженерию для доступа к твоим данным или проводить корреляционные атаки на Tor, сопоставляя время входа и выхода трафика через контролируемые ноды.

Помимо методов, зависящих от провайдеров, гос структуры могут перехватывать метаданные напрямую через глобальные системы мониторинга на магистральных интернет-каналах, минуя провайдеров. Они способны внедрять шпионское ПО, вроде Pegasus, через уязвимости в смартфонах или компьютерах, чтобы собирать сообщения, звонки и геолокацию.

Вот пример, который имитирует базовый мониторинг трафика на магистральном уровне (анализ заголовков пакетов для сбора метаданных, таких как IP и порты):

Код работает так: функция monitor_backbone_traffic принимает пакет, захваченный Scapy, и проверяет, есть ли в нём IP-слой. Если да, она вытаскивает исходный и целевой IP-адреса. Затем проверяет, есть ли TCP или UDP слой, и определяет протокол, а также порты отправителя и получателя. Если ни TCP, ни UDP нет, порты остаются "N/A", а протокол - "Unknown". Метаданные выводятся в консоль в формате источник:порт -> назначение:порт (протокол). Функция sniff запускает захват 20 IP-пакетов на интерфейсе eth0, передавая каждый в monitor_backbone_traffic.

Корпорации

Корпорации вроде Google или производителей роутеров могут шпионить за твоей сетью через прошивку устройств, собирая данные о том, какие сайты ты посещаешь, какие устройства подключаются и какие DNS-запросы делаешь. Всё это отправляется на их серверы, чтобы строить твой профиль для рекламы или продавать данные третьим лицам. Это бьёт по приватности, ведь по IP, MAC-адресу или времени активности можно понять, что ты делал в сети.

Я написал два Python-скрипта, чтобы показать, как роутер может собирать такие данные и отправлять их на сервер.

Пример клиента:

Этот код притворяется роутером, который следит за трафиком. Он использует Scapy, чтобы собирать IP-пакеты на интерфейсе eth0. Для каждого пакета собираются данные: IP-адреса отправителя и получателя, протокол (TCP, UDP или другой), порты и время. Эти данные в формате JSON летят на сервер по адресу http://hasker.com:8080/collect через POST-запрос.

Пример сервера:

Сервер работает на 0.0.0.0:8080 через Flask и принимает POST-запросы с данными от роутера. Он выводит полученные метаданные - IP, порты, время - в консоль и сохраняет их в файл router_data.json. Это как база данных производителя, где хранится всё о твоей сети для анализа или продажи.

Мессенджеры

Дальше перейдём к локальным приложениям и мессенджерам. Многие программы, такие как Telegram, Discord или даже офисные пакеты, активно собирают телеметрию: данные о том, какие функции ты используешь, сколько времени приложение остаётся открытым, какие файлы ты отправляешь. Мессенджеры передают метаданные о чатах (время сообщений, IP-адрес при подключении), а иногда логируют онлайн-статус или список контактов. Если приложение не использует надёжное шифрование, хакер или даже разработчик может получить доступ к твоим сообщениям или файлам. Даже "безопасные" мессенджеры вроде Signal рискуют раскрыть твой IP через P2P-соединения во время звонков, если они не очень хорошо настроены

Вот пример, как приложение может собирать телеметрию:

В примере, функция collect_telemetry собирает инфу о приложении - его название, какая функция использовалась (например, отправка сообщения), сколько секунд это заняло, и точное время. Всё это пакуется в JSON и отправляется на сервер https://telemetry.example.com/log через POST-запрос. Если всё проходит, в консоль выводится код ответа сервера, например 200, а если что-то ломается - ошибка. В реальной жизни мессенджеры вроде WhatsApp или Telegram могут слать ещё и твой IP, модель телефона или геолокацию, чтобы связать твои действия в профиль.

Еще качестве примера приведу Telegram: в нем IP-адреса обрабатываются в модулях для P2P-звонков (tgcalls), и используются для прямого соединения, что может привести к раскрытию IP-адреса собеседника. Однако Telegram добавил опции для ограничения P2P-соединений (например, только для контактов или полное отключение), чтобы уменьшить риски.

Я нашел старый скрипт на GitHub, который использовал эту уязвимость и собирал IP-адреса пользователей через анализ пакетов во время P2P-аудиозвонков с помощью библиотеки pyshark.

Вот отрывок скрипта из репозитория, где собирались данные:

Код работает так: функция collect_telemetry собирает данные о приложении - его имя, используемую функцию (например, отправка сообщения) и время работы в секундах, плюс метку времени через time.time(). Эти данные пакуются в JSON и отправляются POST-запросом на сервер https://telemetry.example.com/log. Если запрос успешен, выводится код ответа (например, 200), иначе - сообщение об ошибке. В реальной жизни приложение вроде мессенджера может собирать больше: твой IP, устройство, геолокацию, и всё это уходит на серверы для анализа.

Обычный взлом ради денег

И напоследок самый банальный, но не менее опасный тип противников - злоумышленники, обычные люди, которые охотятся за твоими данными ради наживы. Эти ребята используют всё, что попадётся под руку: сниффинг трафика в публичных Wi-Fi, фишинг, основанный на утёкших метаданных, вроде твоей активности, или социальную инженерию. Потеря приватности здесь грозит кражей денег, или шантажом. Помимо банального создания поддельных Wi-Fi-сетей, такие злоумышленники часто сканируют порты, чтобы найти уязвимые службы, вроде SSH или веб-серверов, перехватывают пароли, подменяя ARP-таблицы и перенаправляя трафик через себя, или подделывают DNS-ответы, чтобы заманить тебя на фишинговый сайт. Ещё они могут ломать слабые протоколы, такие как старые версии SMB, чтобы залезть в твою сеть.

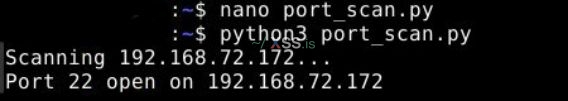

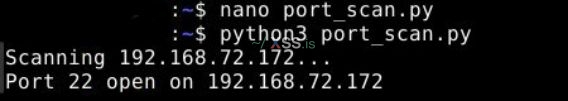

Первым я покажу, пример сканирования портов с библиотекой socket. Код просто ищет открытые порты на хосте, он простой, и обычно для таких дел испольуют Nmap.

Пример кода:

i

Проверяем:

Код работает так: функция scan_port берёт хост и порт, создаёт TCP-сокет, устанавливает таймаут 0.5 секунды и пытается подключиться через connect_ex. Если подключение удаётся (код возврата 0), порт открыт, и это выводится в консоль. Функция port_scan сканирует хост, проходя по списку портов (22 - SSH, 80 - HTTP, 443 - HTTPS, 3389 - RDP).

Ещё покажу пример ARP-спуфинга с помощью Scapy. Код подменяет ARP-таблицы, чтобы трафик жертвы шёл через хакера, позволяя перехватить пароли или данные, если они не зашифрованы.

Пример кода:

Функция arp_spoof берёт IP жертвы, IP шлюза и интерфейс (например, eth0). Она узнаёт MAC-адреса жертвы и шлюза через getmacbyip. Затем создаются два ARP-пакета: один говорит жертве, что атакующий - это шлюз, другой - шлюзу, что атакующий - это жертва. Эти пакеты отправляются каждую секунду через send, чтобы подменить ARP-таблицы. Трафик жертвы начинает идти через атакующего, позволяя перехватывать данные.

И напоследок покажу код для подмены DNS-ответов на Scapy. Он перехватывает DNS-запросы и подсовывает фишинговый IP.

Пример кода:

Код работает так: функция dns_spoof перехватывает пакеты на интерфейсе eth0 с помощью sniff, фильтруя только UDP-запросы на порт 53 (DNS). Если пакет содержит DNS-запрос, код вытаскивает домен из запроса и формирует фальшивый ответ. Ответный пакет строится с перевёрнутыми IP (источник и назначение меняются местами), UDP-портами и DNS-секцией, где qr=1 (ответ), aa=1 (авторитетный), а an содержит поддельный IP 192.168.1.100 для запрошенного домена с TTL 100. Пакет отправляется через send, и в консоль пишется, что подмена удалась.

Как составить модель угроз?

Всё, что я описал выше, - это лишь примеры атак, на самом деле их гораздо больше. Но даже эти примеры показывают, насколько важна защита сети. В конце этого раздела дам несколько советов, как составить свою модель угроз.

Для начала нужно определиться, что именно вы хотите защитить: данные, местоположение или свою приватность. Затем подумайте, кто ваши потенциальные противники: корпорации, провайдеры, государственные структуры и т.д. После выбора противника оцените его возможности, на что он готов пойти и какие это влечёт. И только после этого начинайте выстраивать защиту.

При выстраивании защиты важно учитывать не только сложные технические методы, но и не упускать из виду человеческий фактор. Часто людей ловят на простых вещах, например, через старую электронную почту, которая привязана к аккаунтам на форуме, или из-за лишней информации, которой человек сами поделился.

Кроме того, очень важно периодически обновлять методы защиты, потому что со временем появляются новые виды атак, и существующая защита уже может стать не актальной.

Методы защиты сети

Когда я рассказл про возможные угрозы, самое время поговорить о защите сети. В этом разделе я расскажу, как обезопасить свою сеть и повысить свою приватности, начиная с простых методов и постепенно переходя к более сложным. Чтобы не перегружать статью, я не стану останавливаться на очевидных вещах, вроде настройки файрвола, использование Tor или установка простого VPN-приложения. Вместо этого я сосредоточусь на более интересных аспектах, например, настройке тех же протоколов VLESS или VMess. Не буду затягивать с предисловием - начнём!

Закрытие ненужных портов

Хоть я и говорил, что банальностей не будет, начну с основ: закрывайте ненужные порты. Многие почему-то забывают об этом на своём обычном компе, а не на сервере. Например, ставят какую-то фичу, используют её разок, а порт оставляют открытым. А ведь это лишний вектор для атак. Поэтому стоит иногда себя перепроверять и держать активным только то, что реально нужно. Если вообще что-то нужно.

Чтобы проверить все используемые порты, можно использовать стандартный netstat и отфильтровать, какие из них прослушиваются:

Или можно сделать финт ушами и с помощью nmap проверить, какие порты открыты на нашей локальной системе:

Чтобы закрыть ненужные порты, сначала надо остановить службы командами вроде:

И только теперь можно закрыть все порты, которые не нужны:

Проверим закрытые порты:

VPN с kill-switch

Дальше, расскажу про одну интересную штуку - kill-switch. Это функция, которая отключает интернет, если твой VPN-сервис внезапно вырубится. Почему это важно? VPN шифрует твой трафик и вообще очень полезен, но провайдер, злоумышленник или просто сбой в системе могут прервать соединение. В таком случае твой реальный IP-адрес может попасть в логи. Kill-switch нужен именно для таких ситуаций: он полностью блокирует интернет, если VPN-соединение обрывается.

Я расскажу, как настроить kill-switch с OpenVPN, но ты можешь сделать это и с другими сервисами.

Для начала установи OpenVPN, если его у тебя нет, и подключись:

Теперь пора настраивать сам kill-switch. Для этого первым делом заблокируй весь исходящий трафик, чтобы ничего не шло без VPN:

Теперь разреши трафик только к VPN-серверу:

Теперь разреши трафик через интерфейс VPN:

Эта команда пропустит трафик через VPN-туннель (tun0), когда VPN работает.

Безопасная настройка DNS

Теперь расскажу, как правильно настраивать DNS. Это очень важно потому что DNS, связывает доменные имена с реальными IP-адресами, и от её настроек зависит, увидит ли провайдер ваше незашифрованное общение с сайтами, перенаправит ли ваш трафик и многое другое.

Как работает DNS?

Для полноты картины расскажу как работает DNS. Всё начинается с того, что ваше устройство пытается найти ip сайта, который вы хотите посетить. Сначала оно смотрит в локальный кэш в файле /var/cache/nscd/hosts, где могут храниться данные от прошлых запросов. Если нужного ip там нет, устройство обращается к DNS-серверу, указанному в настройках, например, к серверу провайдера или публичному, вроде Google. Этот сервер проверяет домен и, если не знает ответа, запрашивает сервер домена первого уровня, например, для .com. Тот, в свою очередь, обращается к корневому серверу, который направляет запрос дальше, пока не найдётся нужный ip.

Базовая настройка DNS

Рассказывая о настройке DNS, начну с базовой информации, которую, по моему опыту, знают не все. Никогда не ставь 0.0.0.0 в настройках DNS-сервера - это как оставить дверь нараспашку для атак. Такой адрес заставляет сервер слушать все интерфейсы, включая внешние, что делает его лёгкой мишенью для DNS-амплификации, подмены ответов или утечки данных. Это происходит потому, что 0.0.0.0 не фильтрует входящие соединения, открывая доступ любому устройству в интернете. Кроме того, использование этого адреса может привести к утечке информации о ваших запросах, так как сервер не ограничивает, кто может к нему подключиться. Но, как же сделать правильно?

Если настраиваешь свой DNS-сервер, например, BIND или Unbound, ограничивай прослушивание локальными адресами. В конфиге, например, в файле /etc/bind/named.conf.options, пропиши:

Это значительно затруднит внешний доступ, потому что ограничит взаимодействие с внешними сетями.

Если свой сервер не используешь, можно выбрать внешнего провайдера, но тут есть риски, так что выбирай с умом. Cloudflare (1.1.1.1) даёт высокую скорость и хранит минимум логов, но, по-моему мнению, для приватности он не очень подходит. Потому можно использовать аналоги, вроде Quad9 или AdGuard.

Quad9 (9.9.9.9, 149.112.112.112) - не собирает персональные данные (по крайней мере, компания так говорит, верить ей или нет ваш выбор) и поддерживает DNS-over-HTTPS (DoH) и DNS-over-TLS (DoT) для шифрования запросов.

AdGuard (94.140.14.14, 94.140.15.15) - вроде как ведёт некоторые логи, но зато у них куча функций для блокировки трекеров, плюс поддержка DoH и DoT.

Эти серверы можно прописать в /etc/resolv.conf:

Настройка DNSSEC

Для дополнительной безопасности важно настроить DNSSEC. Эта штука защищает от атак, проверяя, что данные не подменили во время передачи.

Работает это через криптографические ключи. Допустим для зоны, eample.com, создают два ключа: ZSK подписывает записи, вроде IP-адресов или MX, а KSK подписывает сам ZSK, создавая цепочку доверия. Каждая запись получает подпись RRSIG, которая публикуется вместе с данными. Публичные ключи хранятся в записях DNSKEY, а связь с родительской зоной, например .com, держится на записи DS. Когда ты запрашиваешь сайт, твой браузер или резолвер получает данные и подпись, проверяет их по цепочке доверия от корневой зоны до нужной. Если подпись верна, данные считаются настоящими, если нет - запрос отклоняется. Но DNSSEC не шифрует данные, только подтверждает их подлинность и целостность, а именно про шифрование я расскажу позже.

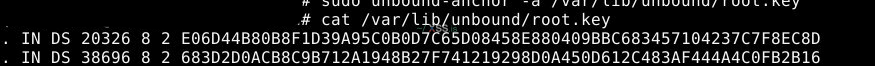

Сначала нужно установить Unbound:

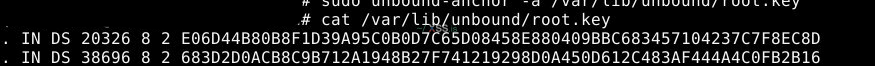

Получаем ключи DNSSEC:

Потом нужно включить сервис Unbound:

Это нужно, чтобы Unbound запускался при старте системы.

Далее нужно настроить локальный DNS:

Добавь локальный резолвер:

И перезагрузи систему:

DNSCrypt

Вот я и добрался до темы шифрования DNS. Оно полезно, чтобы провайдер или кто-то ещё не видел, какие сайты ты посещаешь. Но будь осторожен с установкой таких вещей: излишнее шифрование может привлечь к тебе внимание и показать, что ты что-то скрываешь.

Первым делом расскажу про DNSCrypt. Работает это так: клиент, например, браузер или приложение, отправляет DNS-запрос. Обычно такие запросы идут в открытом виде, и их могут перехватить. DNSCrypt шифрует этот запрос с помощью криптографии на основе эллиптических кривых (обычно Curve25519). Клиент и сервер DNSCrypt (резолвер) обмениваются ключами для аутентификации и шифрования. Запрос отправляется через защищённое соединение (обычно по UDP на порт 443) к серверу, который поддерживает DNSCrypt. Сервер расшифровывает запрос, обращается к DNS, получает ответ, шифрует его и отправляет обратно клиенту. Клиент расшифровывает ответ и использует IP-адрес для доступа к сайту.

Сначала нужно установить DNSCrypt командой:

После этого можно заполнить конфигурационный файл, указав данные серверов, которые стоит использовать для DNSCrypt:

Для примера я указал серверы Cloudflare и AdGuard, а также локальный порт, но ты можешь настроить конфиг по-другому:

Далее перезапусти сервис:

Настройка Anonymized DNSCrypt

Теперь расскажу про Anonymized DNSCrypt. По сути, это улучшенная версия DNSCrypt, где запросы идут через анонимные релеи, скрывая твой IP даже от DNS-сервера.

Работает это так: клиент шифрует DNS-запрос с помощью публичного ключа сервера, добавляет префикс с адресом конечного сервера и отправляет его релею. Релей, не имея ключей, просто пересылает зашифрованный запрос серверу, который видит только IP релея. Сервер обрабатывает запрос, шифрует ответ и отправляет его через релей обратно клиенту, который расшифровывает данные.

Помимо этого, Anonymized DNSCrypt добавляет минимальный overhead, работает быстрее, чем DoH, и не раскрывает метаданные в заголовках. Однако он требует поддержки со стороны клиента и релея, а также не защищает от анализа трафика на уровне промежуточного сервера.

Однако он требует поддержки со стороны клиента и сервера, не защищает от всех атак (например, от анализа трафика на релее) и не заменяет VPN, так как касается только DNS.

Сначала установи DNSCrypt, если он ещё не установлен, командой:

Затем нужно заполнить конфигурационный файл:

Это откроет файл для включения анонимных релеев.

Настройка серверов похожа на обычный DNSCrypt, но, в отличие от стандартных настроек, нужно указать параметр routes:

Я направил запросы через релеи в Германии и Франции, но, если тебе не нравится Франция (хотя с недавних пор кому она вообще нравится?), ты можешь направить запросы через релеи в других странах.

После этого стандартно перезапусти DNSCrypt:

Настройка DoH

Вы возможно задтесь вопросом, а можно ли просто замаскировать DNS-запросы под HTTPS-трафик, так чтобы провайдер не мог их перехватить. И при этом, это было не так подозрительно как шифрование? Я отвечу да, возможно и помогает в этом DoH.

Для этого DoH сначала шифрует DNS-запросы и отправляет их через HTTPS (порт 443), маскируя их под обычный веб-трафик. Это работает так: Клиент, например браузер, формирует DNS-запрос, который упаковывается в http зpапрос с методом GET или POST. Запрос шифруется с помощью TLS, как обычный HTTPS-трафик, и отправляется на DoH-сервер, указанный в настройках. Сервер расшифровывает запрос, выполняет разрешение DNS (может использовать DNSSEC для проверки целостности), формирует ответ и отправляет его обратно клиенту в зашифрованном виде через тот же HTTPS-канал. Клиент получает ответ, например IP-адрес запрошенного домена, и использует его для подключения к сайту. Правда, есть минус: хоть DoH скрывает DNS-запросы от провайдера, но сервер видит IP клиента, а если не используется дополнительная анонимизация, то метаданные HTTP могут раскрывать информацию о запросе.

Для начала нужно установить dnsdist командой:

Это установит DNS-прокси с поддержкой DoH.

Затем нужно открыть конфигурационный файл dnsdist:

В файле нужно указать пути к SSL-сертификатам и DNS-сервер.

Можно использовать любой сервер, но для примера я указал Quad9 на порту 443:

Далее следует перезапустить dnsdist:

Настройка DoT

Последним расскажу про DoT. Он работает похоже на своих "братьев" по шифрованию DNS: клиент формирует DNS-запрос и отправляет его на DoT-сервер через выделенное TLS-соединение. Запрос шифруется с использованием TLS, как при HTTPS, что предотвращает его перехват или изменение. Сервер, поддерживающий DoT, расшифровывает запрос, выполняет разрешение DNS (может использовать DNSSEC для проверки целостности данных) и отправляет зашифрованный ответ клиенту по тому же TLS-каналу. Клиент получает данные, например IP-адрес домена, и использует их для подключения к ресурсу.

Важно, не путай DoT с DoH! В отличие от DoH, DoT не маскирует запросы под веб-трафик, а просто шифрует их и передаёт с помощью TLS.

Для работы с DoT нужно установить Unbound - DNS-резолвер с поддержкой DoT:

После этого нужно заполнить конфиг:

В конфиге укажи, что хочешь использовать DoT, и задай DNS-серверы, например, Cloudflare и Google на порту 853:

После этого перезапусти Unbound:

Автоматиация

Чтобы автоматизировать настройку DNS, я написал скрипт, который всё делает сам. Идея такая: пользователь выбирает тип шифрования DNS, а скрипт настраивает всё в автоматическом режиме и проверяет, работает ли. Я написал довольно большой код и для понятности решил разбить его на куски при описании. Но итоговый код я прикреплю ниже в файле, и ты сам смог его протестировать.

Сначала я написал так чтобы скрипт спрашивал, включать ли DNSSEC:

Этот код работает так что, пользователь вводит ответ, например, "yes" или "no". Если ввёл "y" или "yes", DNSSEC включается, если "n" или "no" - отключается, а при любом другом вводе или его отсутствии DNSSEC включается по умолчанию. Ответ записывается в переменную и логируется в файл, чтобы было понятно, что выбрано.

Дальше скрипт запрашивает IP-адрес DNS-сервера, например, 9.9.9.9:

Код проверяет, правильный ли адрес который ввел юзер, сверяя с форматом IPv4-адрес, с помощью регулярного выражения - четыре числа, разделённые точками. Если формат неверный, скрипт останавливается и пишет в лог ошибку. Также я запретил использовать 0.0.0.0, потому что, как говорил раньше, это небезопасно - открывает сервер для атак вроде DNS-амплификации. Далее IP сопоставляется с известными провайдерами, такими как Cloudflare, Quad9 или AdGuard, чтобы потом использовать их имена в настройках шифрования.

После этого скрипт предлагает выбрать тип шифрования: DNS over HTTPS, DNS over TLS, DNSCrypt или Anonymized DNSCrypt:

В этом отрывке пользователь вводит номер от 1 до 4, и выбор сохраняется. Если выбрано DNS over TLS, скрипт дополнительно спрашивает, включать ли его, с тем же механизмом ответа, как для DNSSEC.

Для DNSSEC я написал функцию, которая работает через unbound:

Функция запускает команду для получения корневого ключа через unbound-anchor, включает и перезапускает сервис unbound, чтобы он обрабатывал запросы с проверкой DNSSEC. В файл resolv.conf записывается локальный адрес 127.0.0.1 как DNS-сервер, и в лог пишется, что настройка завершена.

Для DoH функция создаёт конфигурацию для dnsdist:

Функция пишет конфиг dnsdist указывая локальный адрес 127.0.0.1:443, пути к SSL-сертификатам и выбранный DNS-сервер с путём /dns-query. Сервис dnsdist перезапускается, а resolv.conf обновляется.

Вот функция для DoT:

Тут всё то же самое, но добавляется опция anonymized_dns и маршруты через анонимные реле, чтобы скрыть источник запросов.

И наконец, я добавил запуск всех функций и проверку, всё ли сработало:

Здесь скрипт устанавливает нужные пакеты, запускает функцию DNSSEC, если она выбрана, и настраивает шифрование в зависимости от выбора пользователя. Если DNS over TLS отключён, в resolv.conf записывается IP-адреса DNS-сервера напрямую. Затем скрипт проверяет, активны ли сервисы unbound, dnscrypt-proxy или dnsdist, и пишет их статус в лог. Для проверки работоспособности делается тестовый запрос к example.com через dig. Если запрос прошёл, в лог пишется, что DNS работает, иначе скрипт завершается с ошибкой.

Проверяем:

Для теста я сначала попробовал ввести 0.0.0.0 как IP DNS-сервера, и скрипт ожидаемо выдал ошибку, так как это небезопасно. Потом я ввёл 9.9.9.9 (Quad9), выбрал настройку DoH, и всё заработало как надо - DNS-запросы проходят, логи показывают, что сервис dnsdist активен.

Проверяем для DoT и DNSCrypt:

Снова использовал 9.9.9.9, выбрал DNSCrypt, скрипт создал конфиг для dnscrypt-proxy, сервис запустился, и запросы так же без ошибок, что видно в логе. Дальше проверил для DoT. Ввёл тот же 9.9.9.9, выбрал DoT, скрипт настроил unbound с TLS на порту 853, и тестовый запрос dig example.com прошёл успешно, логи подтвердили, что всё ок.

Настройка фильтрации пакетов и NAT

Фильтрация пакетов - это реально важная тема, потому что она определяет, какой трафик пускать в сеть, а какой блочить. Это помогает отсечь подозрительный трафик, разных атак.

NAT, в свою очередь, прячет внутренние IP-адреса устройств за одним внешним, делая локалку невидимой снаружи. В итоге интернет видит только внешний IP, а устройства внутри сети - нет, что мешает злоумышлинникам напрямую стучаться к тебе в сеть. Плюс NAT помогает туннелированию, чтобы безопасно соединять локальные машины с внешними сервисами через зашифрованные каналы.

Настройка

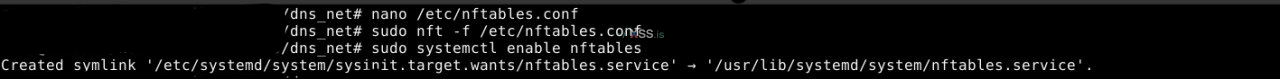

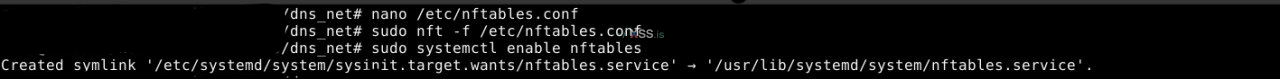

Для настройки фильтрации пакетов и NAT я решил использовать nftables, потому что он подходит для этого лучше чем тот же iptables.

Сначала ставим nftables - он будет отвечать за фильтрацию и NAT:

Дальше создаём конфиг для фильтрации и NAT. Я использовал стандартный /etc/nftables.conf:

Этот конфиг создаёт таблицу my_table, которая блочит весь входящий трафик, кроме SSH уже установленных соединений, чтобы ответы на твои запросы доходили. Исходящий трафик разрешен полностью, а для NAT настроена маскировка: устройства из локалки 192.168.1.0/24 выходят в интернет через внешний IP интерфейса eth0. Это прячет внутреннюю сеть и помогает туннелированию.

Теперь применяем конфиг, чтобы правила заработали:

И наконец, включаем сервис nftables, чтобы всё автоматически запускалось при старте системы:

sudo systemctl enable nftables

Проверем и устанвливаем правило:

Настройка IPsec

Для защиты сети очень важно уберечь трафик от перехвата, и хотя обычно TLS справляется, иногда его не хватает, и тут на помощь приходит IPsec. Он работает на сетевом уровне, то есть шифрует и защищает весь трафик между двумя точками - устройствами, серверами или целыми сетями. Это делает его универсальным, потому что IPsec не зависит от приложений или протоколов: он шифрует всё, от голосовых звонков и видео до данных IoT или файлов.

IPsec особенно хорош для VPN. Он использует два важных протокола: AH, который проверяет, что данные не подделаны, и ESP, который шифрует их и тоже может проверять подлинность. ESP делает данные нечитаемыми для чужаков и более гибок, чем AH. По сути, IPsec создаёт зашифрованный туннель, через который трафик идёт безопасно защищенный от перехвата.

Настройка

Чтобы настроить IPsec для безопасного туннеля, я решил использовать strongSwan инструмент для VPN на IPsec. Начинаем с установки strongSwan, чтобы получить всё нужное для IPsec:

Дальше создаём конфиг для туннеля:

Этот конфиг задаёт туннель: left - твой сервер с динамическим IP (defaultroute), leftid - его идентификатор, right - IP VPN-сервера, rightsubnet - сеть, к которой туннель даёт доступ (всё, 0.0.0.0/0). Используется IKEv2 для шифрования, аутентификация по секретному ключу, и туннель стартует автоматически. Это создаёт защищённый канал, через который трафик идёт в безопасности.

Теперь задаём секретный ключ для аутентификации в отдельном файле:

Этот код в /etc/ipsec.secrets указывает ключ PSK (предварительно общий секрет) для двух сторон - твоего сервера и VPN-сервера. Ключ "SecretKey123" - это пример, в реале надо свой, посложнее. Это нужно, чтобы IPsec знал, что соединение с сервером безопасное и проверенное.

И наконец, перезапускаем strongSwan, чтобы конфиги применились:

MACSec для шифрования на уровне Ethernet

Я уже много рассказал про всякие достаточно высокоуровневые методы защиты сети, вроде защиты . Но таких методов не всегда бывает достаточно, ведь даже если вы используете HTTPS, злоумышленник с доступом к сети (допустим, получивший доступ к ней через атаку вроде злых близнецов) может видеть метаданные: кто с кем общается, какие IP-адреса, порты или даже ARP-запросы, которые помогают устройствам находить друг друга. Но как же защитить свой трафик на низких уровнях?

MACSec решает эту проблему, шифруя весь Ethernet-фрейм, включая заголовки. Он работает на канальном уровне, в отличие от тех же VPN и TLS, которые работают на уровне IP или приложений. MACSec берёт весь трафик, например заголовки, и шифрует его прямо на уровне Ethernet, превращая данные в зашифрованный поток, который невозможно разобрать без ключа.

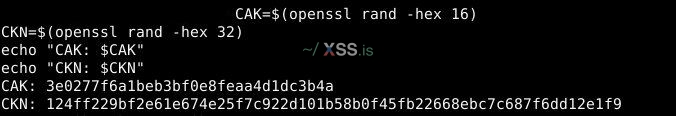

MACSec использует симметричное шифрование, обычно с алгоритмом AES-GCM-128. Устройства обмениваются ключами (обычно заранее настроенными, так называемыми PSK - pre-shared keys), чтобы аутентифицировать друг друга и шифровать данные. Ключи состоят из CAK для шифрования и CKN для идентификации. Когда два устройства, например клиент и сервер, настроены с одинаковыми ключами, они создают защищённый канал. Каждый Ethernet-фрейм получает дополнительный заголовок MACSec (с тегом 0x88e5), который содержит информацию о шифровании, и весь фрейм, включая данные и оригинальные заголовки, шифруется.

Для аутентификации и защиты от подмены MACSec использует механизм проверки целостности. Это значит, что если кто-то попытается подделать фрейм или внедрить свой трафик (например, в атаке MITM), устройство сразу заметит несоответствие и отбросит такой фрейм. Это особенно полезно для защиты от атак вроде ARP или DHCP, которые часто используются для перехвата или перенаправления трафика.

Но MACSec имеет и свои проблемы. Он работает только в пределах одной сети (точка-точка), так что для защиты трафика через интернет лучше использовать VPN или TLS. Ещё он требует, чтобы оба устройства поддерживали MACSec, что не всегда возможно, особенно с дешёвыми или старыми роутерами.

Настройка

Для начала убедись, что ядро вообще знает, что такое MACSec. Выполни:

Если в выводе пусто, не паникуй - просто подгрузи модуль:

Если и после этого ничего не устновилось, проверь версию ядра (uname -r) - MACSec поддерживается с ядра 4.6 и выше. Если у тебя что-то древнее, обновляй ядро.

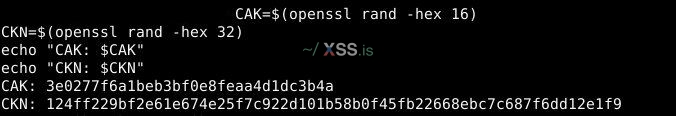

Теперь генерируем ключи для шифрования:

Добавляем передающую ассоциацию (SA):

Команда настраивает передачу зашифрованных фреймов.

Теперь приёмная ассоциация:

Это настраивает приём фреймов от сервера. Замени <MAC_сервера> на его реальный MAC-адрес (узнай через ip link show eth0 на сервере).

Дальше устанавливаем алгоритм шифрования:

Привязываем ключи:

Включаем шифрование:

Активируем интерфейс:

И наконец-то назначаем IP-адрес:

Теперь клиент готов. Для настройки сервера делаем то же самое, но с MAC-адресом севера:

Замени <MAC_клиента> на MAC-адрес клиента (узнай через ip link show eth0 на клиенте). Ну и используй те же CAK и CKN, что сгенерировал в начале.

Чтобы проверить ли работает пингуем сервер с клиента:

И проверяем шифрование:

Если всё работает ты увидешь зашифрованные фреймы с тегом 0x88e5 вместо читаемых данных.

Ручная настройка ключей - это весело, но если их надо часто менять, лучше автоматизировать через MKA (MACSec Key Agreement).

Для этого установи wpa_supplicant:

Создай конфиг /etc/wpa_supplicant/wpa_supplicant.conf:

Тут identity и password - это данные для аутентификации с MKA-сервером. Подставь свои.

И запусти wpa_supplicant:

Если хочешь сам распредлять ключи, создай новый SA:

И удали старый:

MACSec добавляет шифрование, а это может слегка тормозить. Запусти сервер для теста:

На клиенте проверь скорость:

Сравни результаты с трафиком без MACSec. Если падение скорости критично, подумай, может, тебе хватит шифрования на другом уровне, например, через VPN.

Fail2Ban для блокировки IP

Я решил рассказать про Fail2Ban - интерснй инструмент, который помогает, когда нужно защитить сервер от брутфорса или других атак. Для домашнего компа он, может, не так полеен, но всё равно важен, потому что даже в локальной сети могут случаться атаки, если кто-то пытается подобрать пароли.

Fail2Ban работает просто: он следит за логами, например, SSH или веб-сервера, и ищет подозрительные действия, вроде кучи неудачных попыток входа. Если таких попыток слишком много за короткое время, он добавляет IP атакующего в чёрный список через брандмауэр, обычно iptables или nftables. После заданного времени блокировка сама снимается, чтобы не забанить случайно нормальных юзеров.

Настройка

Сначала нужно установить Fail2Ban:

Дальше настраиваем конфиг, чтобы задать правила блокировки:

Этот конфиг следит за портом 22, использует фильтр sshd, смотрит логи в /var/log/auth.log. Если кто-то 5 раз подряд ошибается с паролем, его IP банится на час (3600 секунд).

Теперь перезапускаем Fail2Ban, чтобы конфиг применился:

И наконец, проверяем статус, чтобы убедиться, что всё работает и баны применяются:

Как безопасно настроить системные логи?

Ещё одна важная штука для безопасности, это минимизация утечек через системные логи. В них пишется всё, что творится в системе: кто подключался, какие запросы шли, какие ошибки вылезали. Иногда туда попадают IP-адреса пользователей, параметры запросов, имена файлов, а если что-то криво настроено, то даже пароли или ключи. Если злоумышленник получит доступ к этим файлам, он сможет изучить поведение системы, понять, какие сервисы работают, какие уязвимости можно использовать, чтобы спланировать атаку.

Чтобы решить эту проблему, можно минимизировать записываемую инфу, чтобы убрать из логов всё лишнее и сократить следы, которые могут выдать важные данные. Это, конечно, палка о двух концах: меньше логов - меньше инфы для злоумышленников, но и тебе сложнее отследить, если что-то пошло не так. Поэтому, главное - всё сделать грамотно. Например, вместо полного текста HTTP-запросов к веб-серверу можно настроить логи так, чтобы они фиксировали только сам факт обращения, без параметров или заголовков, чтобы запрос можно было отследить в случае чего. Плюс важно включить ротацию логов - чтобв старые записи сами удалялись или архивировались, чтобы не копить гору данных, которые могут утечь. Ещё важно закрывать доступ к логам, чтобы только доверенные юзеры или процессы могли их читать, и чистить временные файлы(там часто оседают следы операций, вроде кэшей или промежуточных данных).

Для минимизации логов я написал скрипт, который автоматизирует процесс и убирает лишние следы из системы:

Проверяем:

Сначала скрипт проверяет, что запущен от root, иначе ничего не выйдет, и пишет все действия в /var/log/cleanup_script.log. Дальше, он фильтрует SSH-логи, убирая IP-адреса, и сохраняет чистый результат в /tmp/sshd_logs_filtered.txt. После чего настраивает systemd и journald, чтобы логи занимали не больше 50 МБ и писали только важное, плюс включает защиту логов. Временные файлы в /tmp удаляются, чтобы не оставлять мусора вроде кэшей. Для rsyslog добавляются фильтры, которые блокируют запись IP, паролей и ключей. Скрипт создаёт задачу в cron для ежедневной чистки старых файлов и урезания логов journalctl. Проверяет, что cron работает, и настраивает logrotate, чтобы сжимать и ротировать /var/log/syslog, ограничивая его 50 МБ и 7 версиями.

Смена MAC-адреса.

Смена MAC-адреса - это полезная штука для повышения приватности, потому что MAC-адрес - это как уникальный отпечаток твоего сетевого устройства, который можно отследить. В прошлой статье я уже рассказывал, как генерировать случайные MAC-адреса на Linux, и объяснял, что такое MAC. Если коротко: это 48-битный (6 байт) идентификатор сетевого интерфейса, записанный как шесть пар шестнадцатеричных чисел, типа 00:14:22:33:44:55. Первые три байта - OUI, код производителя, выданный IEEE (например, 00:14:22 - это Dell, а 00:16:17 - D-Link), а вторые три байта - уникальный идентификатор устройства. Если хотите разобраться глубже, гляньте мою старую статью.

Здесь же, чтобы не повторяться, я просто расскажу, как автоматически выбирать MAC-адрес из готового списка, а не генерировать новый. Это удобно, если уже есть список сгенерированных mac, которые выглядят как настоящие.

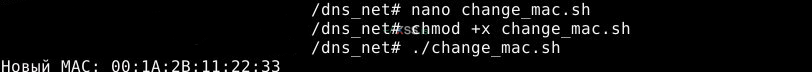

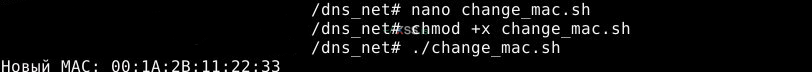

Вот пример кода на bash:

Проверяем:

Скрипт работает так: задаём интерфейс (например, eth0) и массив MAC_LIST с готовыми MAC-адресами. NEW_MAC выбирается случайным образом из списка с помощью $RANDOM. Потом интерфейс опускается командой ip link set down, меняется его MAC-адрес на новый, и интерфейс поднимается обратно. В конце выводится новый MAC, чтобы ты знал, что всё сработало.

Настройка Traffic shaping

Теперь расскажу про traffic shaping, это нужено, чтобы запутать тех, кто пытается анализировать твой сетевой трафик. Оно маскирует его, добавляя случайные задержки, меняя порядок пакетов или подкидывая фиктивные данные, чтобы никто не понял, что ты там делаешь в сети.

Когда ты сидишь в интернете, все твои действия - от просмотра сайтов до переписки в мессенджерах - создают пакеты данных с определёнными признаками: размер, частота, протоколы. DPI эти признаки ловит и может понять, что ты, например, сидишь через VPN или Tor, потому что у них свои шаблоны. Провайдер может это заметить и заблокировать соединение или просто следить за тобой. Traffic shaping ломает эти шаблоны: добавляет паузы между пакетами, чтобы они не походили на VPN, или шлёт фейковые пакеты, которые создают шум и сбивают анализ с толку. Работает это через софт, типа Obfsproxy в Tor или протоколов вроде Shadowsocks, которые маскируют трафик под обычный HTTPS, как будто ты просто сайт смотришь. Но это не без минусов: соединение может тормозить из-за задержек и лишних данных, а крутые DPI всё равно могут что-то заподозрить. Для пущей надёжности лучше мешать это с другими штуками, типа серверов в разных странах или двойного шифрования.

Настройка

Сначала устанавливаем инструменты для управления трафиком:

Настраиваем задержки:

Эта комнда добавляет случайные задержки (100 мс ± 10 мс) на интерфейс eth0.

Далее добавляем случайную потерю пакетов:

Эта комнда имитирует потерю 0.1% пакетов, чтобы затруднить анализ трафика.

Проверяем правила:

Так же вот команда для удаления правил, на всякий случай:

Проверяем:

Настройка ханипота

Далее расскажу про ханипоты. Это такая штука, которая создаёт фейковые уязвимости, чтобы, например, при сканировании портов или других действиях запутать злоумышленников и отвлечь их от реальных систем.

Чтобы лучше понять их работу, представь ситуацию: сканер вроде Nmap ищет открытые порты и видит порт 21 с баннером "ProFTPD 1.3.5". Злоумышленник думает, что попал на старый FTP-сервер. Он тратит время на попытки логина, загрузки эксплойтов или брутфорса, а ханипот просто логирует его действия (IP и т.д.) в /var/log/honeypot.log. Благодаря этому ты можешь узнать, что тебя пытаются взломать, и принять меры, не подвергаясь риску.

В качестве первого примера я написал небольшую утилиту на Bash для ханипота. Идея такая: в неё можно загрузить любой порт. Она добавит его как ханипот и будет логировать любые сканирования этого порта вместе с IP сканирующего.

Пример кода:

Проверяем:

Код работает так: сначала он проверяет, запущен ли с root-правами, и наличие утилит netcat (nc) и ss - без них ничего не выйдет. Потом он создаёт папки /tmp/honeypot_pids для PID процессов и /tmp/honeypot_logs для логов. Когда ты запускаешь скрипт с флагом --add <port> [description], он вызывает функцию start_listener, которая и создает ханипот.

Для этого она сначала проверяет через check_port, свободен ли порт на 127.0.0.1 - если занят, ханипот не ставится. Если порт свободен, создаётся лог-файл /tmp/honeypot_logs/honeypot_log_<port>.txt, куда пишется старт ханипота, описание.

Затем запускается netcat (nc -l -p <port> -s 127.0.0.1 -v), который слушает порт и отправляет подключившемуся клиенту описание в качестве баннера. Всё, что netcat видит, пишется в лог: когда кто-то подключается, строка "Connection from <ip>" парсится через grep, чтобы вытащить IP, и записывается в лог через log_scan с меткой времени и действием "Connection attempt". После отключения клиента пишется "Connection closed" с таким же логированием. Процесс netcat запускается в фоне, его PID сохраняется в /tmp/honeypot_pids/honeypot_pid_<port>.pid, и через ps проверяется, что он жив. Если всё ок, скрипт сообщает, что ханипот готов, и подсказывает, как проверить его с помощью nmap. Команда --delete port/all останавливает ханипот или все ханипоты, убивая процессы и чистя файлы.

К сожалению, как вы можете заметить, на Bash не выйдет прикрутить описание к портам, чтобы при сканировании с опцией -sV в Nmap злоумышленник видел то, что мы задумали. Поэтому, чтобы всё выглядело правдоподобно, для полноты картины я написал реализацию на C.

Вот пример кода:

Этот код работает так: первым делом проверяется, что программа запущена с root-правами, иначе порты ниже 1024 не открыть, и создаётся лог-файл /var/log/honeypot.log. Функция start_honeypot создаёт TCP-сокет для указанного порта, настраивает его с SO_REUSEADDR, чтобы избежать проблем с повторным использованием порта, привязывает к 0.0.0.0 (все интерфейсы) и начинает прослушку. При добавлении ханипота на порт, например 21, она записывает в лог старт через log_message и ждёт подключений через accept. Для каждого клиента создаётся новый процесс, который обрабатывает соединение в handle_client. Эта функция отправляет баннер: для порта 21 - "220 ProFTPD 1.3.5 Server (Fake Vulnerable FTP)", для 2121 - "220 Fake FTP on Random Port", для 80 - HTTP-ответ с заголовком "X-Vulnerable: Yes". Она читает команды клиента, логирует их и, если это FTP-порт, отвечает на команды USER, PASS, RETR или QUIT стандартными FTP-ответами, а на неизвестные - ошибкой. Для порта 80 отвечает на GET-запросы тем же баннером. Подключения, команды и их закрытие записываются в лог с IP клиента, портом и временем. Главная функция main запускает три ханипота на портах 21, 2121 и 80 через fork, чтобы они работали параллельно.

Для сборки нужно установить:

Дальше просто собрать командой:

Проверяем работу кода:

Для проверки я запустил nmap -sV -p 21,80,2121 localhost, и, как вы видите, всё работает: фейковая информация выдаётся при сканировании, а сканирования записываются в лог.

Для удобсва можно запустить мой скрипт через автозапуск. Для этого нужно создать systemd-сервис:

Вот что нужно поместить в файл сервиса:

Дальше следует запустить сервис:

Настройка клиента и сервера V2Ray

V2Ray - это часть Project V, набора инструментов, чтобы строить защищённые сети поверх обычного интернета. В этом проекте трафик шифруется и маскируется под обычный веб, так что его сложно отличить от простого сёрфинга по сайтам. V2Ray появился для борьбы с цензурой в Китая, когда Shadowsocks прижали власти.

В основе V2Ray - ядро, которое управляет протоколами и маршрутизацией. Оно поддерживают несколько транспортных протоколов, таких как TCP, WebSocket, HTTP/2, QUIC или gRPC. Наиболее популярный вариант - WebSocket, так как он часто используется для обмена данными между браузерами и веб-серверами. Это позволяет замаскировать прокси-трафик под обычные HTTPS-запросы, которые выглядят как посещение обычного сайта. Трафик часто оборачивается в TLS, который шифрует данные и делает их неотличимыми от HTTPS-трафика, используемого для обычного просмотра сайтов. Например, если вы подключаетесь через WebSocket с TLS, ваш трафик внешне выглядит как соединение с обычным сайтом (например, google.com). Благодаря этому DPI, анализирующий заголовки и структуру пакетов, не может так проосто распознать прокси. Но по мимо этого V2Ray можно настроить так, чтобы трафик проходил через реальный веб-сервер (например, Nginx или Caddy), который обслуживает обычный сайт. Это нужно для того чтобы, если провайдер проверит соединение, он увидит только запросы к обычному домену, конда как сам прокси-трафик скрыт внутри. Это особенно полезно, если сервер V2Ray интегрирован с CDN, вроде Cloudflare, где трафик дополнительно маскируется под запросы к популярным сервисам.

Расскажу подробнее про протколы V2Ray. VMess - самый первый и самый старый проткол. Он стал своего рода эталоном для других протоколов Project V, таких как VLess. VMess шифрует данные с помощью AES-128-GCM, что делает его устойчивым к DPI и прочему анализу трафика.

Работает так: клиент и сервер обмениваются данными через зашифрованный канал. Для аутентификации используется UUID - уникальный идентификатор, чтобы только ты мог подключиться. Трафик передается через различные транспортные протоколы, такие как TCP, WebSocket, HTTP/2 или даже mKCP, что позволяет маскировать его под обычный веб-трафик, например, HTTPS, чтобы провайдеры или файрволы не могли легко распознать прокси. Ещё VMess поддерживает динамическое изменение портов, мультиплексирование для одновременной обработки нескольких соединений и маршрутизацию, где можно настроить, какие запросы куда направлять - например, разделять трафик по доменам или географическим регионам.

В отличие от более легковесного VLess, VMess тяжелее из-за встроенного шифрования и дополнительных проверок, но это делает его более универсальным для сложных случаев, где нужна максимальная защита. Его часто используют в связке с TLS или Cloudflare для доп-анонимности. Настраивается он через JSON-конфиги, но с клиентами вроде V2RayN или Qv2ray даже новичок справится.

VMess считается устаревшим, а при работе через просто TCP - небезопасным, однаĸо вариант VMess-over-Websockets-over-TLS может всё ещё неплохо работать.

Ещё один важный протокол в V2Ray это VLESS. VLESS, был создан как упрощенная версия VMess, и лишен встроенного шифрования, благодаря этому он быстрее и менее требователен к ресурсам. При этом безопасность в нем можно обеспечить, добавив TLS или XTLS поверх протокола. Как и VMess, VLESS использует UUID для аутентификации, но работает по принципу stateless-подхода, не сохраняя состояние сессии, что упрощает его архитектуру и ускоряет работу.

Работает проткол так: когда клиент начинает соединение, отправляя серверу UUID для аутентификации. Если всё ок, трафик идёт через выбранный транспорт - TCP, WebSocket, QUIC или gRPC, чтобы замаскировать его под обычный веб, и провайдеры не могли легко заблочить. Сервер проверяет UUID, перенаправляет запросы к нужному ресурсу, а ответы возвращает через тот же канал. Плюс VLESS поддерживает мультиплексирование для параллельной обработки нескольких потоков и механизм fallback, который автоматически переключает соединение на резервные порты в случае проблем.

Настройка VLESS

В качестве первого примера я покажу, как настроить VPN с VLESS на своём сервере и подключиться к нему с клиента на Linux. Это буду делать через Xray (форк V2Ray, где REALITY встроен для обхода блокировок). Сервер - Debian 10 на VPS.

Настройка сервера

Для начала расскажу про покупку VPS, чтобы поднять свой VPN-сервер. Для теста я взял сервер на https://rdp.sh/ - там удобно, потому что можно платить криптой. Но вы можете выбрать любого провайдера, который вам по душе.

Предполагаю, что на вашем сервере установлена Ubuntu (или Debian-подобная система). Мы используем Xray-core для VLESS с TLS (для безопасности). Это базовая настройка без домена (используем IP напрямую, но для полной защиты рекомендуется домен с Let's Encrypt). Если домена нет, TLS будет на основе самоподписанного сертификата, но клиент может жаловаться.

Сначала ставим нужные пакеты, чтобы всё работало без проблем:

Дальше можно установить Xray автоматически через официальный скрипт:

Или, если хочешь ручками, скачать релиз и установить сервис в ручную:

Потом создаём systemd-сервис для Xray, чтобы он стартовал сам и перезапускался при сбоях.

Для этого открываем файл:

И вставляем туда:

Этот конфиг запускает Xray после старта сети, ограничивает ресурсы и перезапускает при проблемах. Путь /opt/xray/xray и config.json должны соответствовать твоей установке.

Теперь генерируем UUID для VLESS, это как пароль для подключения:

Теперь пора создавать конфигурационный файл для Xray, чтобы настроить VLESS с TLS, и генерировать сертификаты для шифрования.

Сначала создаём файл конфигурации:

В него вставляем конфиг, заменив YOUR_UUID на сгенерированный ранее UUID, используя порт 443 для TLS:

Сохраните (Ctrl+O, Enter, Ctrl+X).

Этот конфиг настраивает VLESS на порту 443 с TCP и TLS для маскировки под HTTPS. Логи на уровне warning, чтобы не захламлять диск. Outbound с freedom пускает трафик в интернет.

Дальше генерируем самоподписанный сертификат, если домена нет:

Если есть домен, ставим certbot и получаем сертификат: apt install certbot -y && certbot certonly --standalone -d yourdomain.com. В конфиге указываем пути: /etc/letsencrypt/live/yourdomain.com/fullchain.pem и privkey.pem. Это делает сервер правдоподобнее с сертификатом от Let’s Encrypt.

Теперь можно настроить Nginx, чтобы замаскировать VLESS-трафик под обычный HTTPS, это опционально, но добавляет правдоподобности.

Для этого сначала открываем файл конфигурации Nginx:

В него вставляем такой конфиг, заменив ip_your на IP твоего сервера или домен:

Сохраняем: Ctrl+O, Enter, Ctrl+X. Этот конфиг перенаправляет весь HTTP-трафик с порта 80 на HTTPS (порт 443), чтобы всё выглядело как обычный сайт. Сертификаты из /etc/ssl/certs/xray.crt и /etc/ssl/private/xray.key (или пути от Let’s Encrypt, если используешь домен) делают трафик похожим на HTTPS, скрывая VLESS. Блок location отвечает за отдачу простых HTML-страниц, чтобы сервер выглядел как веб-сайт.

Сначала перезапускаем Nginx, чтобы конфиг заработал:

Дальше открываем порты 80 и 443 в файрволе, чтобы трафик проходил:

Эти команды разрешают HTTP и HTTPS трафик через ufw и включают файрвол. Это важно, чтобы VLESS на порту 443 и редирект с 80 работали без проблем.

Теперь запускаем и настраиваем Xray для автозапуска:

Первая команда стартует Xray, вторая включает его автозапуск при загрузке системы, а третья показывает, всё ли работает. Если статус active (running), то VLESS-сервер готов.

Кстати, без домена и CDN типа Cloudflare твой сервер могут блочить. Чтобы усилить маскировку, советую переключить транспорт в config.json на WebSocket (поменяй network: "tcp" на network: "ws") и настроить Nginx для поддержки WebSocket. Это делает трафик ещё больше похожим на обычный веб, что усложняет его блокировку.

Настройка клиента

Теперь пришло время настроить клиент VLESS на Linux с v2rayN.

Для этого нужно скачать v2rayN с https://github.com/2dust/v2rayN/releases, и взять v2rayN-linux-64.deb:

После чего установить его командой:

Дальше нужно сформировать VLESS-ссылку на основе вашего сервера и скопировать её:

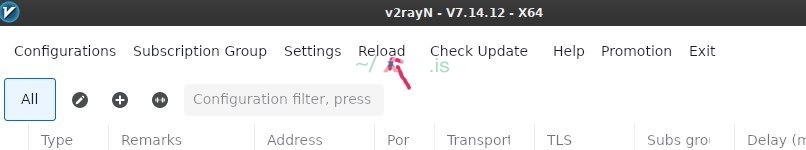

Дальше нужно нажать на Configurations:

И только после этого в v2rayN нужно найти Import Share Links from Clipboard и нажать.

Теперь нужно загузить правила, для этого нажимаем Settings, а потом выбераем Routing Setting:

После чего импортировать дополнительные правила Import Rules и, когда всё загрузится, нажать Confirm:

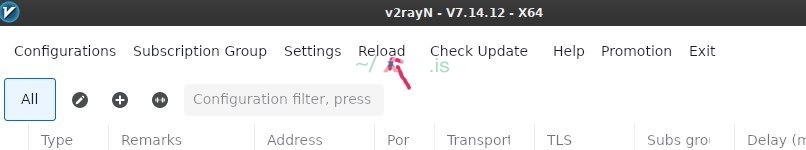

Когда всё загрузится, можете нажать Reload и заново установить соединение:

Далее в нижнем меню выберите настройки подключения, у меня - Global:

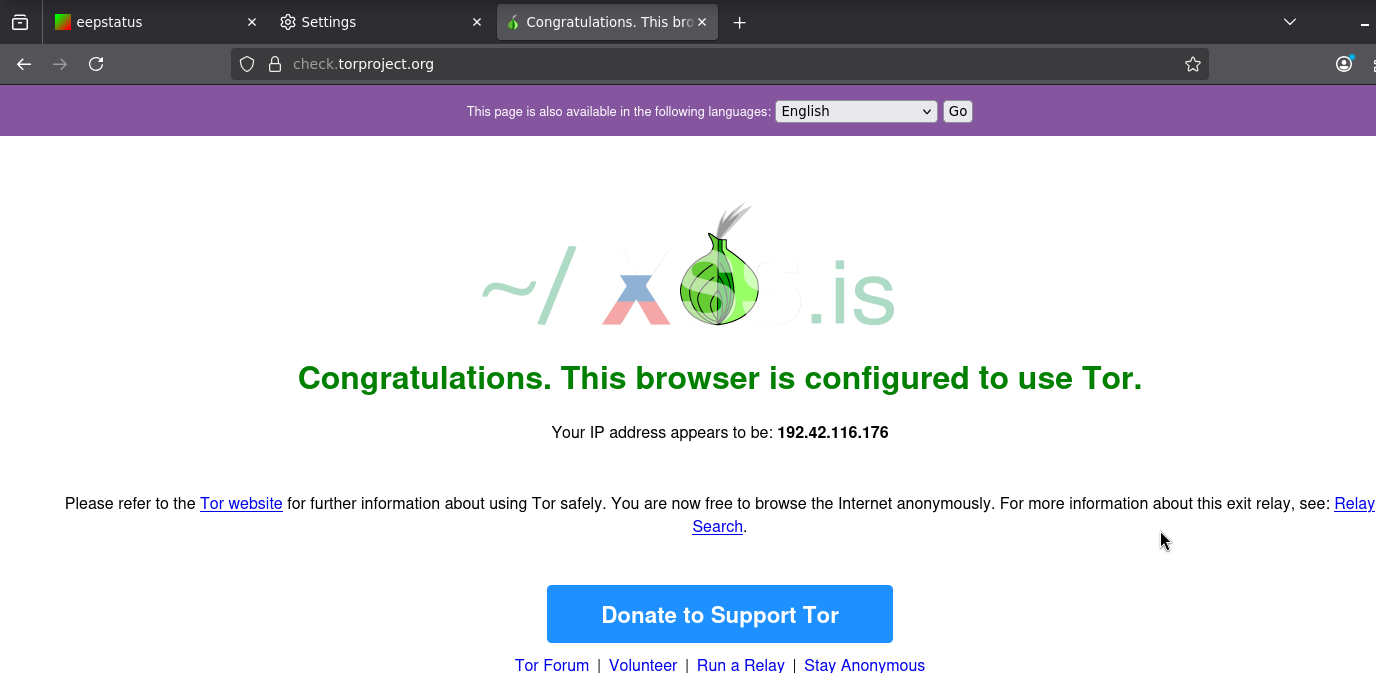

Теперь всё должно работать. Ты можешь проверить, зайдя на https://whatismyipaddress.com и проверив свой IP.

Настройка VMess

Я не могу не рассказать, как настраивать VMess - это ещё один мощный протокол V2Ray. Настройка конфига похожа на VLESS, но есть свои нюансы, особенно с шифрованием и WebSocket.

Для начала нужно поставить V2Ray:

Дальше генерируем UUID для аутентификации:

Теперь создаём и заполняем конфиг для сервера /usr/local/etc/v2ray/config.json:

Вставляем базовый конфиг для VMess с WebSocket (без TLS, для простоты), заменив id на свой UUID:

Сохраняем: Ctrl+O, Enter, Ctrl+X. Этот конфиг настраивает VMess на порту 443 с WebSocket (путь /vmess). Поле disableInsecureEncryption включает только безопасное шифрование (AES-128-GCM). Outbound с freedom пускает трафик в интернет. Если у тебя домен и TLS, замени address на свой домен, а в streamSettings поставь "network": "ws", "security": "tls", и укажи пути к сертификатам, как в случае с VLESS.

Теперь запускаем и настраиваем сервис V2Ray:

Клиент для VMess можно использовать тот же, как и для VLESS, - v2rayN, потому что он поддерживает оба протокола. Настройка проходит так же, как с VLESS. Сервер устанавливается и запускается абсолютно так же.

Network Namespaces для изоляции процессов и трафика

Network Namespaces в Linux - это интерсный способ создать изолированные сетевые окружения, чтобы каждое приложение или контейнер работало в своей собственной сети, не мешая другим и не вылезая за её пределы. Это как дать каждому процессу свою песочницу с сетевыми настройками: интерфейсами, маршрутами, правилами фильтрации и сокетами. Используют это в контейнерах (типа Docker), для тестов сетей или чтобы VPN работал безопасно, не смешивая трафик с другими приложениями.

На уровне ядра Linux сетевое пространство имен, - это как отдельная коробка для сетевых настроек. А именно, это работает так: когда ns создаёшь новое пространство (например, командой ip netns add), ядро выделяет ему уникальный набор ресурсов: свои интерфейсы (типа eth0 или lo), таблицы маршрутизации и правила для трафика (iptables). Процесс внутри этого пространства видит только свою сеть и не может заглянуть в сеть хоста или другого пространства. Получается, что каждое приложение живёт в своей изолированной сети.

Ядро Linux следит за изоляцией через специальные структуры данных. Для каждого пространства имен оно хранит отдельную информацию о сетевых интерфейсах, маршрутах и сокетах. Когда процесс отправляет сетевой пакет, ядро смотрит, в каком пространстве он работает, и использует только настройки этого пространства. Это значит, что пакеты из одного пространства не попадут в другое, и никто не подслушает чужой трафик. Например, если в одном пространстве настроен VPN, его трафик не утечёт на хост.

Для связи между пространствами имен или с хостом ядро использует виртуальные интерфейсы, такие как veth. Один конец интерфейса подключен к пространству имен, другой - к хосту или другому пространству. Ядро передает пакеты через этот интерфейс, а настройки, такие как маршруты или NAT (через iptables), определяют, куда и как направить данные. Процесс, запущенный в пространстве имен, работает только с его сетью. При удалении пространства имен ядро очищает все связанные сетевые настройки.

Настройка

Теперь расскажу, как настроить Network Namespaces в Linux, чтобы изолировать сетевые настройки для процессов.

Сначала нужно создать новое сетевое пространство:

Эта команда создаёт namespace с именем myns, где будут свои сетевые интерфейсы и настройки.

Проверяем, что namespace создался:

Команда покажет список всех namespaces, и ты увидишь myns в списке.

Теперь можно запустить процесс внутри namespace, чтобы его сетевые операции были изолированы:

Это открывает bash внутри myns. Все сетевые команды, запущенные тут, будут работать только в этом namespace.

Дальше нужно создать виртуальную пару интерфейсов для связи:

Команда делает два интерфейса, veth0 и veth1, связанные как кабель. Один будет на хосте, другой - в namespace.

Привязываем veth1 к namespace:

Это перемещает veth1 в myns, и он станет частью его сети.

Настраиваем IP-адрес для veth1 в namespace:

Эта команда даёт veth1 внутри myns адрес 192.168.1.2 с маской /24, чтобы он мог общаться в сети.

Активируем интерфейс:

Это включает veth1, чтобы он начал обрабатывать трафик.

Теперь настраиваем маршрутизацию:

Команда добавляет маршрут по умолчанию, чтобы трафик из myns шёл через шлюз 192.168.1.1.

Если нужен файрвол, настраиваем iptables внутри namespace:

Это разрешает исходящий HTTP-трафик (порт 80) в myns.

Для жёсткой защиты можно заблокировать всё остальное:

Тут только HTTP-трафик разрешён, а всё остальное блокируется.

Если namespace станет больше не нужен, можно просто удалить его:

Использование eBPF

eBPF - это итерсная технология в ядре Linux, которая позволяет запускать маленькие программы прямо внутри ядра, не трогая его код и не создавая модули. Она помогает следить за сетью, системными событиями или безопасностью. Программы пишутся на C, и компилируются в байт-код, который ядро проверяет на безопасность, чтобы ничего не сломалось, и запускает в своей виртуальной машине eBPF.

Как это устроено? Программы eBPF - это небольшие куски кода на C, которые привязываются к событиям в ядре, например к приходу сетевого пакета. После чего верификатор ядра проверяет код, чтобы он не навредил системе. Есть ещё карты eBPF - это как таблицы, где можно хранить данные, например список подозрительных IP-адресов, и делиться ими между ядром и программами. Хуки - это точки в ядре, где программы eBPF могут подключаться, например XDP для обработки пакетов на уровне сетевого драйвера или socket_filter для работы с сокетами.

Допустим если хочу с помощью этого механизма следить за TCP-пакетами, блокировать подозрительные IP из чёрного списка и скрывать IP-адреса в логах ради приватности. Идея такая: программа eBPF цепляется к сетевому интерфейсу через XDP. Она смотрит TCP-пакеты, вытаскивает IP-адреса источника и назначения. Если IP в чёрном списке (хранится в карте eBPF), программа выдаёт XDP_DROP, и пакет выбрасывается. Для логов IP хешируется, например с использованием времени (bpf_ktime_get_ns) как соли или через библиотеку для SHA-256. Хеш кладём в другую карту eBPF или отправляем в приложение через кольцевой буфер.

Для этого нужно взять XDP, потому что он работает на уровне сетевого драйвера, обрабатывая пакеты сразу после их получения, до того как они попадут в сетевой стек ядра. Это быстрее, чем socket_filter, который работает позже, на уровне сокетов, и тратит больше времени.

С XDP можно решать, что делать с пакетом: выбросить, пропустить, отправить обратно или перекинуть куда-то ещё. Для блокировки подозрительных IP можно использовать карту eBPF типа BPF_MAP_TYPE_HASH - она быстро ищет, есть ли IP в чёрном списке.

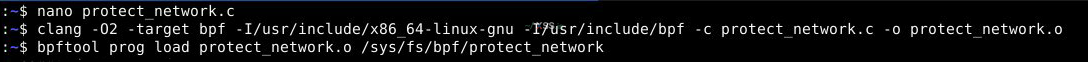

Вот код, который мониторит TCP-пакеты, блочит IP из чёрного списка и логирует хешированные IP для приватности. Используем мапу для хранения чёрного списка и счётчиков заблокированных пакетов:

Код работает так: он ловит к XDP и анализирует входящие TCP-пакеты на уровне ядра. Для этого он использует две хеш-таблицы: blacklist для хранения IP-адресов (ключ - __u32, значение - счётчик блокировок, до 1000 записей) и ip_stats для подсчёта пакетов по хешированным IP (ключ - __u64, значение - счётчик пакетов, до 10000 записей). Функция simple_hash применяет мультипликативный хеш Кнута к IP-адресу, чтобы скрыть его для приватности. Основная функция protect_network получает контекст пакета (xdp_md), проверяет, что это Ethernet-пакет с IP и TCP заголовками, и не выходит за границы данных. Если протокол не TCP, пакет пропускается (XDP_PASS). Далее проверяется, есть ли IP отправителя в blacklist: если да, счётчик блокировок увеличивается, пакет отбрасывается (XDP_DROP), и в лог пишется сообщение через bpf_printk. Если IP не в чёрном списке, его хешируют, и в ip_stats обновляется или создаётся запись с количеством пакетов. В лог выводится хешированный IP и порт назначения (преобразованный через bpf_ntohs).

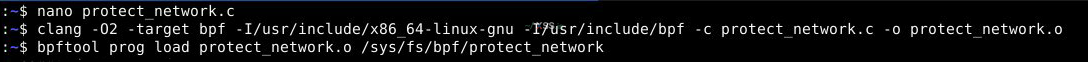

Сначала компилируем eBPF-программу:

Эта команда компилирует исходник protect_network.c в объектный файл protect_network.o с оптимизацией (-O2) для eBPF. Флаги -I добавляют нужные заголовочные файлы для работы с BPF.

Дальше загружаем программу в ядро:

Команда загружает скомпилированный объект в ядро и закрепляет его в /sys/fs/bpf/protect_network для дальнейшего использования.

Теперь прикрепляем программу к интерфейсу, например, eth0, в режиме XDP:

Это прикрепляет eBPF-программу к eth0, чтобы она обрабатывала входящие пакеты на уровне XDP (eXpress Data Path) для максимальной скорости.

Чтобы проверить, работает ли программа, смотрим логи ядра:

Для блокировки конкретного IP, например, 192.168.0.1, добавляем его в чёрный список:

Здесь мы обновляем карту blacklist в программе, добавляя IP 192.168.0.1 (в hex: c0 a8 00 01). Это блокирует все TCP-пакеты с этого адреса.

Как ещё один пример, я написал код для ограничения скорости TCP-пакетов с одного IP. Это не очень полезно для приватности, но хорошо работает в защите от DDoS-атак.

Вот сам код:

Программа начинает работу с загрузки в ядро через XDP, где она прикрепляеться к сетевому интерфейсу для обработки входящих пакетов. Она создаёт хеш-таблицу rate_limit с ключами __u32 для IP-адресов и значениями из двух __u64 (время последнего пакета и счётчик пакетов), вмещая до 1000 записей. Функция simple_hash генерирует хеш IP-адреса через XOR с его сдвинутой версией, чтобы не логировать реальные IP и сохранить приватность. Для каждого входящего пакета программа проверяет, является ли он Ethernet-пакетом с IP и TCP заголовками, пропуская всё остальное через XDP_PASS. Если это TCP-пакет, она берёт текущее время в наносекундах через bpf_ktime_get_ns и смотрит IP отправителя в rate_limit. Если запись есть и с последнего пакета прошло меньше секунды (ONE_SECOND = 1 млрд наносекунд), а счётчик достиг 100 (MAX_PACKETS), пакет отбрасывается через XDP_DROP, и в лог пишется сообщение через bpf_printk о превышении лимита. Если лимит не достигнут, счётчик пакетов увеличивается. Если секунда прошла, время и счётчик сбрасываются. Для нового IP создаётся запись с текущим временем и счётчиком 1. Хешированный IP каждого пакета логируется через bpf_printk для анализа.

Для проверки ограничения скорости TCP-пакетов сохраняем код в rate_limit.c и компилируем:

clang -O2 -target bpf -I/usr/include/x86_64-linux-gnu -I/usr/include/bpf -c rate_limit.c -o rate_limit.o

Дальше загружаем программу в ядро:

Теперь прикрепляем программу к интерфейсу, например, eth0, в режиме XDP:

Ручная подделка загловков пакетов

DPI может проверять заголовки пакетов - IP-адреса, порты, протоколы - и даже анализировать шаблоны, чтобы понять, что вы используете Tor, Shadowsocks и тд. Но как же от этого защититься? Обычно от таких проверок спасает подделка заголовков пакетов. Она делает пакеты похожими на обычный HTTPS-трафик, SSH или даже что-то совсем безобидное, вроде DNS-запросов. Обычно это бремя ложится на плечи самих протоколов. Но бывает они этим просто не занимаются. Поэтому иногда приходится брать всё в свои руки и настраивать её самостоятельно. В этом разделе я расскажу, как это сделать.

Спуфинг заголовков пакетов работает через создание пакетов с изменёнными полями, например, IP-адресом источника, адресом назначения, портом или протоколом. Например, вы можете отправить TCP-пакет, где IP-адрес источника будет поддельным, чтобы скрыть ваш реальный адрес, или изменить порт, чтобы трафик выглядел как обычный запрос. Например, если замаскировать порт или протокол, можно сделать так, чтобы ваш трафик выглядел как поток с популярного сайта, например, YouTube или Google, а это снижает вероятность блокировки.

Однако спуфинг требует осторожности: некорректно сформированные пакеты могут быть отброшены сетевыми устройствами, и в целом это может сломать передачу данных, если делать всё неаккуратно.

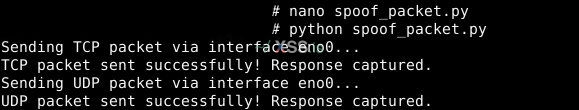

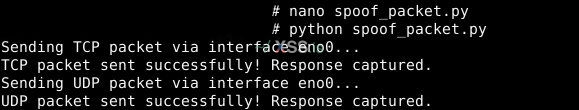

Теперь покажу, как это делаеться. В качестве первого примера я написал простой скрипт на Python с отправкой поддельного TCP-пакета:

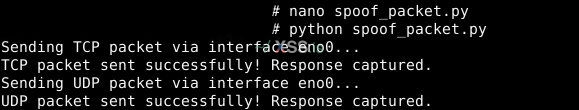

Проверяем:

Скрипт начинает работу с вызова функции send_spoofed_packet, которая формирует и отправляет поддельный TCP/UDP-пакет через интерфейс(по умолчанию eth0). Она задаёт фейковый MAC-адрес и IP для отправителя, а для получателя выбирает 93.184.216.34 для TCP или 8.8.8.8 для UDP. Создаётся Ethernet-фрейм с широковещательным MAC получателя (ff:ff:ff:ff:ff:ff), затем IP-пакет с фейковыми адресами. Для TCP формируется пакет с исходным портом 12345, целевым портом 443 и флагом SYN, а для UDP - с портом 53(DNS). Пакет собирается через Scapy в виде ether/ip/transport и отправляется через sendp с параметром return_packets=True, чтобы захватить ответы, если они есть. Процесс логируется: перед отправкой выводится сообщение, а после - успех или отсутствие ответа.

Дальше я подумал что просто отправлка пакетов это конечно полезно, но не очень реалистично. Потому для ещё одного примера этого я написал на C++ с перехватом пакетов на определённый сайт и их модификацией:

Проверяем:

Программа начинает работу с инициализации генератора случайных чисел для создания новых id пакетов. Затем она открывает сетевой интерфейсс. Если интерфейс не открывается, программа завершается с ошибкой. Далее компилируется и устанавливается фильтр "icmp and dst host 209.85.233.113", который ловит только ICMP-пакеты, направленные к IP Google. После этого запускается бесконечный цикл, который перехватывает пакеты и передаёт их в функцию process_packet. Эта функция проверяет, что размер пакета не превышает 1500 байт, и извлекает IP-заголовок, смещённый на 14 байт. Если протокол пакета - ICMP и тип - ECHO (пинг-запрос), программа выводит исходный и целевой IP, а также ID пакета. Затем создаётся сырой сокет для контроля заголовков. Пакет копируется в новый буфер, его IP-идентификатор заменяется случайным числом, а контрольная сумма пересчитывается через функцию checksum. Если в пакете есть полезная нагрузка, она заменяется случайными байтами. Контрольная сумма ICMP также пересчитывается, и модифицированный пакет отправляется.

Настройка рандомизации задержек пакетов

Из похожей оперы идёт рандомизация временных меток и сетевых пакетов. DPI часто ищут характерные шаблоны: регулярные интервалы между пакетами, специфические размеры или последовательности, благодаря чему, к примеру, могут блокировать трафик. А рандомизация ломает эти шаблоны: добавляя случайные задержки, вы делаете трафик похожим на обычный. Конечно, только этого недостаточно, и хорошо бы использовать дополнительные методы и, в идеале, вообще незаметные протоколы типа VLESS, о которых я говорил выше. Тем не менее, это весьма полезно.

Обычно это работает через добавление случайных задержек к пакетам, чтобы интервалы между ними не были регулярными. Это можно сделать на уровне сетевого интерфейса, перехватывая пакеты и задерживая их отправку. В Linux такое делается с помощью утилиты

Впрочем, сильно играть с этим тоже не стоит, ведь, как вы понимаете, если переборщить с задержками, трафик может стать очень медленным, а если что-то сделать неаккуратно, можно вообще начать терять пакеты данных.

Настройка реализации задержек

Первым расскажу самый простой способ как добавить случайные задержки к трафику на Linux, а именно с помощью инструмента tc.

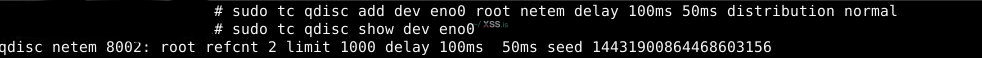

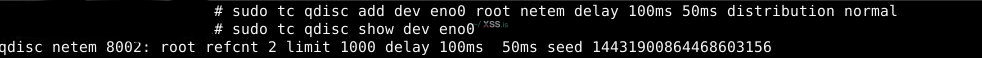

Для этого нужно создать правило на нужный тебе интерфейс:

Эта команда настраивает интерфейс eth0, добавляя базовую задержку 100 мс с вариацией ±50 мс по нормальному распределению

После чего можно проверить, применились ли правила:

Чтобы проверить, как задержки влияют на отправку пакетов можно выполнить команду:

Вот команда если нужно убрать правило:

Так же можно написать скрипт на Python, который добавляет задержки через перехват пакетов библиотекой Scapy:

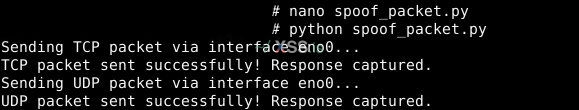

Проверяем:

Код начинает свою работу с того что, сначала check_interface проверяет, доступен ли интерфейс, устанавливая его в Scapy через conf.iface. Затем запускается sniff из Scapy, который перехватывает пакеты на указанном интерфейсе, применяя фильтр "tcp" и передавая каждый пакет в packet_handler. Эта функция проверяет, есть ли в пакете слои IP и TCP. Если да, счётчик packet_count увеличивается, генерируется случайная задержка от 0.05 до 1 секунды через random.uniform, и программа ждёт это время с помощью time.sleep. Затем пакет пересылается через send без изменений, а в консоль выводится сообщение с номером пакета, задержкой и IP-адресами отправителя и получателя. Если пакет не TCP или не IP, он пропускается, и в консоль пишется его краткое описание через packet.summary.

Настройка GRE-туннелей

Ещё одна интересная вещь, чтобы скрыть свои пакеты, - это GRE. Это протокол туннелирования, который прячет твои сетевые пакеты, упаковывая их в новые, скрывая их содержимое от DPI. Работает на сетевом уровне: берёт твой IP-пакет, заворачивает в новый с GRE-заголовком и отправляет через интернет. Для провайдера это выглядит как обычный обмен между двумя IP, без намёков на VPN или другие сервисы, которые ты исользуешь. GRE использует IP-протокол 47, а не TCP/UDP-порты, он менее заметен для фильтров, чем, например, OpenVPN.

Но есть и минусы, сам по себе GRE не шифрует данные, но скрывает внутренние заголовки (IP, порты), что мешает DPI их анализировать. А поскольку GRE использует IP-протокол 47, а не TCP/UDP, он реже цепляется фильтрами, чем, скажем, OpenVPN. Но нужен сервер на другом конце, настроенный под GRE. Без шифрования данные можно перехватить, так что лучше юзать с IPsec. Даже без этого GRE хорошо маскирует трафик.

Однако GRE требует, чтобы сервер на другом конце тоже был настроен для работы с туннелем, и без шифрования содержимое пакетов остаётся уязвимым для перехвата на пути. Поэтому лучше комбинировать GRE с IPsec, чтобы зашифровать туннель. Правда если использовать стронние шифрование GRE менее эффективно маскирует трафик.

Теперь о реализации. Дальше я расскажу, как создать GRE-туннель между сервером и клиентом на Debian, чтобы перенаправлять трафик.

Настройка GRE-туннеля на сервере

Сначала необходимо созоздать GRE-туннель на сервере:

Эти команды делают туннель gre1, связывая сервер с клиентом . Параметр ttl 255 задаёт время жизни пакетов, gre1 активируется, а 192.168.10.1/24 - это внутренний IP туннеля на сервере.

Теперь настраиваем маршрутизацию и NAT, чтобы клиентский трафик шёл через сервер:

Первая команда включает пересылку IP-пакетов, чтобы сервер пропускал трафик. Вторая настраивает NAT через MASQUERADE, чтобы пакеты от клиента выходили в интернет с IP сервера, пряча его настоящий адрес.

Если хочешь, чтобы правила iptables сохранялись после перезагрузки (это опционально):

Настройка GRE-туннеля на клиенте

Теперь расскажу, как настроить GRE-туннель на клиенте. Первым делом аналогично серверу создаём сам GRE-туннель:

Эти команды создают туннель gre1, связывая клиент с сервером. Затем активируем туннель и задаём ему внутренний IP 192.168.10.2/24.

Дальше настраиваем маршрутизацию, чтобы весь трафик шёл через туннель:

Эта команда направляет весь интернет-трафик через gre1 к серверу (192.168.10.1 - IP сервера в туннеле).

Если в системе уже есть другой маршрут по умолчанию, он может мешать, так что удаляем его:

Проверяем, работает ли туннель:

Если пинг проходит, туннель работает.

Теперь проверяем, идёт ли трафик через туннель:

Для пущей безопасности можно добавить шифрование через IPsec.

Для этого нужно установить нужный пакет:

Потом создать конфиг IPsec:

И вставить туда текст:

Этот конфиг настраивает IPsec-транспорт с шифрованием AES-128-GCM и автоматическим запуском.

Теперь настраиваем общий ключ:

И последним следует запустить IPsec:

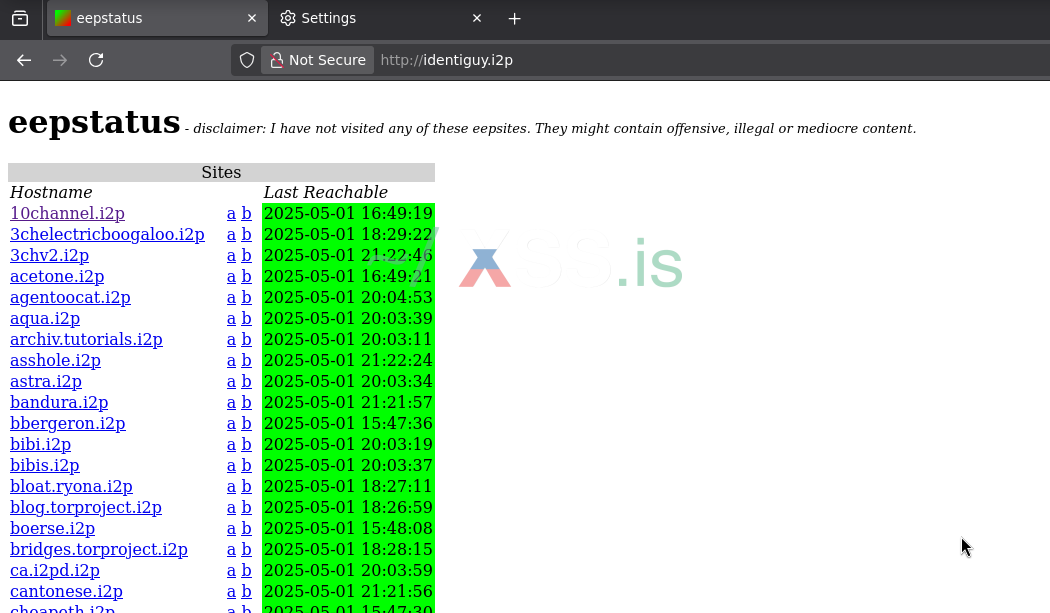

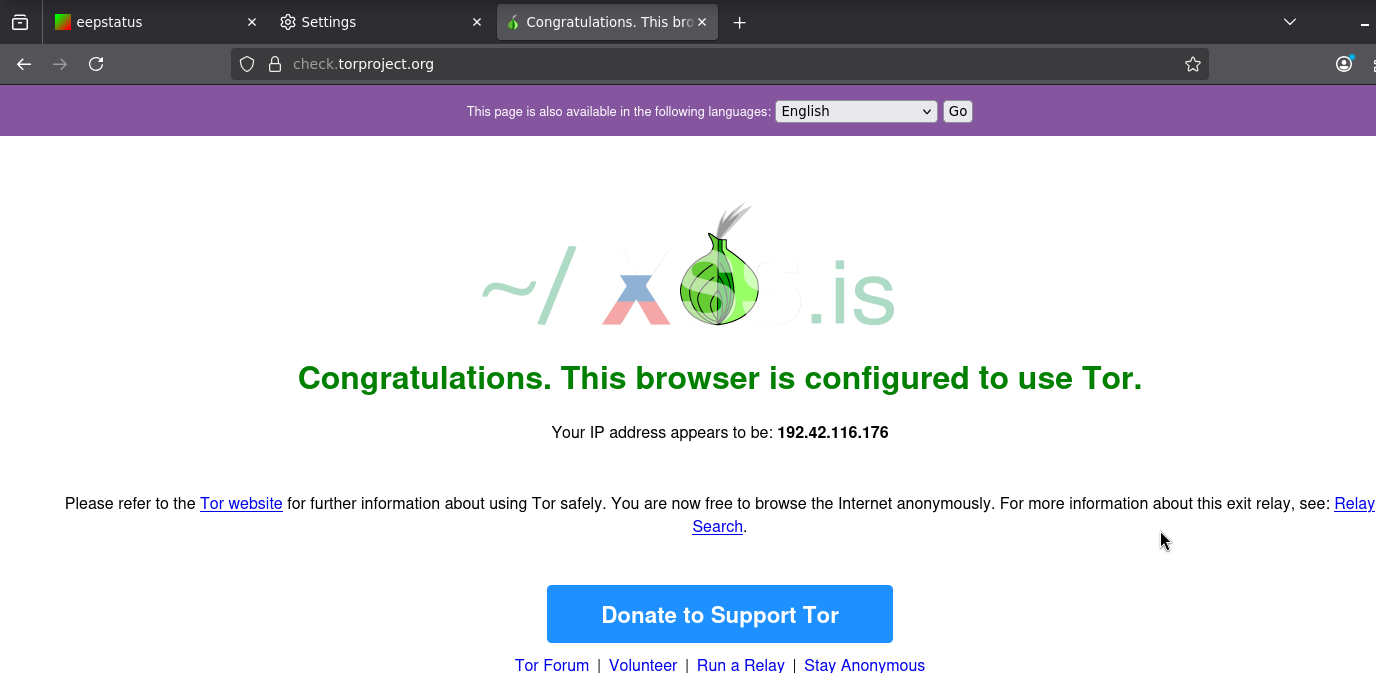

Динамическое изменение выходной ноды Tor

Tor помогает защитить вашу приватность благодаря луковому шифрованию: на каждом этапе данные покрываются новым слоем шифра, скрывая источник и пункт назначения. Последний узел в цепочке, называемый выходной нодой, определяет, с какого IP-адреса вы появляетесь в интернете. Но если эта нода остаётся неизменной и соединение длится долго, это может стать заметным отпечатком, по которому вас могут отследить.