Пожалуйста, обратите внимание, что пользователь заблокирован

Да вот вам статья, чтоб не ссорились

habr.com

Сорян, я сам ковырялся в железе начиная от ZX80 аж в 1991г и знаю все опкоды и номера назначаемых биосом портов и адресов наизусть в том числе новейших . Вам лучше не ругаться друг на друга, тем более на паблике по пустякам себя позорить.

habr.com

Сорян, я сам ковырялся в железе начиная от ZX80 аж в 1991г и знаю все опкоды и номера назначаемых биосом портов и адресов наизусть в том числе новейших . Вам лучше не ругаться друг на друга, тем более на паблике по пустякам себя позорить.

читайте маны, к примеру

www.intel.com

www.intel.com

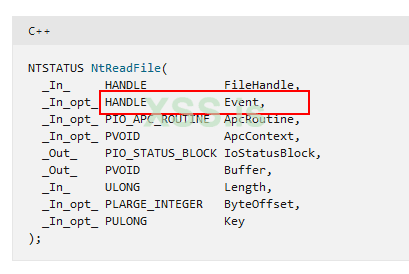

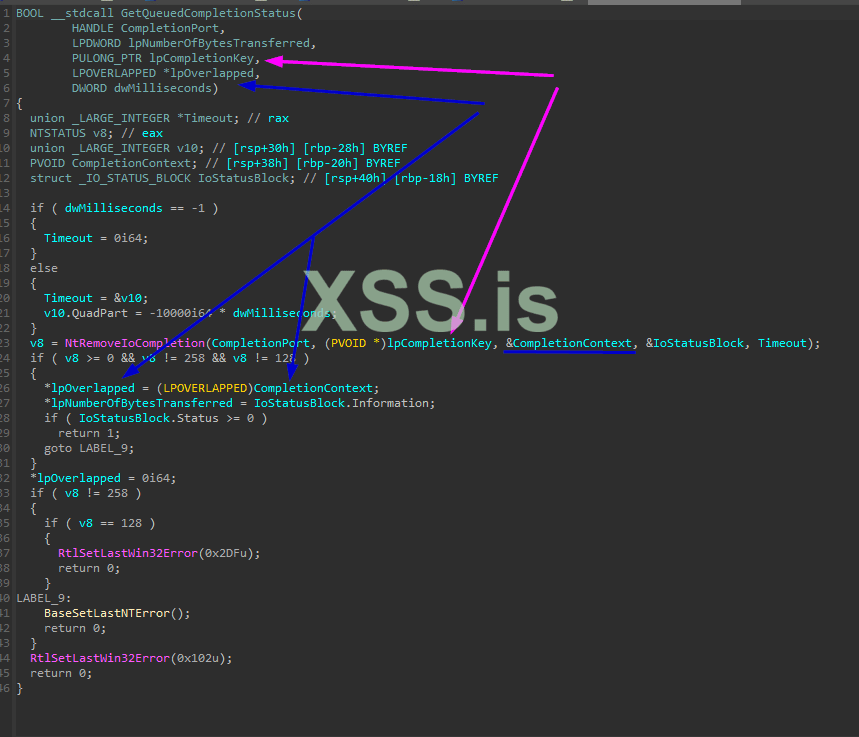

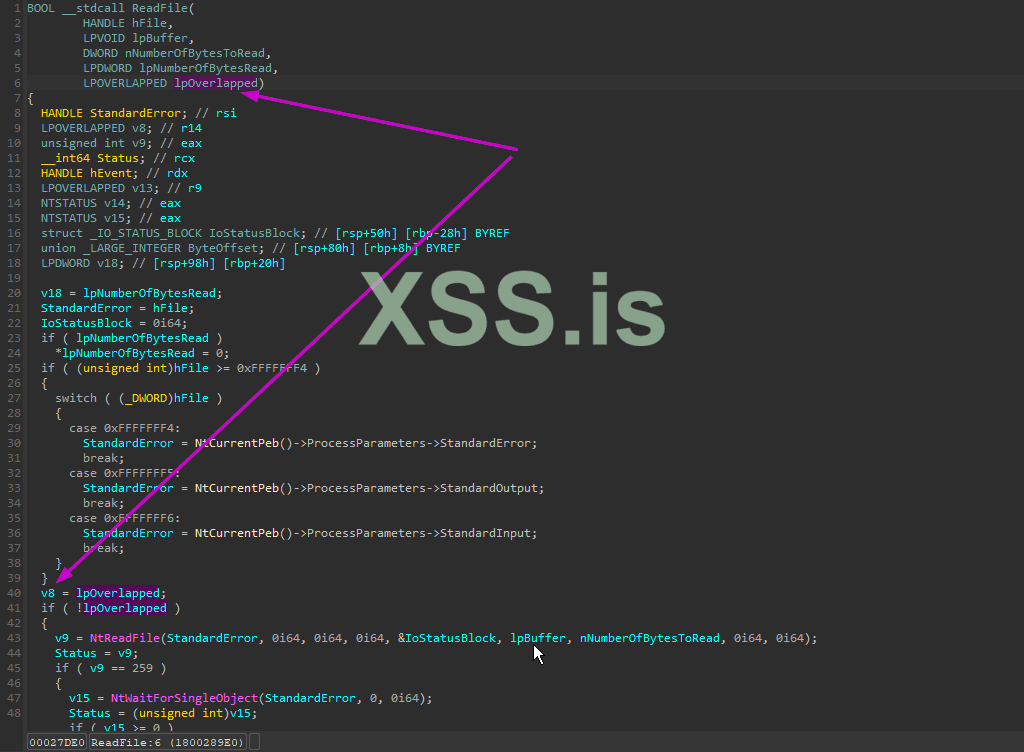

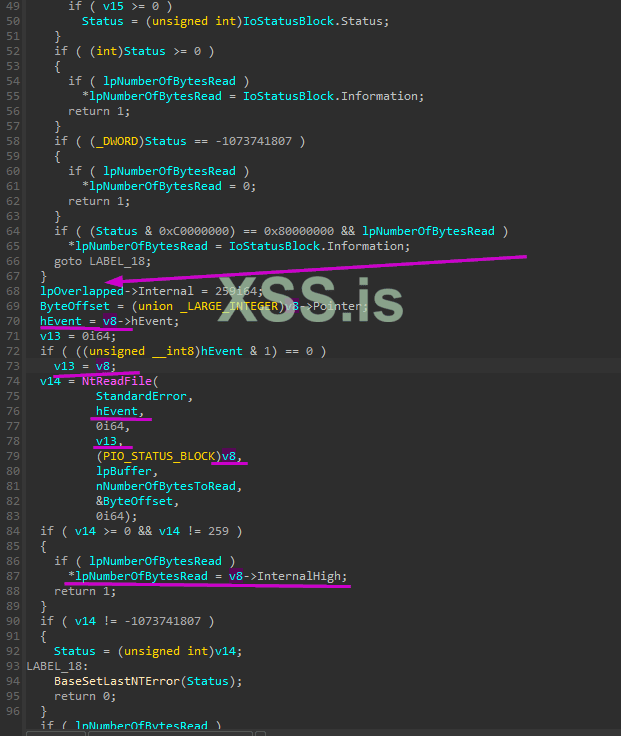

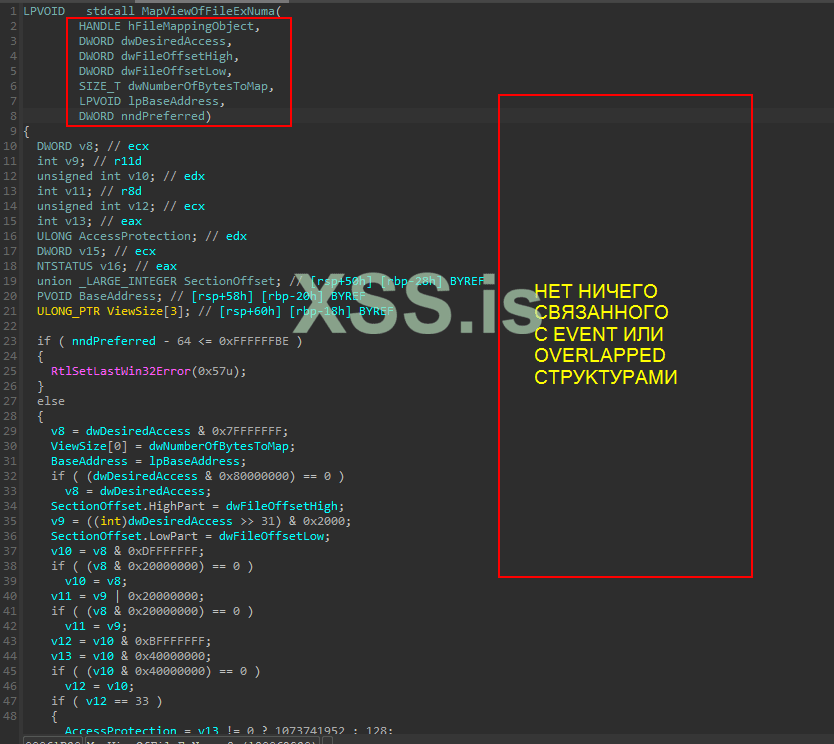

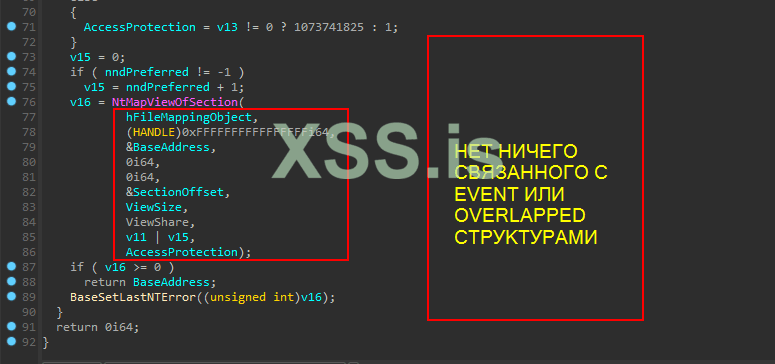

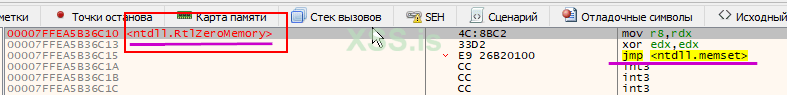

ÐоÑÑ Ð·Ð°Ð²ÐµÑÑÐµÐ½Ð¸Ñ (Completion Port)

ÐÑивеÑ. СейÑÐ°Ñ Ñ ÑаÑÑÐºÐ°Ð¶Ñ Ð²Ð°Ð¼ о меÑанизме IO Completion Ports в Windows. РазÑабоÑÑики опиÑÑваÑÑ Ð¿Ð¾ÑÑ Ð·Ð°Ð²ÐµÑÑÐµÐ½Ð¸Ñ ÐºÐ°Ðº «ÑÑедÑÑво, повÑÑаÑÑее пÑоизводиÑелÑноÑÑÑ Ð¿Ñиложений, ÑаÑÑо иÑполÑзÑÑÑÐ¸Ñ Ð¾Ð¿ÐµÑаÑии...

читайте маны, к примеру

Software Developer Manuals for Intel® 64 and IA-32 Architectures

Software developer manuals and documentation for Intel® 64 and IA-32 Architectures.

Последнее редактирование: