Привет , форум. Как вы понимаете я только начинаю вникать в эту тему. Прошу прощения если вопрос уже был, а я не смог найти ветку.

В нескольких видео/статьях встретил упоминание сканнера V3n0M (https://github.com/v3n0m-Scanner/V3n0M-Scanner). Решил попробовать с ним поработать. Столкнулся с проблемой.

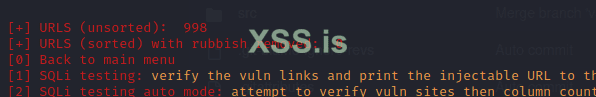

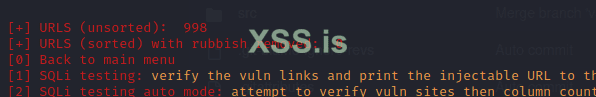

Она состоит в том что он находит x url по своей базе дорок (берет их рандомно, насколько я понял) но после удаления мусора остается - 0 урлов. В нем есть ф-ция чека на скули, он проходит по сайтам что прошли сортировку, сортировку сайты не проходят - нет чека.

На скриншоте.

Брал разные домены, брал одни и теже домены, чекал как и на домены стран, так и на домены типа хуз, так и на весь интернет. Максимум чекал по базе из 1200 дорок на 50 страниц (нашло 10к урлов).

Видел стату в статье на 1200 урлов - 200 валидных под дальнейший чек на скули.

Чекал как на статичном IP так и через tor.

Вопрос - Это есть норма и нужно продолжать чек, просто не фартануло? У меня не верно установленны зависимости pip? (возможно зависимость url)

Или возможно это вообще левый сканнер и я зря его использую?

Если данный сканнер не лучшее решение, подскажите пожалуйста с каким поработать в первую очередь. Слышал про окунь. Продолжать с него?

В нескольких видео/статьях встретил упоминание сканнера V3n0M (https://github.com/v3n0m-Scanner/V3n0M-Scanner). Решил попробовать с ним поработать. Столкнулся с проблемой.

Она состоит в том что он находит x url по своей базе дорок (берет их рандомно, насколько я понял) но после удаления мусора остается - 0 урлов. В нем есть ф-ция чека на скули, он проходит по сайтам что прошли сортировку, сортировку сайты не проходят - нет чека.

На скриншоте.

Брал разные домены, брал одни и теже домены, чекал как и на домены стран, так и на домены типа хуз, так и на весь интернет. Максимум чекал по базе из 1200 дорок на 50 страниц (нашло 10к урлов).

Видел стату в статье на 1200 урлов - 200 валидных под дальнейший чек на скули.

Чекал как на статичном IP так и через tor.

Вопрос - Это есть норма и нужно продолжать чек, просто не фартануло? У меня не верно установленны зависимости pip? (возможно зависимость url)

Или возможно это вообще левый сканнер и я зря его использую?

У вас должно быть более 1 реакций для просмотра скрытого контента.

Цель - найти уязвимые ресурсы для практики раскрутки скули в sqlmap.

Если данный сканнер не лучшее решение, подскажите пожалуйста с каким поработать в первую очередь. Слышал про окунь. Продолжать с него?

Последнее редактирование: