Автор: krect

Написано специально для xss.pro

Пособие по созданию LLM для самых маленьких

Всем привет, давайте разберем, зачем вообще нужна своя LLM?

Многие устали от "извините, не могу с этим помочь" Когда мы что то спрашиваем у ИИ, мы хотим получить то что нам нужно, а не предупреждения и перечень законов. Поэтому и появились штукпи по типу WormGPT. Крч сегодня напишу как сделать свою нейру без фильтров, поселим мы её у себя на машине, без всяких там OpenAI, без логов, без законов.

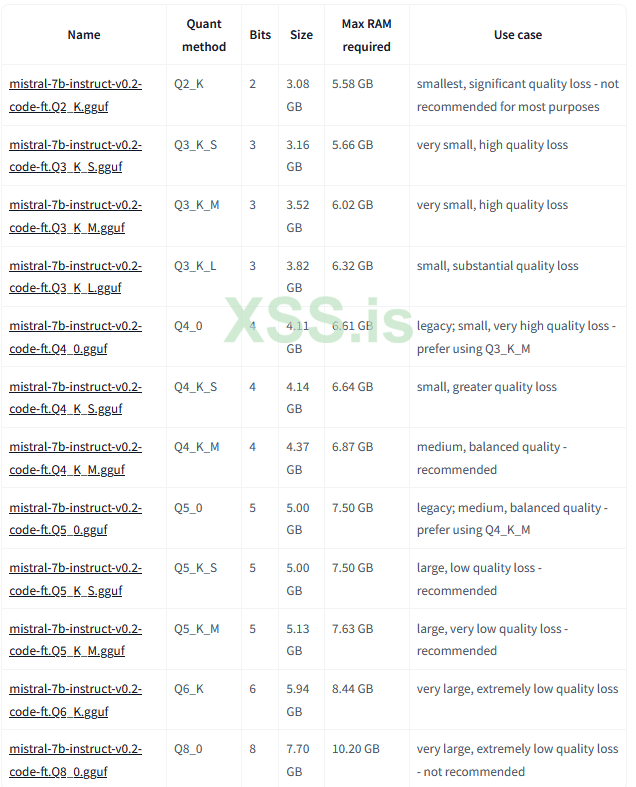

Заходим сюда >тык< и качаем модель, по кнопочке... не поверете, download!

Пока у нас качается моделька размером почти в 6 гигов мы летим на наш диск и создаем папку AI.

Получаеться что то по типу БуковкаВашегоДиска:/AI. Быстренько заходим в папочку и создаем папку webui

Теперь летим на сюда >тык< , жмем на кнопочку Code и Download ZIP.

Разархивируем все файлы в папку webui.

Гайс, открываем повершел от имени администратора и выкатываем что то типо:

cd БуковкаВашегоДиска:\AI\webui

.\start_windows.bat

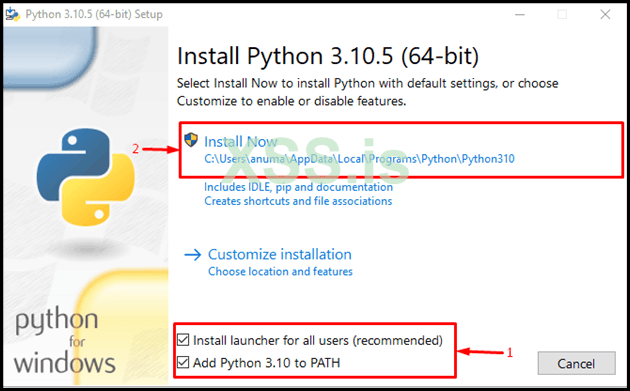

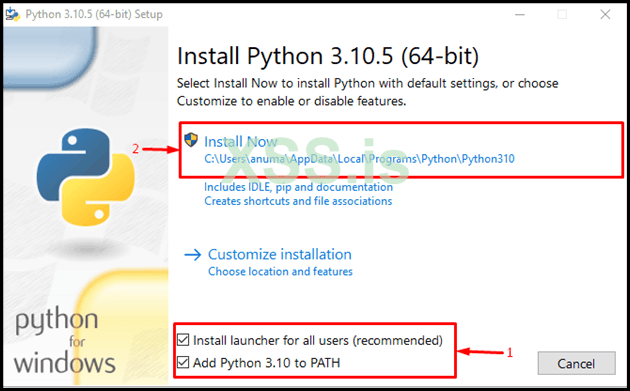

Если потребует питон, то идем сюда >тык< и все как на скрине делаем

Поздравляю. Мы почти у цели. Теперь ждем пока докачается наша модель, ищем папку

БукваДиска:\AI\webui\user_data\models и кидаем туда файл модели

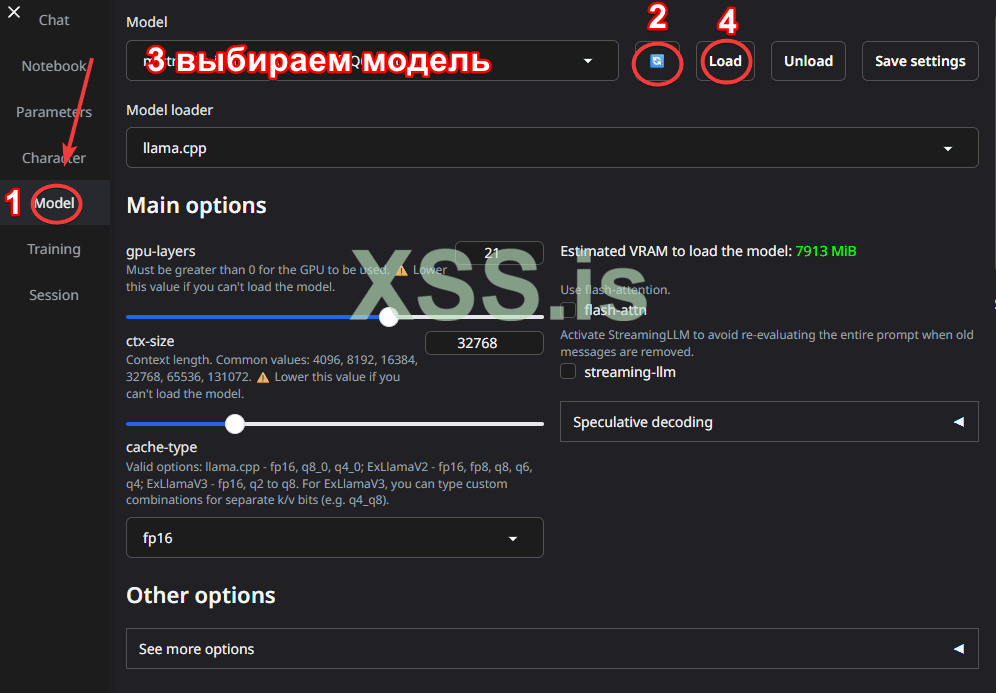

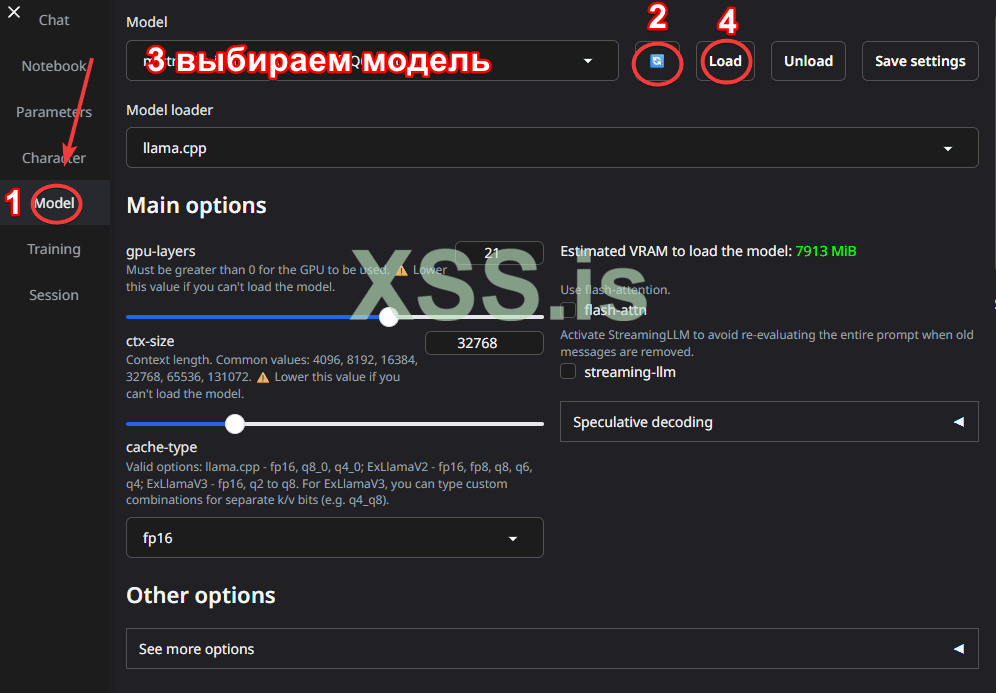

Запускаем start_windows.bat в папке webgui и у нас открывается localhost. Делаем все как на скрине

Вуаля. Кидаем любой джейлбрейк промпт - и едем покорять мир!

Промпты >тык<

Написано специально для xss.pro

Пособие по созданию LLM для самых маленьких

Всем привет, давайте разберем, зачем вообще нужна своя LLM?

Многие устали от "извините, не могу с этим помочь" Когда мы что то спрашиваем у ИИ, мы хотим получить то что нам нужно, а не предупреждения и перечень законов. Поэтому и появились штукпи по типу WormGPT. Крч сегодня напишу как сделать свою нейру без фильтров, поселим мы её у себя на машине, без всяких там OpenAI, без логов, без законов.

Заходим сюда >тык< и качаем модель, по кнопочке... не поверете, download!

Пока у нас качается моделька размером почти в 6 гигов мы летим на наш диск и создаем папку AI.

Получаеться что то по типу БуковкаВашегоДиска:/AI. Быстренько заходим в папочку и создаем папку webui

Теперь летим на сюда >тык< , жмем на кнопочку Code и Download ZIP.

Разархивируем все файлы в папку webui.

Гайс, открываем повершел от имени администратора и выкатываем что то типо:

cd БуковкаВашегоДиска:\AI\webui

.\start_windows.bat

Если потребует питон, то идем сюда >тык< и все как на скрине делаем

Поздравляю. Мы почти у цели. Теперь ждем пока докачается наша модель, ищем папку

БукваДиска:\AI\webui\user_data\models и кидаем туда файл модели

Запускаем start_windows.bat в папке webgui и у нас открывается localhost. Делаем все как на скрине

Вуаля. Кидаем любой джейлбрейк промпт - и едем покорять мир!

Промпты >тык<

Последнее редактирование: