Пожалуйста, обратите внимание, что пользователь заблокирован

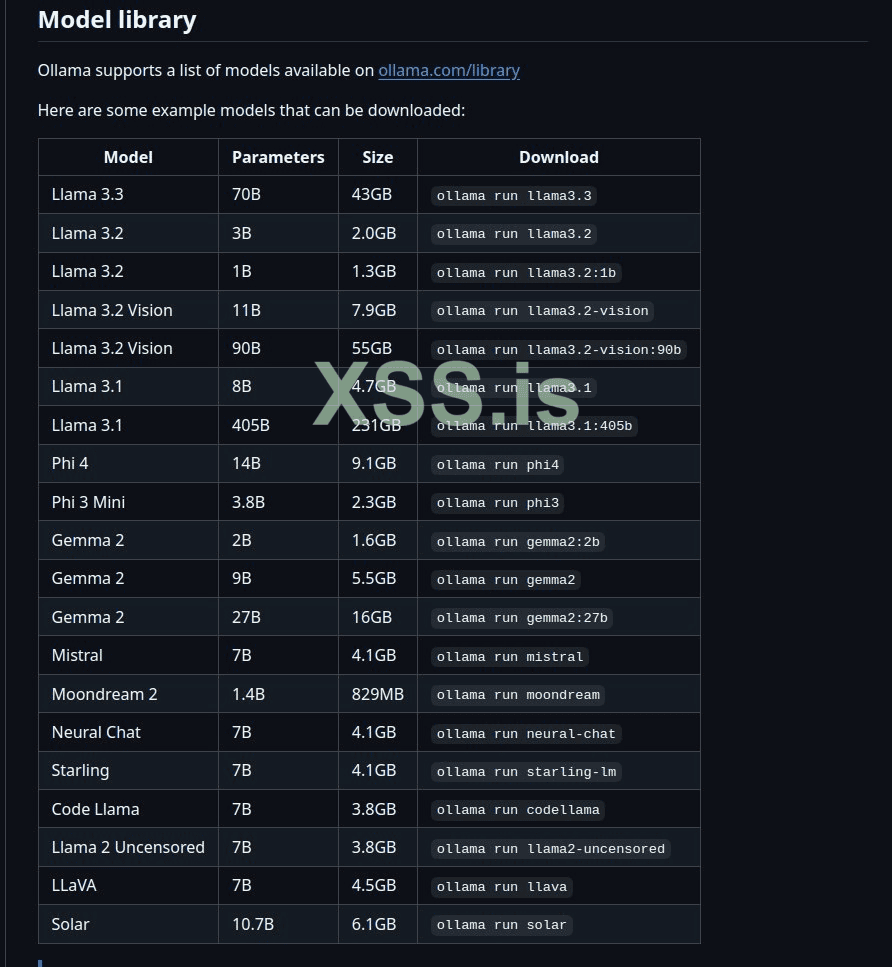

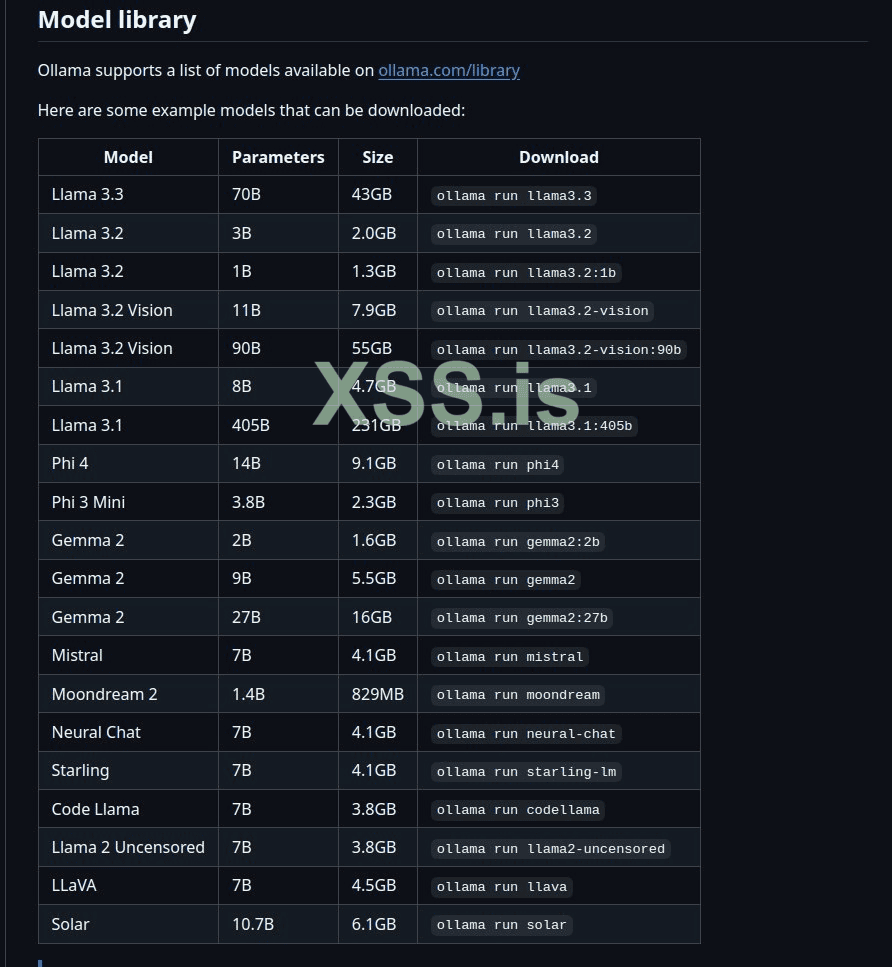

Какую модель выбрать? На что обратить внимания?

Все же лучше которая весит больше или все же лучше которая новее типо по версий?

В какой больше информаций и считается новей?

Все же лучше которая весит больше или все же лучше которая новее типо по версий?

В какой больше информаций и считается новей?