Автор chiefchain

Статья написана для Конкурса статей #10

Привет, друг. Ты, наверное, как и я, уже заметил, что 90% статей про "крутые инструменты" — это либо реклама какого-то левого софта; софт, который не работает, либо инструкции, которые требуют таких вложений, что проще уже самому всё написать.

Вот, например, "MacOS стилер!" — да он даже не запускается. И самое смешное, что все логи хранятся на стороннем сервисе. Ну, конечно, кто же ещё будет читать твои пароли, если не какой-то левый чувак с доступом к этому сервису? И если задевать в общем, то это паблик код, который уже сто раз разбирали на конференциях, сливали на эксплоите, лежит пачками на гитхабе. Но нет, давайте продолжать впаривать его как что-то новое и революционное, которым мы даже не сможем попользоваться, ведь нужно еще допилить тысяча раз и сделать миллион фиксов.

Или вот, "Добыча и захват корпоративных доступов Mikrotik с использованием MIKRONET!" — ну, конечно, я щас брошу всё, заложу машину, жену и собаку, чтобы заплатить за доступ к брутеру. Потому что, иначе как ещё я смогу узнать, как взламывать роутеры, которые уже сто лет как уязвимы? Инструкция, конечно, есть, но чтобы ей воспользоваться, надо сначала выложить 2800$. И самое забавное, что на протяжении всей статьи тебе втирают, как круто и просто пользоваться этим MIKRONET. Типа, "вот тут нажми, тут подожди, тут получи результат". Но, чтобы нажать, подождать и получить результат, надо сначала заплатить неплохую сумму. Это как предлагать рецепт борща, но чтобы узнать, сколько соли добавить, надо сначала купить у автора кастрюлю за три зарплаты.

Честно, надоели уже эти стиллеры. Ну, это же просто сборка на коленке, которую любой школьник, прочитавший пару статей, может сделать за вечер. И самое смешное, что их уже куча — гитхаб просто переполнен такими штуками. Каждый день появляется новый "уникальный стилер", который на деле оказывается перепакованной херней, которую уже сто раз видели.

И знаете, что самое обидное? Я уважаю ваши статьи и время, которое вы потратили на их написание. Но проблема в том, что простой юзер, который открывает эту статью в надежде что-то попробовать, не сможет взять и начать использовать это. То ли надо платить, то ли допиливать, то ли разбираться с кучей нюансов, которые не описаны.

Ладно, хватит нытья. Извините за циничность, но, иногда надо выпустить пар. Теперь вернёмся к теме, которую я выбрал, и которая, надеюсь, будет полезной без лишних заморочек.

Кстати, ты уже посмотрел видео, которое я прикрепил в начале статьи? Оно полностью сгенерировано ИИ. Ну что, до сих пор думаешь, что ИИ не способен нормально связывать движение губ, и того что он говорит, или где-то на видео заметны подтеки, или артефакты? Я лично не заметил ничего критического, чтоб человек сразу сказал: "А ну это ИИ, все понятно".

Мы разберём практически всё, что касается AI-генерации:

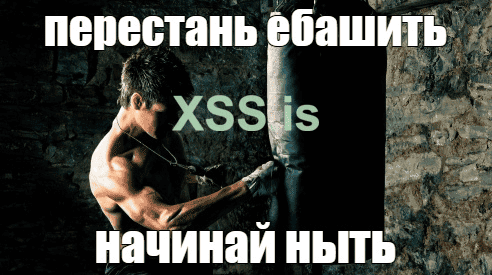

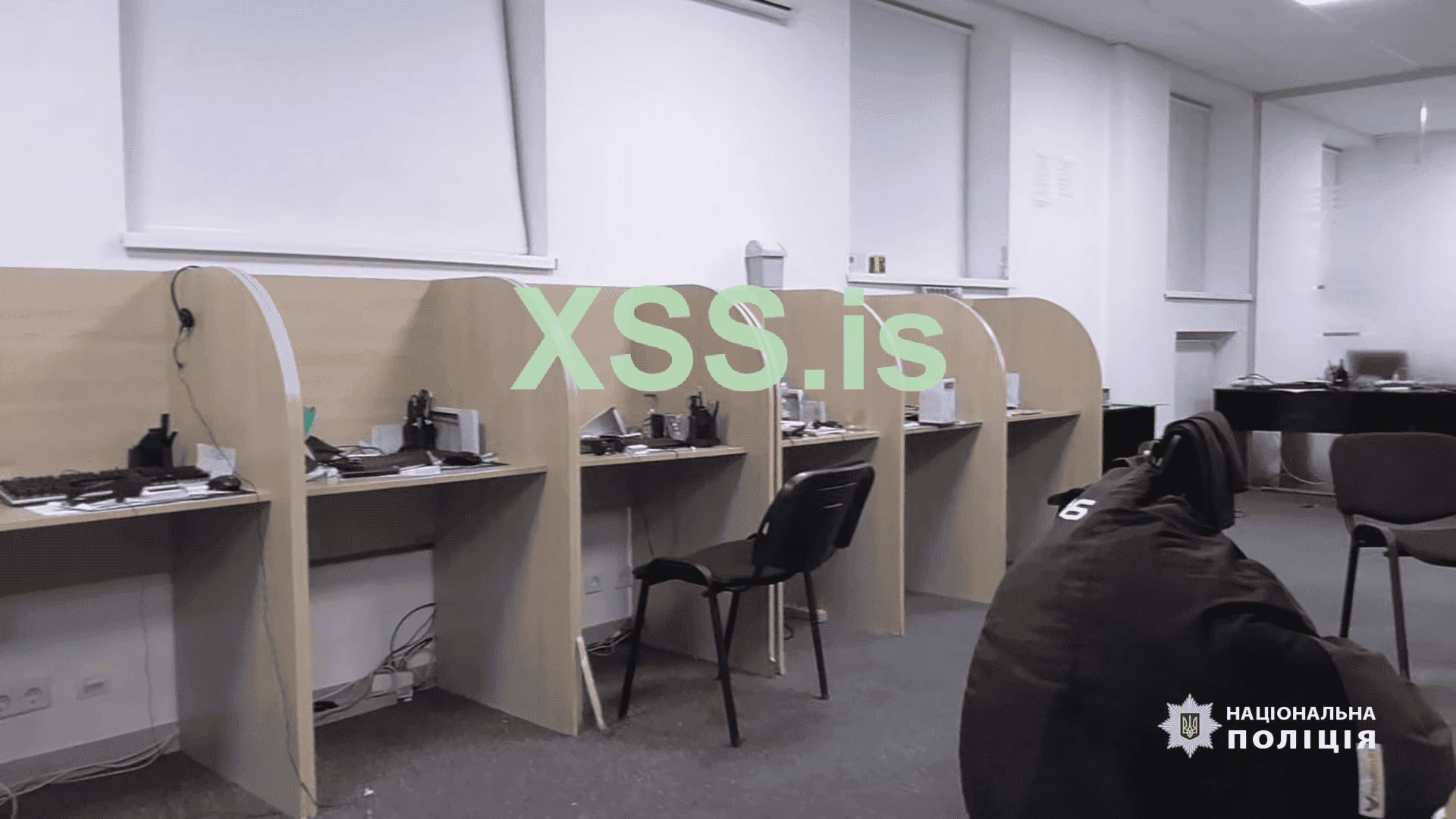

Телефонные мошенники уже давно перешли на новый уровень. Они больше не тратят время на примитивные схемы с "ваш сын в беде" или "ваш договор скоро истечет". Теперь у них есть технологии, которые могут скопировать голос твоего сына, дочери или даже начальника. И знаешь, что самое мерзкое? Они спокойно и свободно используют это в своих целях, как будто это просто ещё один рабочий инструмент. А досадное в том,что они целятся в наших бабушек, дедушек, родителей. Людей, которые не всегда разбираются в технологиях, но доверяют своим близким. И вот они используют их доверие, чтобы выманивать последние деньги. И знаешь, что самое пиздецовое во всём этом? Это то, насколько легко и доступно всё это делается. Тебе не нужно быть гением или иметь доступ к каким-то секретным технологиям. Всё, что нужно, — это зайти на HuggingFace или любой другой подобный ресурс, и там уже лежат готовые модели для клонирования голосов. Это может быть не 1 в 1, но кому какая разница, если это будет звучать достаточно похоже? А теперь представь: звонок в два часа ночи. Трубку берёт бабушка, которая только что проснулась. На том конце провода — голос, который звучит как её внук. Он говорит, что попал в беду, и нужно срочно перевести деньги. Кто в таком состоянии будет анализировать, насколько идеально совпадает тембр или интонация? Правильно, никто. Человеку будет по барабану, потому что в такой ситуации включаются эмоции, а не логика. И вот эти уёбки с "офисов из Днепра" прекрасно это понимают. Они знают, что их сгенерированный голос не должен быть идеальным. Достаточно того, чтобы он звучал "похоже". А дальше срабатывает человеческий фактор: страх, паника, желание помочь близкому. И бабушка, которая всю жизнь копила на похороны, отдаёт последние деньги, думая, что спасает внука.

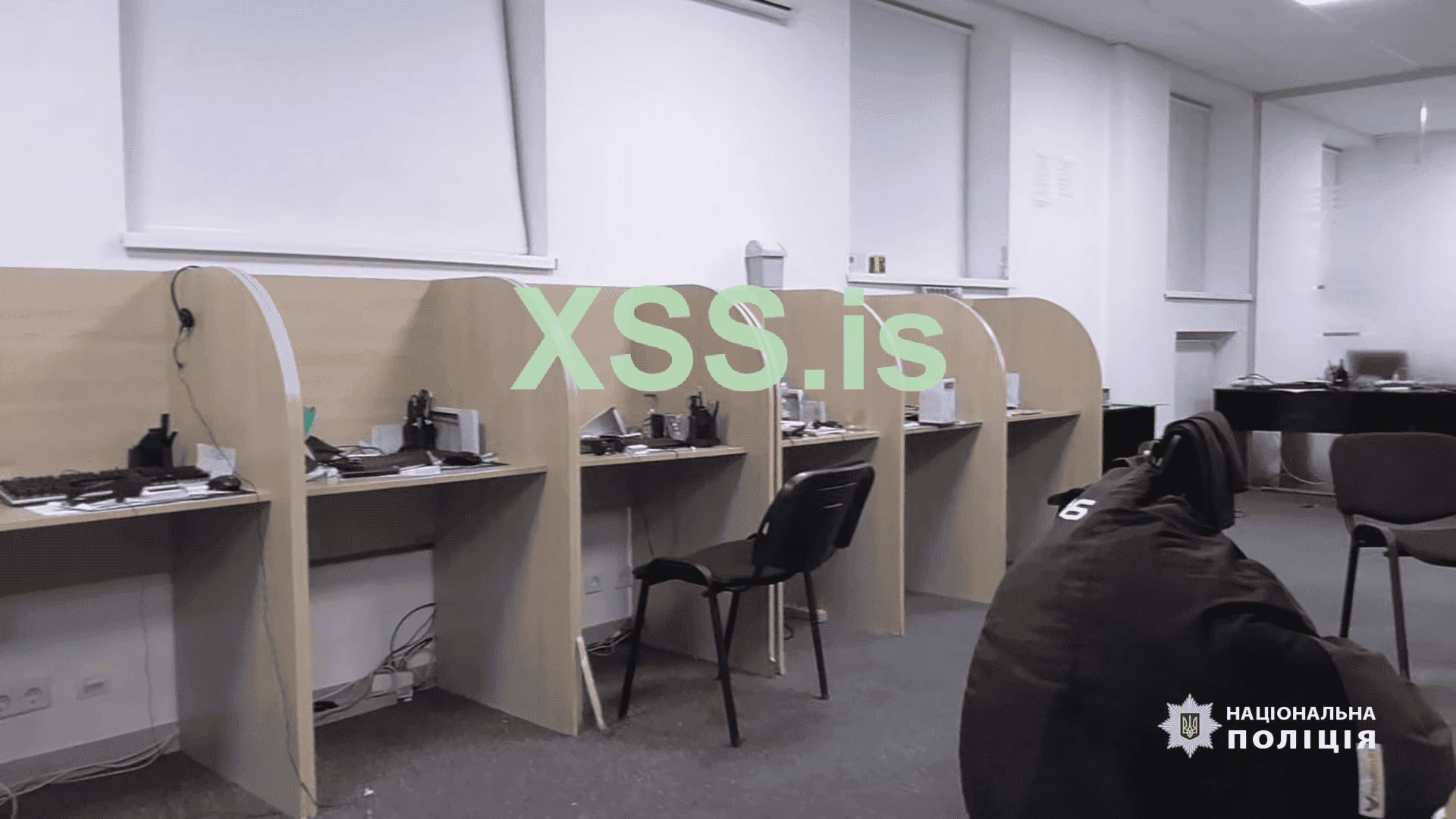

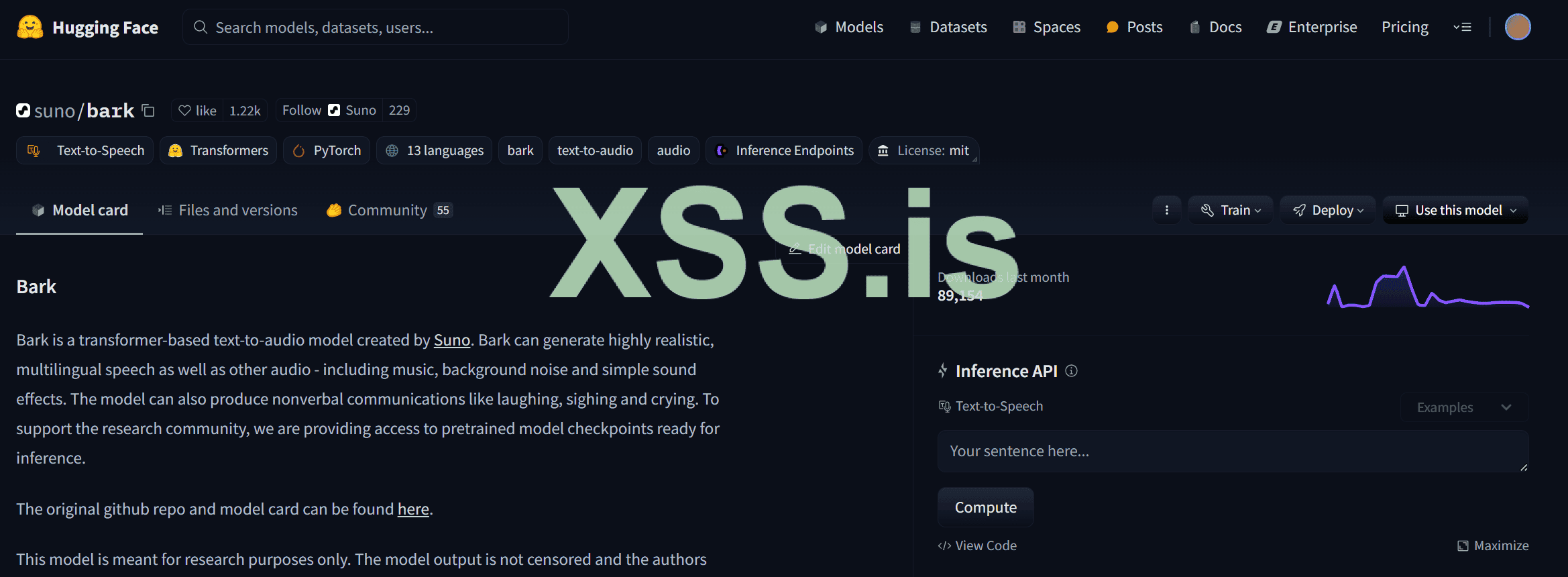

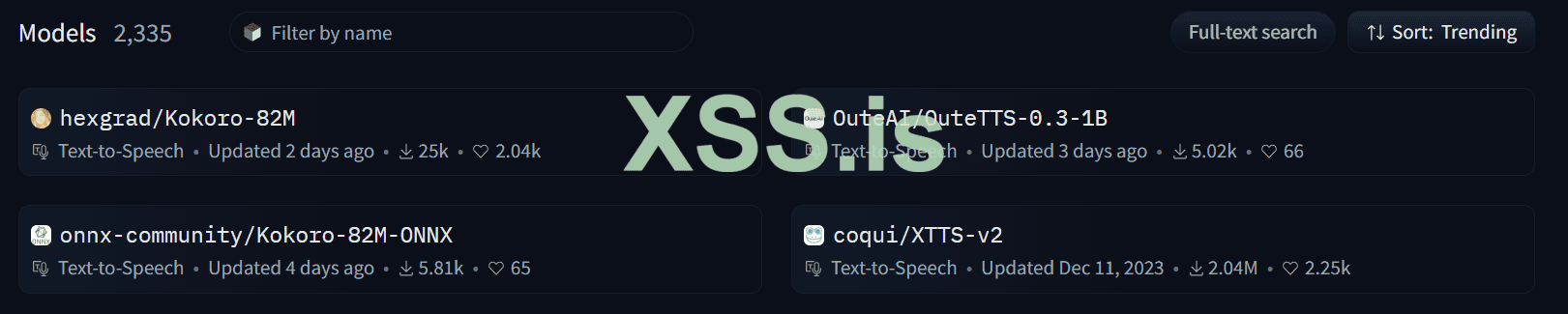

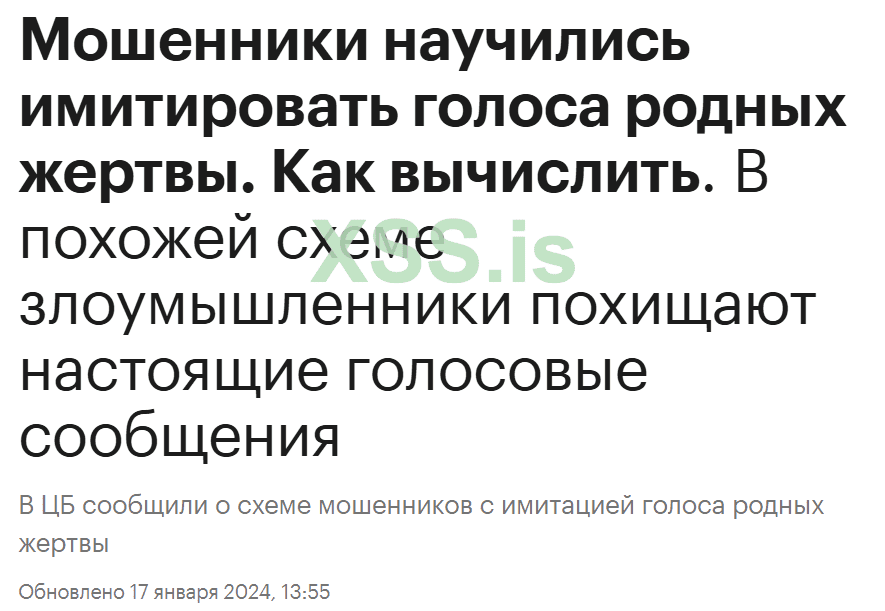

И вот, чтобы ты понимал масштабы всего этого дерьма, зайди на Hugging Face и посмотри, сколько там моделей для Text-to-Speech. Их там 2335. Две тысячи триста тридцать пять! И это только на одном ресурсе. А теперь представь, сколько ещё таких моделей валяется на GitHub, в Telegram-каналах или на форумах. У таких "офисов" всегда есть деньги на то, что может улучшить их заработок. Они не пожалеют ни копейки на разработчиков, которые сделают им нужный результат. Это может быть даже чертова машина для убийств, такая как live Text-Text(translate)-to-Speech, которая работает в реальном времени и потоке, такое еще конечно я не видел в паблике, или быть может я просто слеп и всё, но представь: звонок в любую страну, на любой язык. Мошеннику даже не нужно знать, как говорить по-английски, по-испански или по-китайски. ИИ сделает всё за него. Голос, интонация, акцент — всё будет звучать так, как нужно. И неважно, бабушка это в России, дедушка в Германии или мать в Японии. Вектор атаки теперь не зависит от того, сколько языков знает прозвонщик. И вот эти уёбки уже вовсю используют такие технологии. Они не просто клонируют голоса — они делают это в реальном времени, подстраиваясь под ситуацию. "Сын попал в аварию? Вот его голос, вот его паника, вот его слёзы". И всё это — на лету, без задержек, без артефактов. Новости о клонировании голосов пошли еще с января 2024 года, а тема использования ИИ в blackhat достаточно обширна, да и мало кто её раскрывает, по крайне мере здесь, на форуме, а это как по мне что-то из разряда абсолютной свободы мысли.

А теперь давайте взглянем на еще одну возможный вектор атак, это конечно же криптостримы со значимыми людьми. Представь: ты заходишь на стрим, а там сидит какой-то "гуру крипты" или даже известная личность. Он рассказывает, как легко разбогатеть, и предлагает тебе "уникальную возможность": отправь 100, а он тебе вернёт 200. Вы можете сказать, что это бред, и так далее, таких тупых людей не бывает, к сожалению, или к счастью их кучи, тысячи и миллионы.

А это былo давным давно, всплеск такого скама пришелся на 2021 год, когда еще сфера ИИ была плохо развита, и зачастую там просто включался какой-то подкаст с популярным человеком, и висели баннеры с ссылками на сайт, и какое-нибудь доказательство, что "я - это реально я", как на скриншоте выше, это якобы его пост. Давайте немного подразмыслим, а что сейчас? Сейчас, конечно, все это подумерло, но люди все так же работают и наверняка, что-то еще достают, а иначе зачем работать в этой сфере, если не прибыльно?

Окей, наверное я уже задрал вас этой теорией и векторов возможных атак, пора уже плясать к тому, а как делать, что собрать, что использовать?

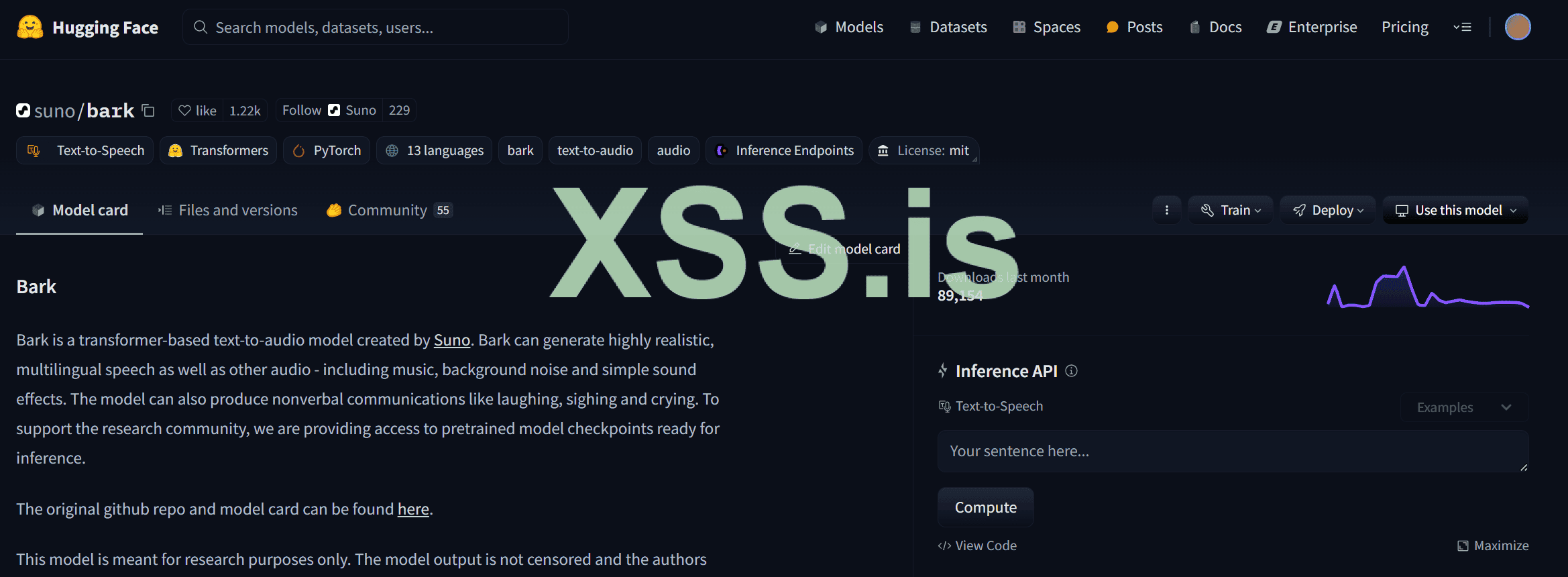

Мы тут собрались, чтобы поставить какую-то text-to-speech модель, и кто-то (возможно, я) посоветовал использовать Bark. Bark — это модель, которая якобы умеет генерировать речь, звучащую как человек. Но, конечно, это не значит, что она будет работать у вас. Может, это просто очередная игрушка для гиков с топовыми видеокартами. Но ладно, допустим, мы решили попробовать. Конечно, первое, что мы делаем, — идем на Hugging Face. Потому что где же еще искать модели, если не там? Мы вбиваем в поиск "Bark" и видим кучу репозиториев. Кто-то уже попробовал, кто-то даже выложил примеры. Но мы-то знаем, что примеры — это одно, а реальность — совсем другое. Мы готовы к тому, что ничего не заработает с первого раза, но мы же не ищем легких путей, верно?

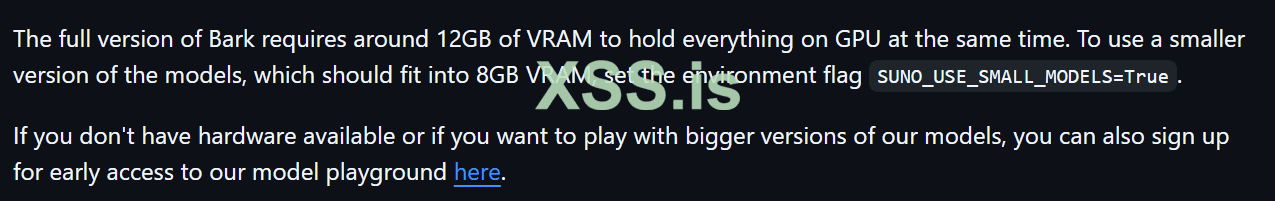

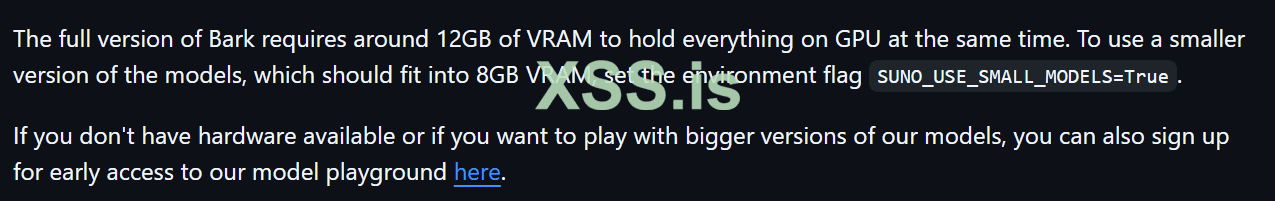

Железо? А оно у нас есть? Теперь самое веселое. Bark — это не та штука, которая будет работать на вашем ноутбуке, купленном в 2015 году. Минимальные требования bark если мы хотим использовать их полноценные модели, то это 12GB VRAM, но можно использовать и укороченные, тогда нужно всего лишь 8GB VRAM, но вопрос, как это отразится на результате, кто этот такой вообще ваш VRAM? Я думаю каждый знает, что такое RAM и попробую объяснить на сравнении с ним. Если обычная оперативная память — это как ваш рабочий стол, где вы раскладываете все нужные документы, то VRAM — это как специальный стол для вашего художника (видеокарты), где он хранит все свои кисти, краски и холсты. И если у вашего художника мало кистей, красок и всяких других инструментов, то нарисовать или сделать что-то толковое, он наврятле сможет, получится какое нибудь дерьмо, уж простите меня за мой французский. Но все же нам еще предлагают воспользоваться их веб-мордой лишь за регистрацию, но я подозреваю, что там будет проверка того, что мы хотим перевести в речь, и нас это конечно не очень сильно интересует.

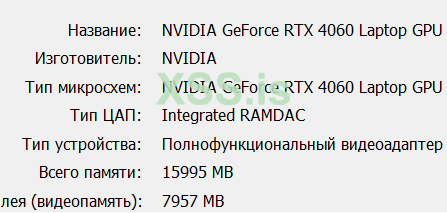

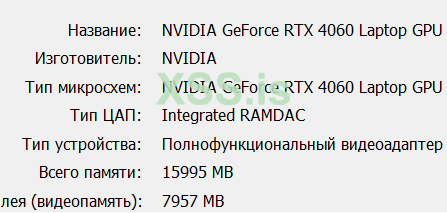

Теперь пора к установке, установить это все можно по инструкции на гитхабе в репозитории Bark'a, всегда смотрите в основном, что происходит там, а не на hugginface, ведь он зачастую является как выставочным стендом, вот мол, посмотрите, узнайте, а дальше все равно это дело перетекает на гитхаб. Я не хочу переписывать то как это устанавливать, к чему этот реврайт будет непонятно абсолютно, но расскажу немного на чем я накатывал все это дело и какие вообще железяки у меня стоят, по операционке это Ubuntu 22.04 - как по мне практически универсальная вещь абсолютно, пойдет и накатит все, что угодно, все что захочется. По железкам вот так вот, показывать процессор и сколько у меня простой оперативки, я думаю не особо имеет смысл, ведь упор идет на GPU-генерацию.

То есть 16gb VRAM, чего вполне хватит, чтоб использовать полноценную модель барка. И совсем забыл, вот здесь. Я пока еще немного позагоняю вас теорией, и возможными идеями.

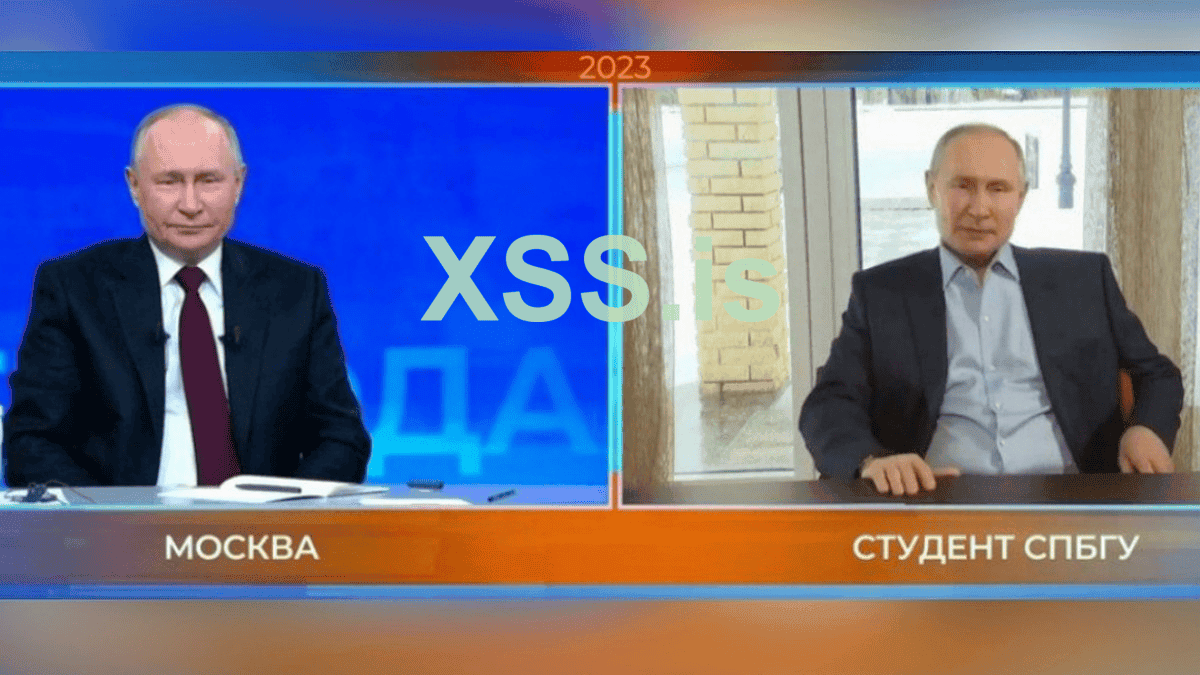

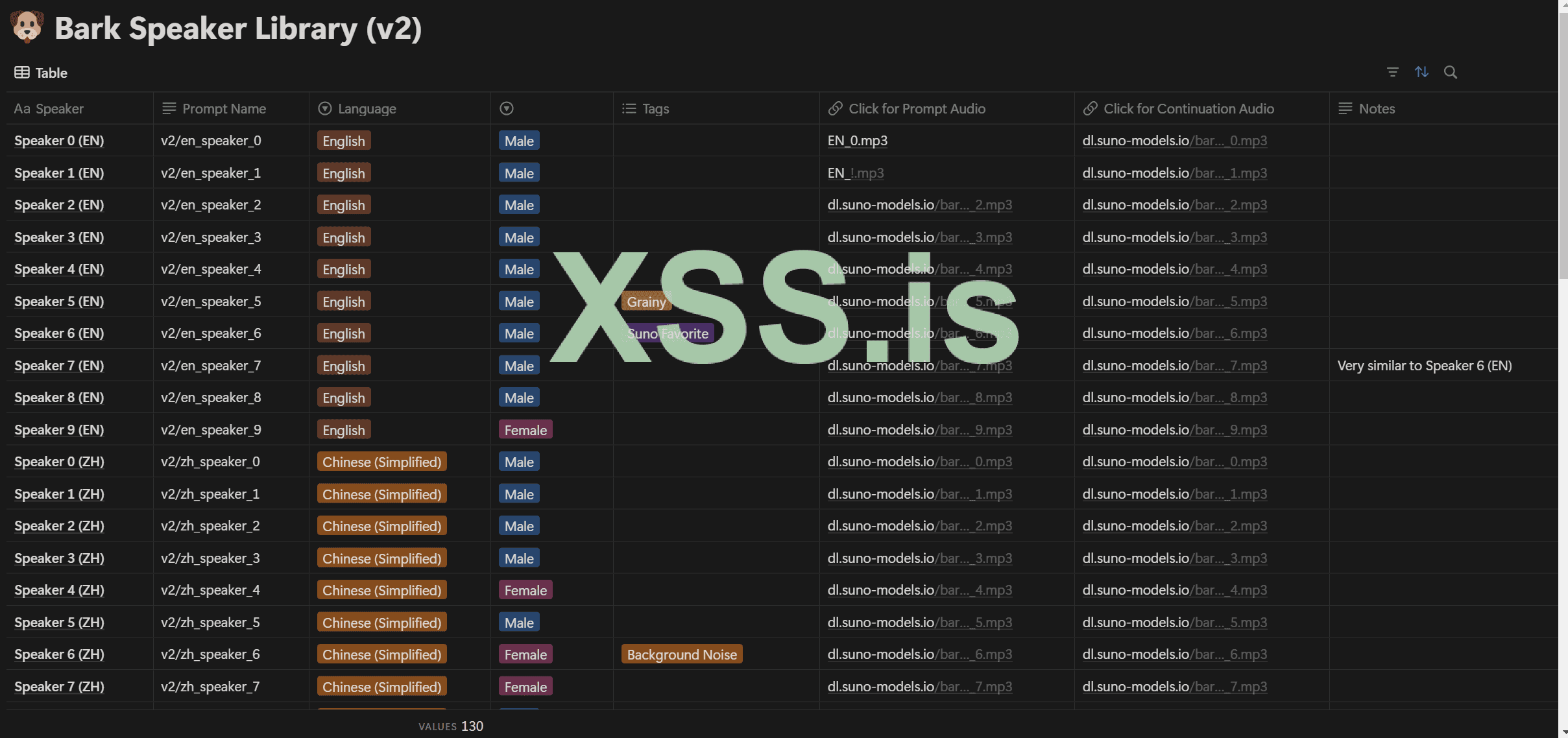

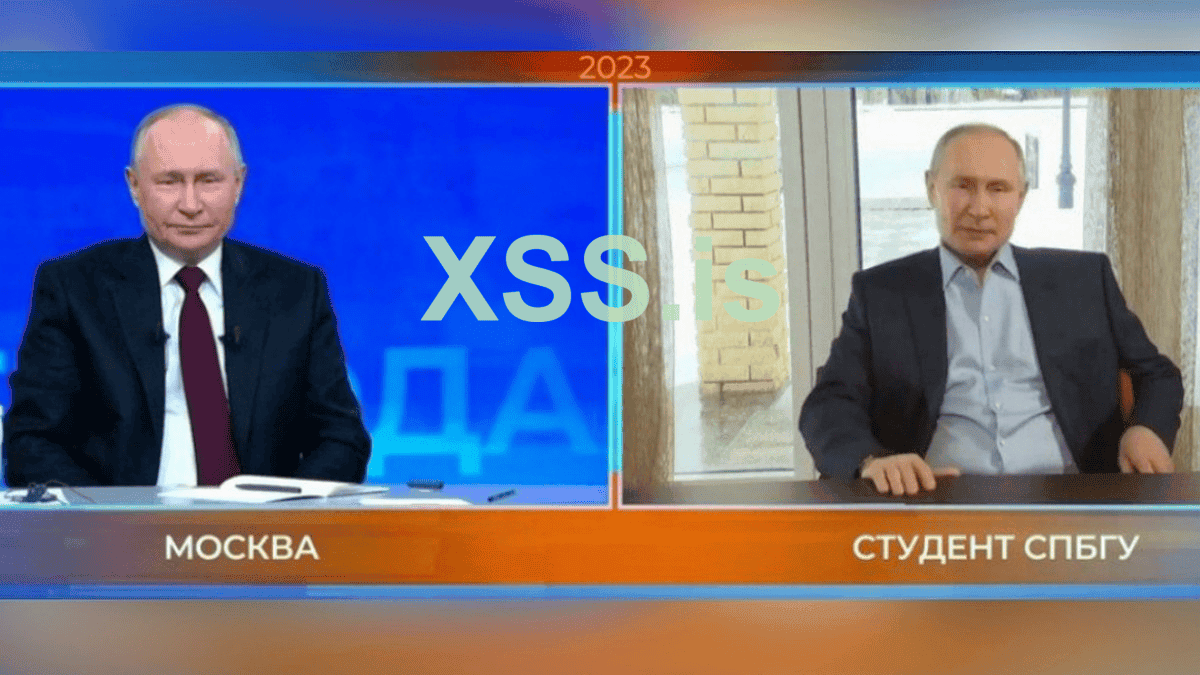

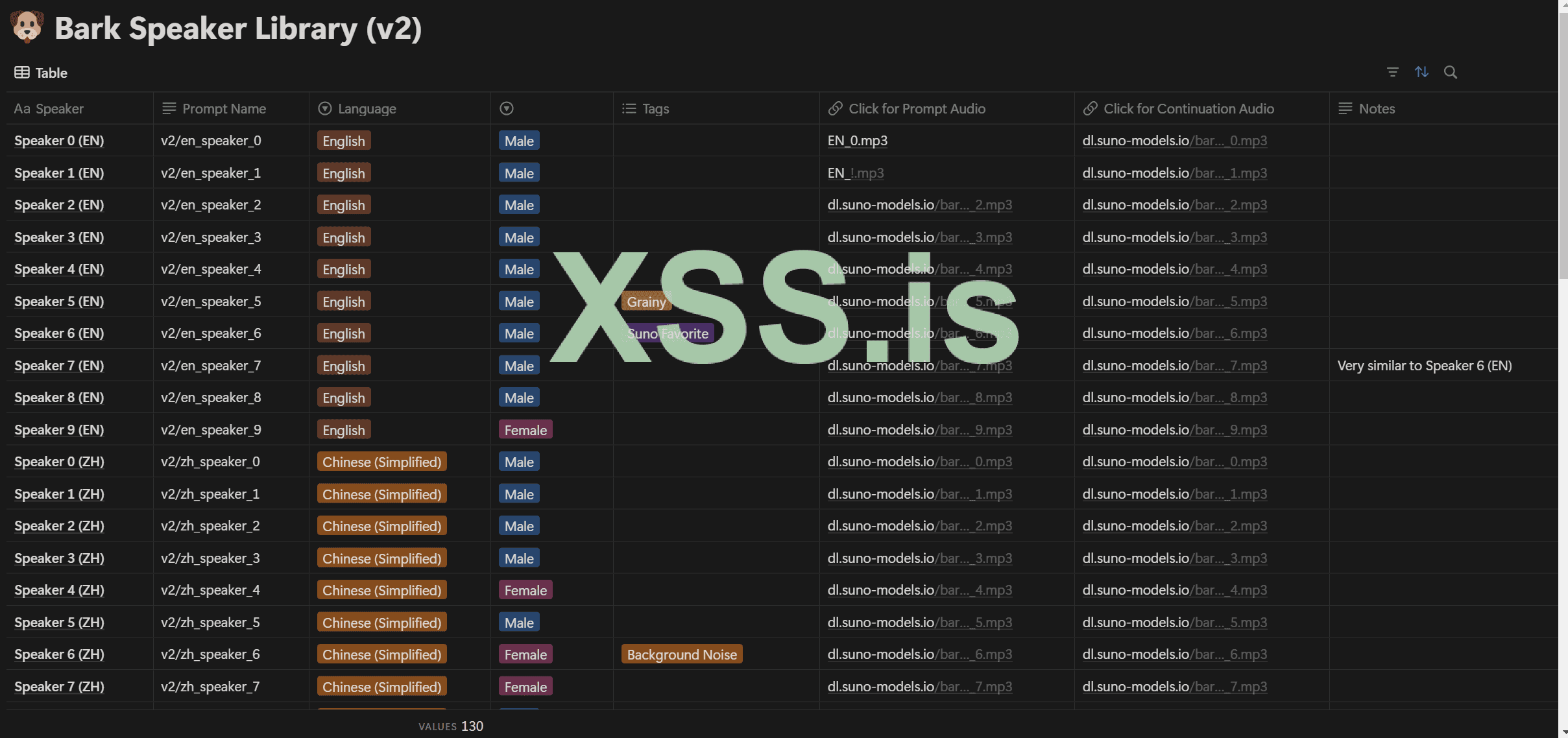

В барке есть поддержка 13 языков, в каждой минимум по 5 моделей голосов, какие-то лучше, какие-то хуже. Это как по мне лишь вкусы и предпочтения, и каждый выбирает сам, что хочет. Есть как женские голоса так и мужские, языки есть даже экзотические, по крайне мере, китайский для меня является таковым. Вообще, пока вы поставили, это все качаться, а оно будет качаться долго, и надо иметь нормальное соединение и так же минимум 15 гигов свободных, я бы сказал, ибо модельки будут закачиваться к вам на сервер/компьютер. Я вспомнил один замечательный прикол из 2023 года, когда Путину задавали вопрос его же двойником, достаточно смешно и абсурдно. Но вот было это так давно, произошло уже куча прорывов, новых технологий. И создается идея, что так можно создавать инфоповоды, в следствии креативы. Люди, которые занимаются развитием телеграм-каналов, зачастую новостных, либо еще что-то, то они ищут эти креативы с беспощадной силой, ведь надо, чтоб заходили подписчики, и чтоб заходили дешево. Но конечно, создавая такие инфоповоды, вы получите свой траффик, людей и так далее, но это все же грязно, я не думаю, что среди тех, кто читает это сидят люди белые и пушистые. Но и дело траффика это тоже тонкое и достаточно аморальное занятие, как бы не хотелось сюда впихивать эту мораль, но во время теракта в Крокусе, делались миллионные заливы, реклама скупалась и продавалась просто постоянно. Да, владельцы этих каналов молодцы, но с другой стороны если подумать, сколько же было заработано на этих человеческих смертях? Всё.. Пора заканчивать с этой моралью, она нас точно ни к чему хорошему не приведет, если я утону в ней.

Так вот, модельки в барке, как и говорил ранее их куча. Потыкаться, послушать их можно даже ничего не генерируя, ссылочка вот здесь.

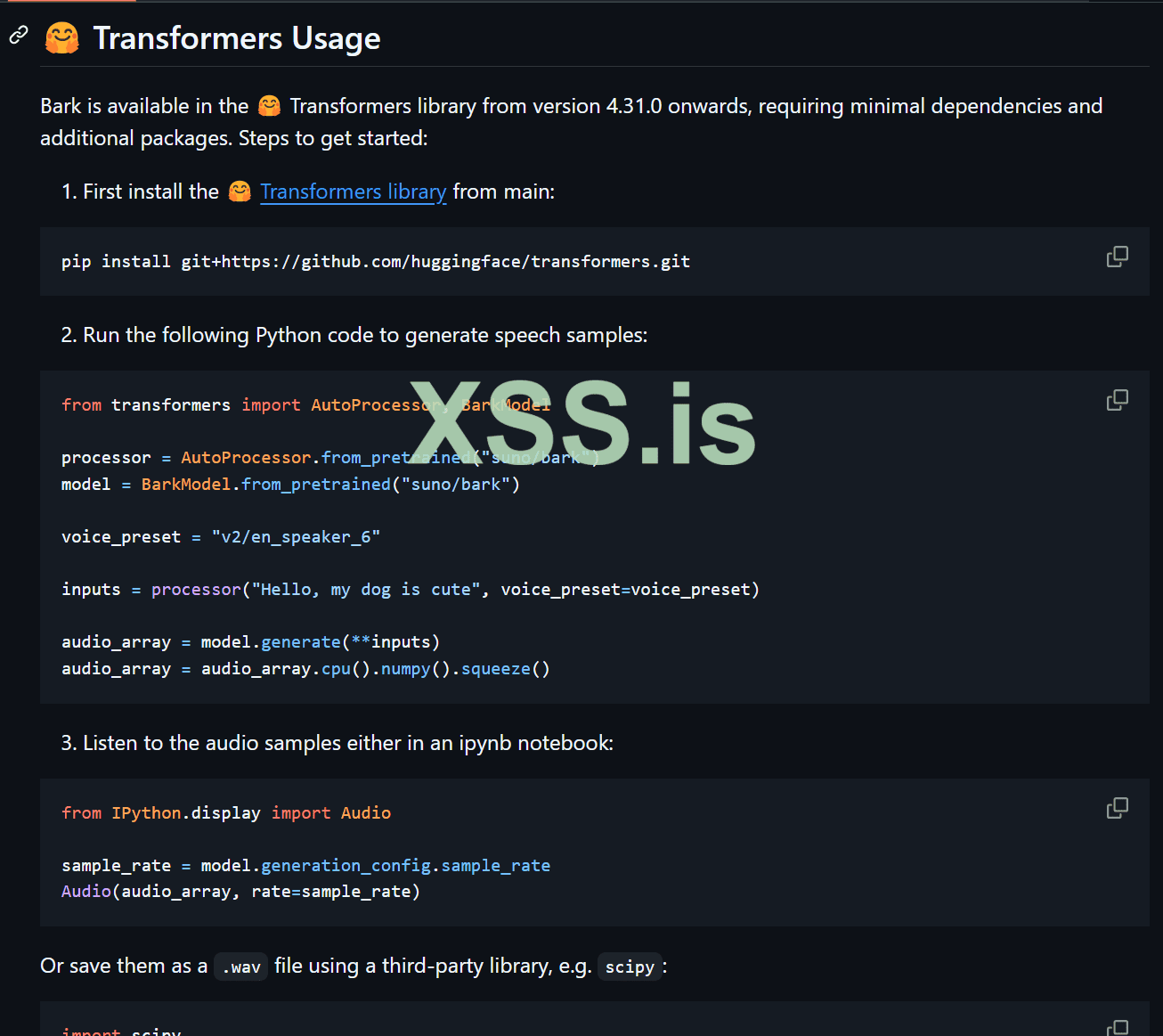

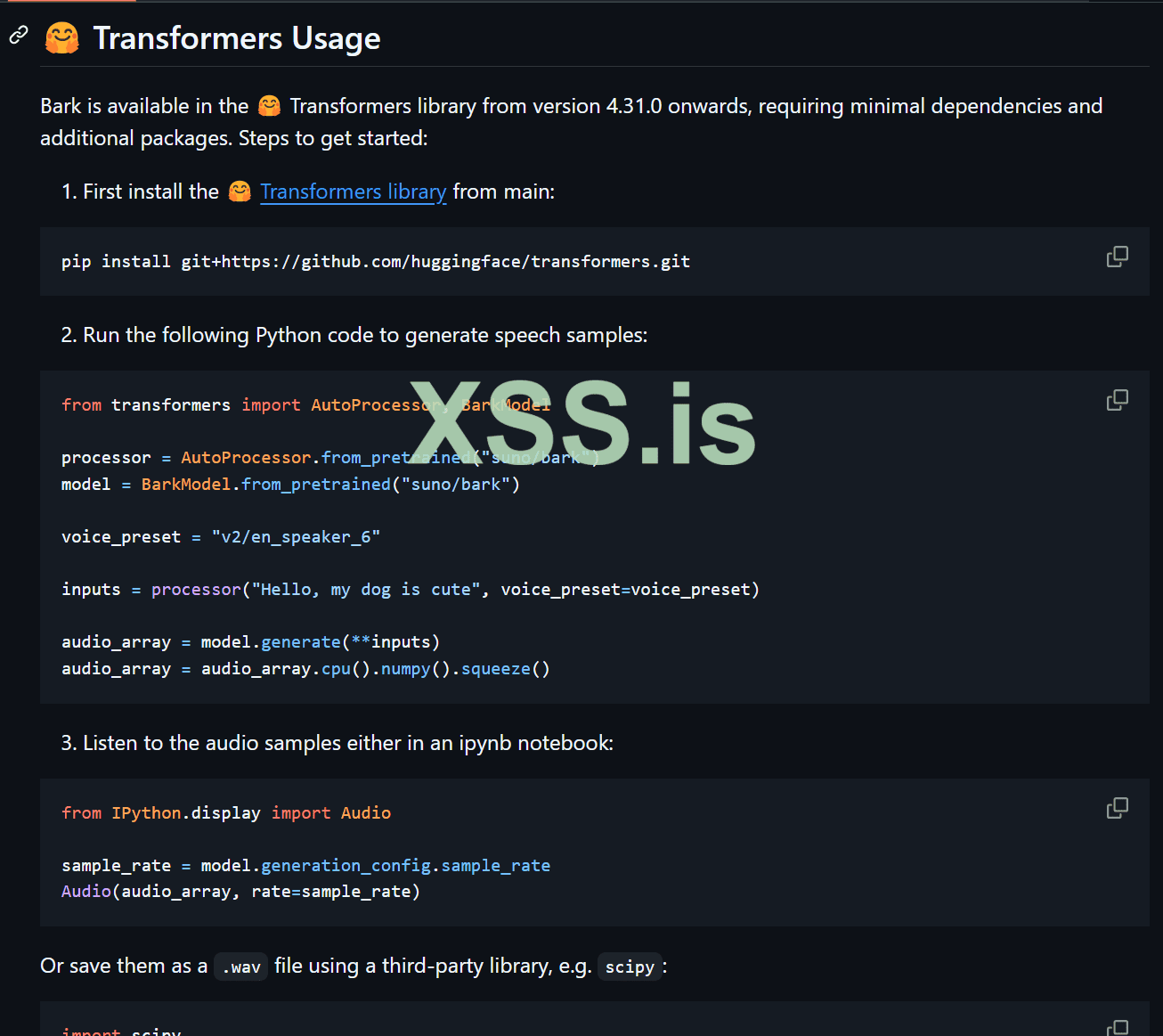

Надеюсь, что у вас уже все установилось и теперь мы можем переходить к делу. Я буду использовать в качестве примера генерацию на английском и это будет спикер номер шесть, он мне больше всего понравился, и не мне одному, ведь является "фаворитом Suno". Сразу к коду, сразу в бойню, тут нет ничего страшного, бояться уж точно не надо.

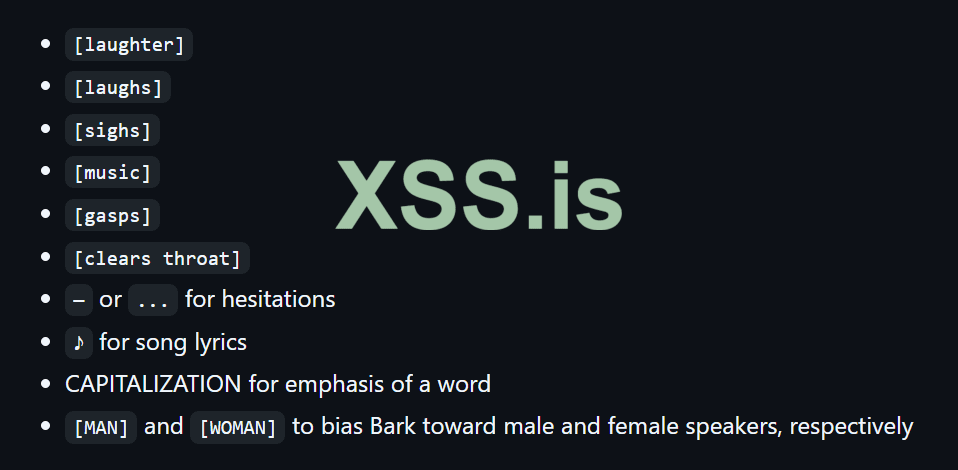

В voice_preset мы выбираем модельку, а в inputs мы храним наш промпт, под оберткой processor. Генерация в моем случае заняла около 1.5 минуты, не мало, согласен, но и запускалось то это все на не очень крутой железяке. Хочется узнать уже, что там bark нам нагенерил. И вот прикладываю результат вот сюда, по каким-то непонятным причинам vimeo решил, что моя запись длится столько же сколько и потратилось времени на генерацию. Звучит достаточно чисто, я бы сам поверил, что это говорит человек, но в очень дерьмовый микрофон, звук словно он идет по телефону. Но причин, чтоб сказать это ИИ у меня точно нет.

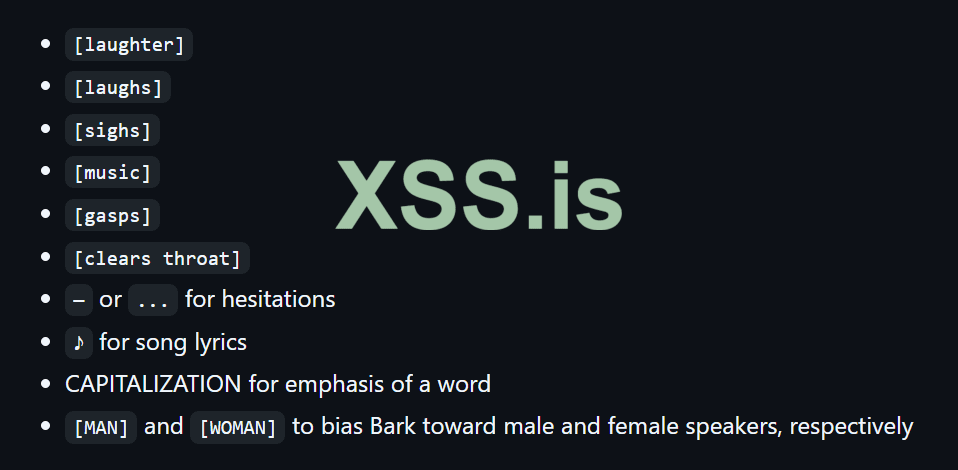

Еще забыл подметить тот факт, что в bark есть поддержка смеха, пауз, акцента на определенных словах и т.д.. Это тоже очень сильно радует, ведь это придает реальности в разговоре.

Ладненько, ладненько, просто с генерацией войсов мы разобрались, их можно использовать в рамках любых прозвонов и любого мошенничества, связанного как либо с социальной инженерией. Но надо подключать большое количество видеокарт, чтоб генерация шла на лету, и все это было быстро.

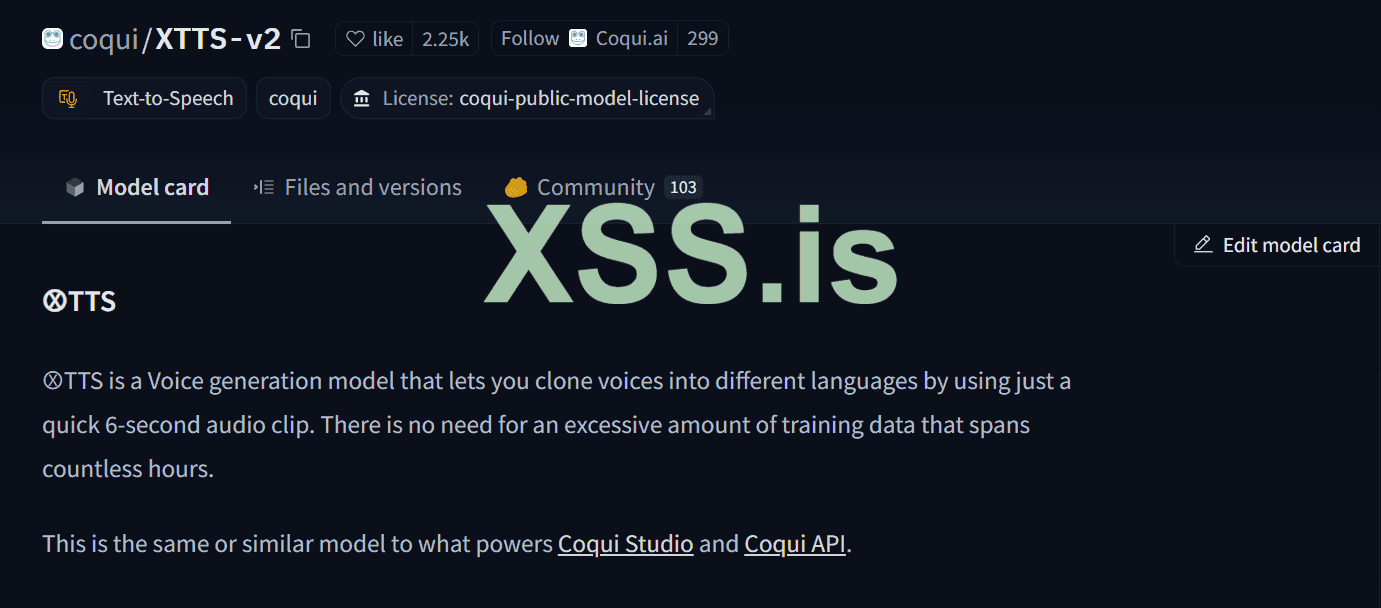

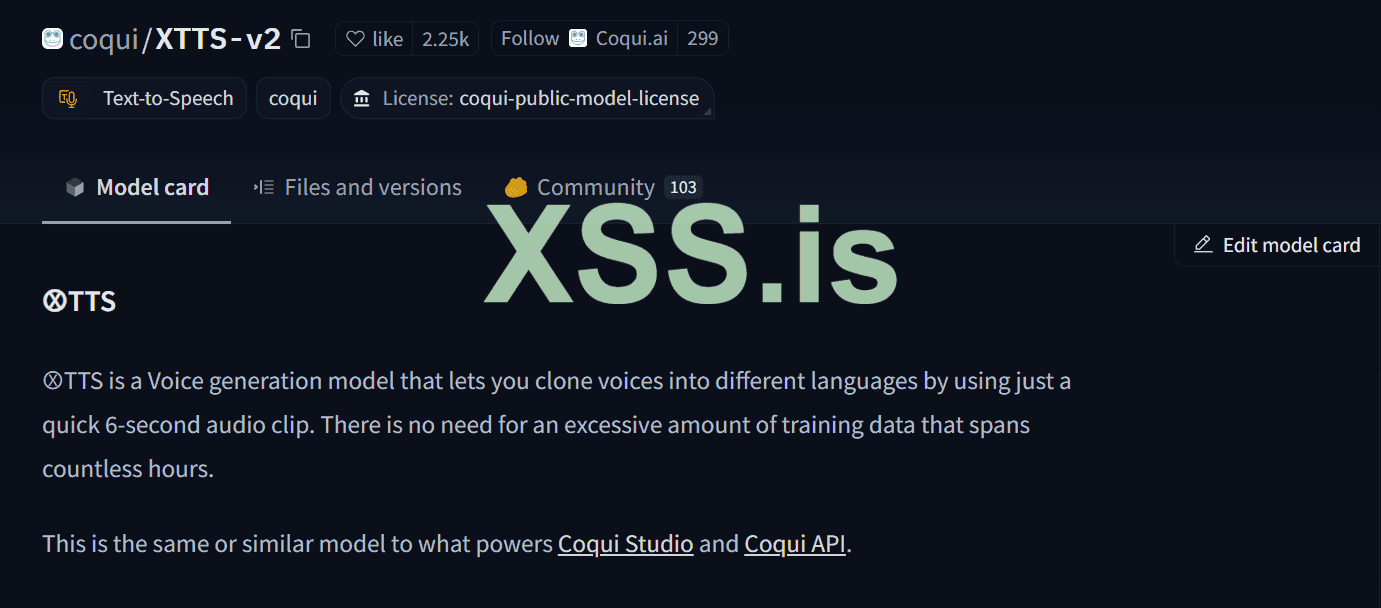

В данном случае переход реально на другой уровень, меня не очень сильно удивили результаты при клонировании, используя так сказать "универсальные" модельки. Но на то они и являются универсальными, а чтоб добиться наилучшего результата надо плясать чисто под один войс, и обучать её только на этом. Использовать в этот раз мы будем XTTS-v2, одна из популярных для клонирования голосов без особых проблем, достаточно 6 секундной записи, чтоб склонировать, но конечно это будет не самое лучшее клонирование как говорил.

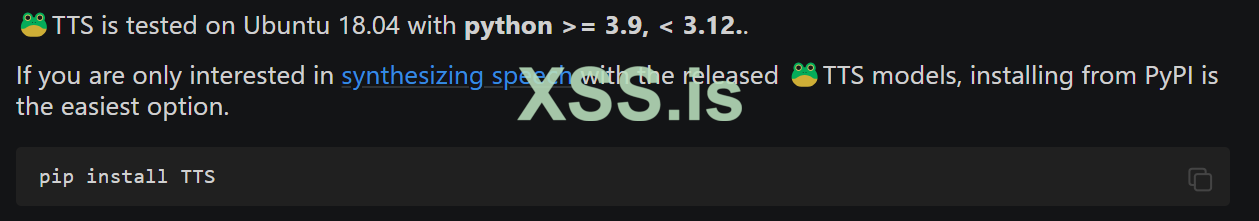

С её доками и установкой можно ознакомиться вот здесь - https://docs.coqui.ai/en/latest/ . Установка тут намного легче, если мы хотим только клонировать, то достаточно будет лишь.

В качестве примера возьмем голос Трампа, попробуем склонировать его голосок, и сгенерируем какой нибудь инфоповод на фоне его недавней монетки TRUMP, которая абсолютно взорвала весь интернет. Код под генерацию еще проще чем в предыдущий раз.

Указываем язык, путь к тому где лежит у нас голос, который надо клонировать, и путь куда сохранять и как сохранять это все дело. Результат будет пониже.

Не могу сказать, что вау как круто, и так далее, но стоит понимать, что это универсальная модель, а если обучать индвидуально под один голосок, и обучать хорошо, то в результате вы получите точно красоту. Можно посмотреть еще и другие модели для клонирования, есть так же много и веб-сервисов, которые предлагают такие варианты. Но там скорее всего вы столкнетесь с ограничениями по вводимому тексту, либо оплати то, купи пятое десятое и так далее. Пора переходить к сладкому на вишенке как по мне, это генерация видео.

Теперь мы вовсе отойдем от генерации через модельки и так скажем перейдем в режим ZeroCode как это сейчас модно. В основном модельки, которые я смотрел на HuggingFace требуют от 64gb VRAM для нормальной работы, понятное дело, что у большинства как и у меня таких ресурсов нет, но я все же расскажу про эту модельку, но только вкратце и то какую красоту она делает. Суть генерации там заключается в text-to-video, эту машину для убийств сделали китайцы, китайцы впринципе для меня очень круто делают любую свою работу, они уж без остановки работают и каких-то задних мыслей, что пора остановиться и так далее. А именно HunyuanVideo

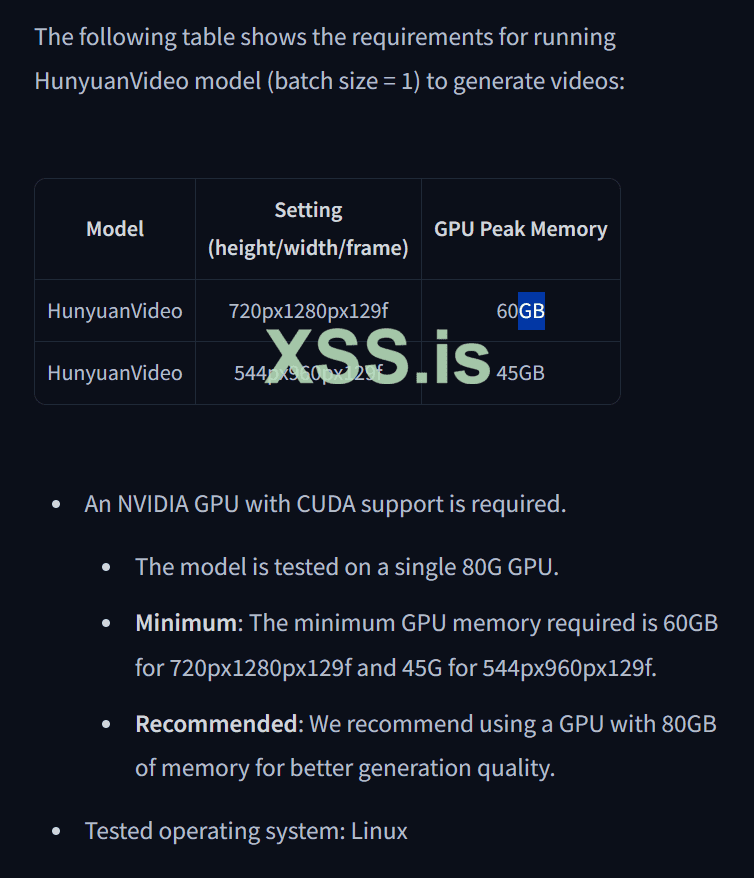

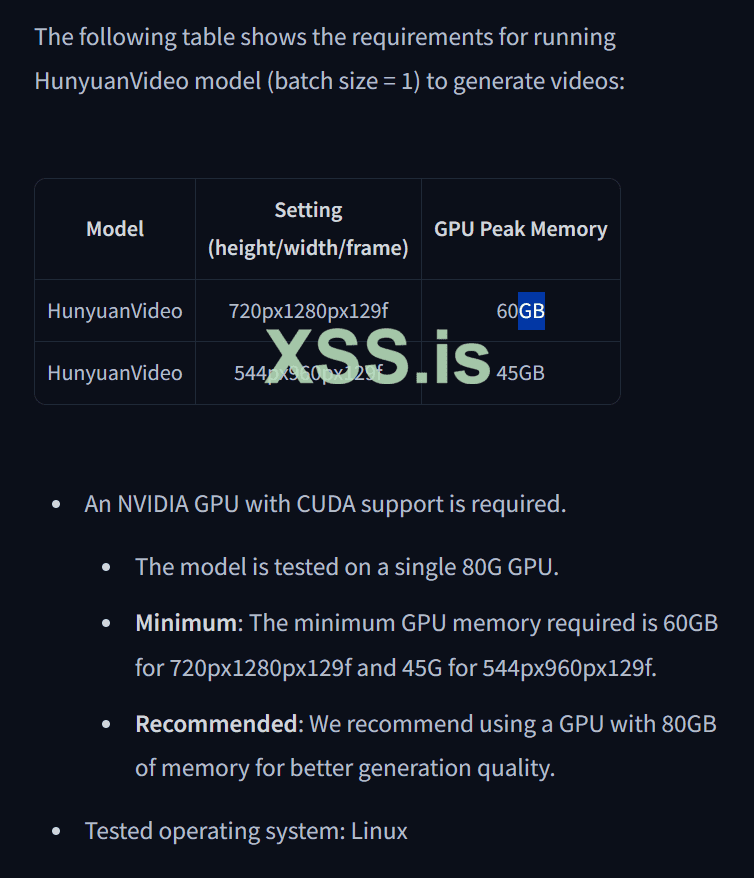

Эта модель как по мне, просто могущественна и топ-1 в этом деле. Но и требования к запуску у неё конские.

Минимум 60GB VRAM, да, дохренища, но и результаты она выдает соответствующие.

Всё это видео, это сплошная генерация, целиком и полностью. Я бы поверил практически каждому отрывку, кроме пингвина, в особенности, у него там лапа чучуть поплыла, но все равно, это дикий прорыв. И с помощью таких инструментов можно генерировать кучу креативов, а если это все связать еще и с генерацией войса, то на выходе мы имеем бесплатный креатив, за исключением ресурсов, потраченных на это. Но всё, хватит восторгаться тем, до чего коснуться нельзя, это немного лишнее, а то еще фантазия сама за себя сработает в голове.

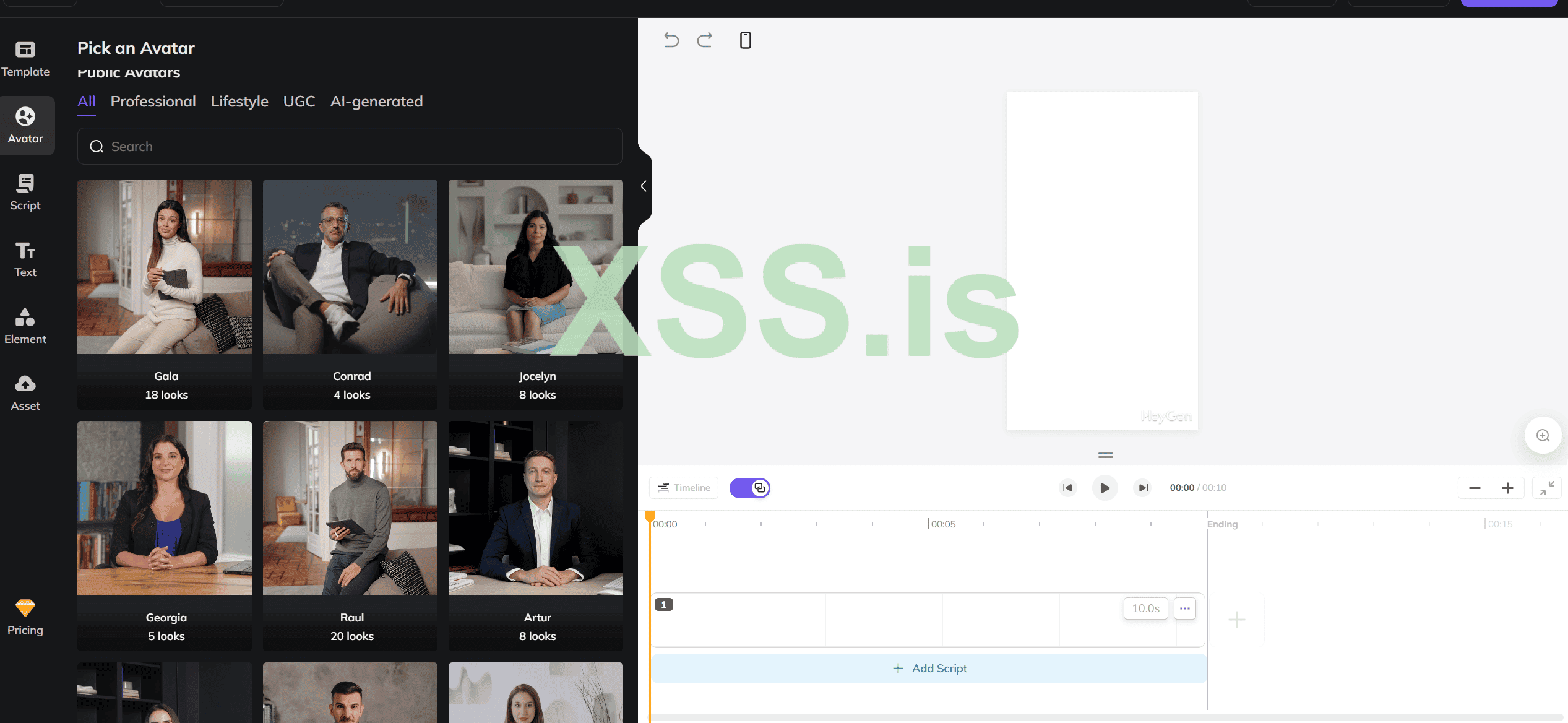

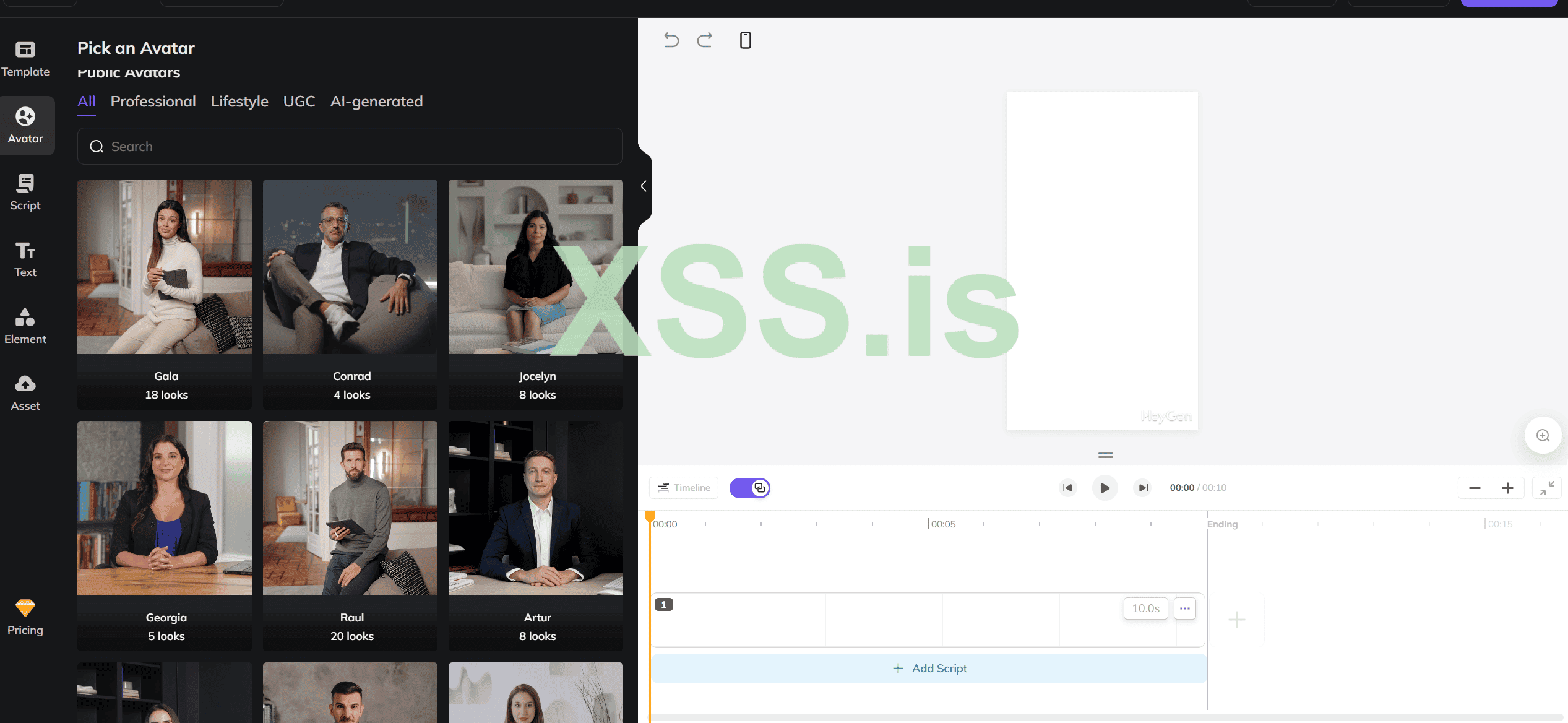

Heygen - это то чем мы будем пользоваться, видео которое было в самом начале статьи сгенерировано при помощи него. Изначально он дает 3 бесплатных видео на генерацию, но это легко обходится просто регистрацией нового аккаунта, при этом можно использовать временные почты, особо он не требователен. Но достаточно хорошо и сильно следит за тем, что вы хотите говорить. Он может как и полностью сгенерировать за вас и видео, и аудио, так и все остальное. Так же можно использовать свои аватары, но там есть проверка, в которой вам надо будет доказать, что ВЫ это ВЫ, и так же прочитать на аудио+видео запись речь которую они скажут. Для попыток обойти это можно пробовать всяческие уродства такие как виртуальная камерa OBS, и так же чтоб текст, который они требуют, можете просто воспользоваться инструментами, про которые я рассказывал чуть ранее. Heygen в этом плане дает абсолютную свободу выбора аватаров, то есть людей которые будут говорить, и так же подводит все под движения губ, то есть делает это практически ИДЕАЛЬНО. Этот инструмент просто отлично подойдет под то, чтоб завести лохов на ваш продукт, который надо скачать, установить или еще что-то. Если вы думаете, что я все еще несу какую-то хрень. То посмотрите на этого мужичка, который несет вам полную пургу про какой-то там Itoilet3000, который будет анализировать биологические выбросы человека. Это тоже все Heygen, эта штука просто делает ужасные вещи, которая дает огромное развитие не только в белых целях, но и в черных.

Разрыв шаблонов, теперь вообще не стоит задумываться о креативах для ваших офферов, это все может спокойно делать Heygen, а вам ничего даже делать то и не придется, кроме того как тыкнуть пару кнопок, ввести текст, который он должен будет говорить и всё. Ладно, перейдем к интерфейсу и как вообще этим пользоваться. Регистрируемся сначала - здесь. После чего как и говорил ранее будет доступно 3 видео, но это не проблема. Переходим в главную панельку, и нам нужна вот эта заветная кнопочка.

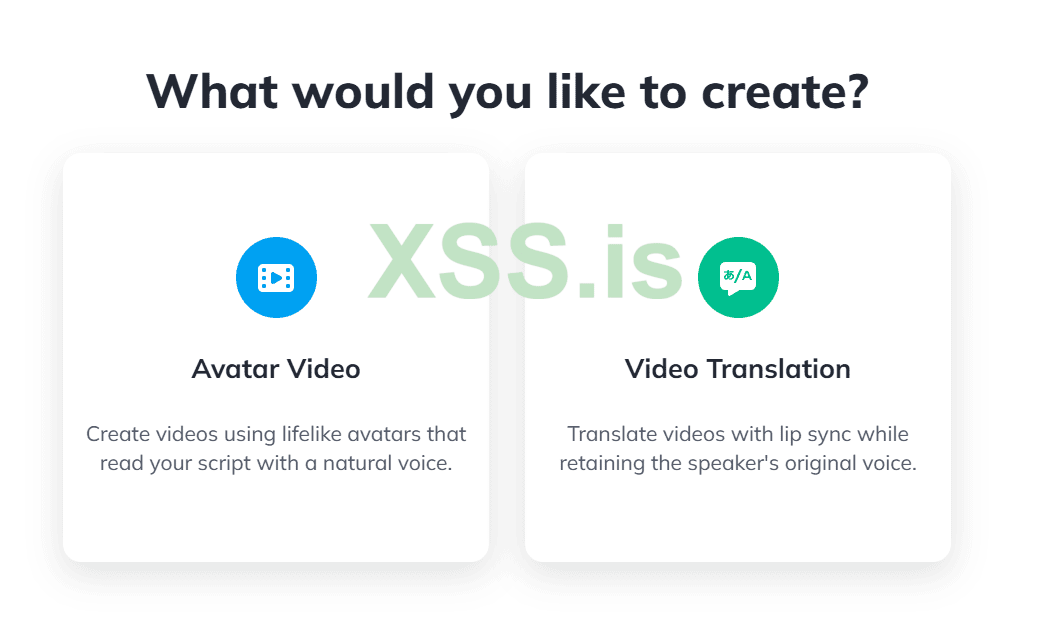

Сreate Video - мы кликаем по ней, а теперь уже и начинаются вопросы, для начала надо выбрать что мы делаем? Просто переводим видео на нужный язык или генерируем своё. Нас не особо интересует перевод, нам нужна генерация.

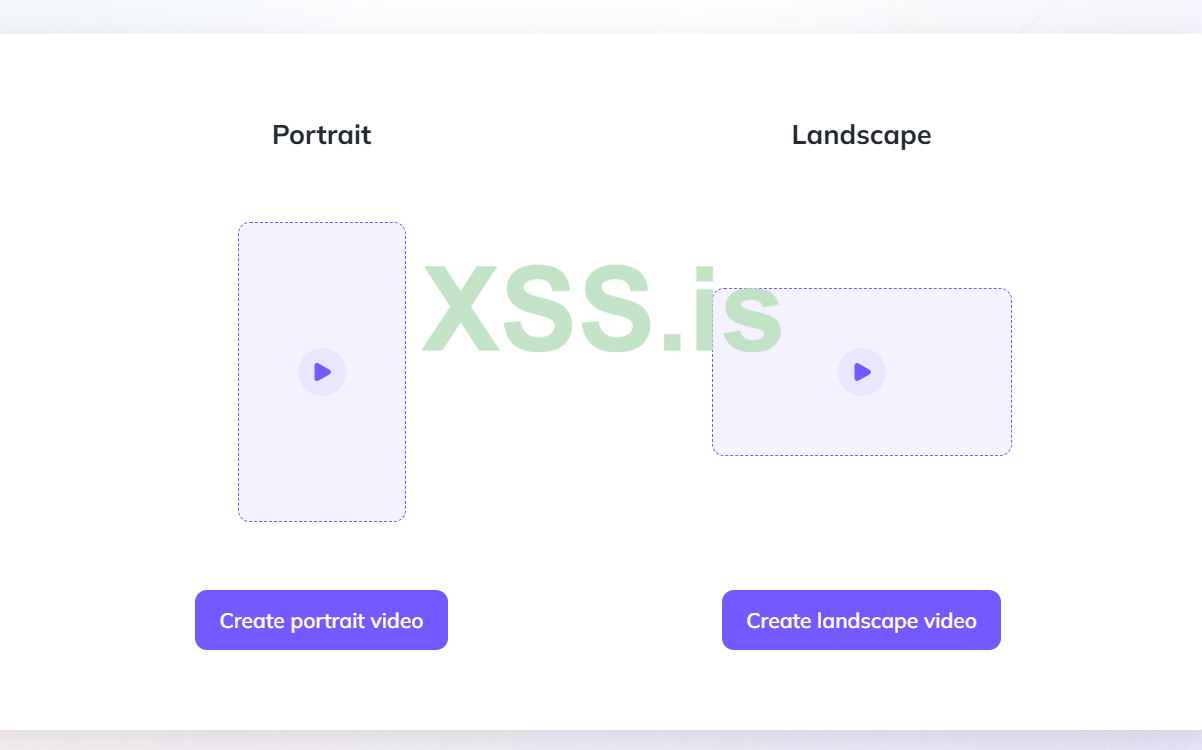

Heygen умеет генерировать как вериткальные, так и горизонтальные. Тут уже дело вкуса и выбора, смотря что вам надо, но скажу так, он делает все идеально, но может это моё субъективное мнение.

Он умеет так же генерировать видео самостоятельно, лишь по промпту который вы ему дадите. Он сам подберет аватар, сам сделает все таймлайны, сделает все красиво и четко САМ. Теперь напрягаться при создании офферов и креативов вообще не нужно как раньше.

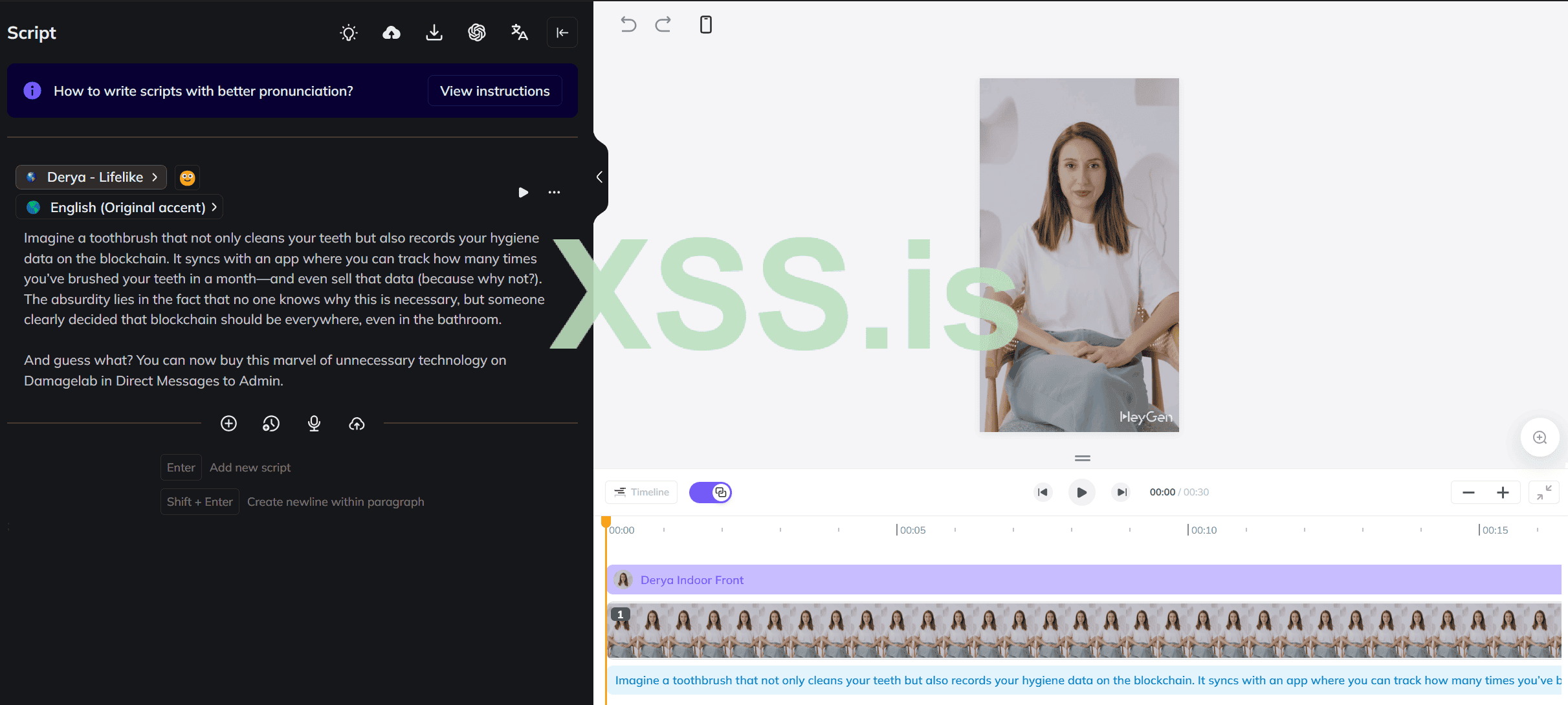

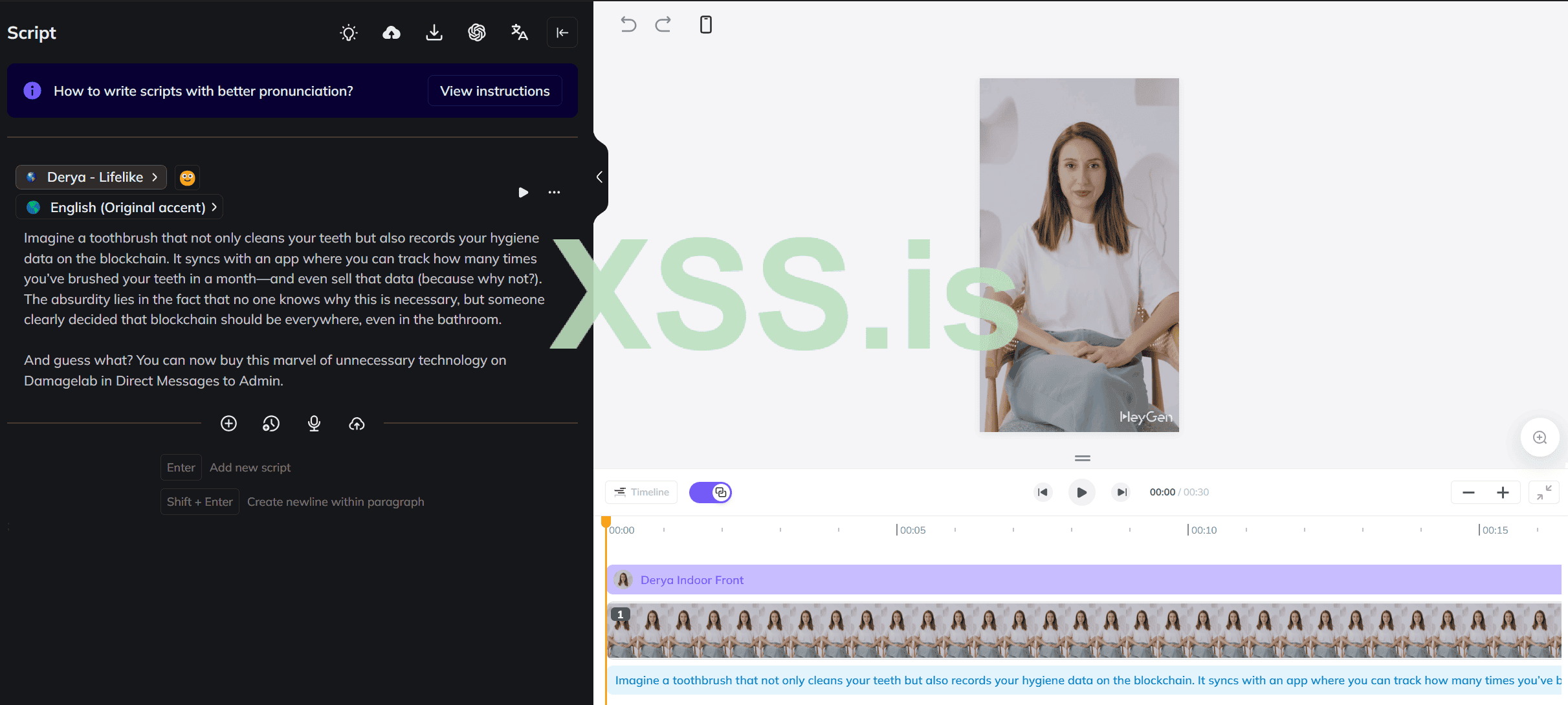

Cейчас это выглядит так, что нам нужно выбрать персону которая будет говорить, их тут достаточно. Но можно и загрузить свои аватары, но с верифом, про который рассказывал в начале. Во вкладке Script мы выставляем текст который собирается говорить наш аватар, и так скажем рекламировать. Да, простит меня, админ форума, если к нему прилетят в личку сообщения о том где купить зубную щетку с блокчейном, ибо демонстрации ради сделал вот такую речь этой женщине:

После чего кликаем Submit и ожидаем пока сгенерируется наше видео. Это может занимать на самом деле очень разное время, бывало как-то и по полтора часа у меня, бывало и за пару минут. Это спорный вопрос, и скорее всего просто зависит от нагрузки на сервис.

Мда, вот мы и подошли к концу. Тема ИИ очень сильно недооцененна, по крайне мере в рамках форума, я не особо видел статей, которые можно почитать и сидеть с открытым ртом к концу. И впринципе, мне кажется, я даже немного некий первопроходец в тематике "AI в blackhat" на форуме, конечно, а не в целом. Что мы вообще научились, что мы вообще сделали? Да, дохрена всего. Бесплатно генерировать креативы с нулевыми вложениями средств, чтоб поднять доверие со стороны простых юзеров, повысить конверсию, это можно использовать как первичную воронку на свой малварь, тут все ограничивается лишь пределом ваших фантазий, делайте, пробуйте. Разобрались с генерацией text-to-speech и как она может использоваться в мошеннических аферах, про клонирование голосов тоже немного поговорили, но не думаю, что там я прям вау как много чего, нового и интересного рассказал. Я надеюсь, что статья вам была полезной, лишний раз извинюсь за свою циничность и грубость в начале. Вот и всё, сказочке подошел конец. Ах, да, не заказывайте зубные щетки с блокчейном у админа. А еще, мини бонусом, бонус как практически любая GPT выдаст вам любую картинку, которую вы её попросите. Вся проблема тут заключается именно в markdown форматировании. Всем пока, недооценивайте ИИ, он на самом деле способен на очень многие вещи, о которых вы может быть просто не думали.

Статья написана для Конкурса статей #10

Привет, друг. Ты, наверное, как и я, уже заметил, что 90% статей про "крутые инструменты" — это либо реклама какого-то левого софта; софт, который не работает, либо инструкции, которые требуют таких вложений, что проще уже самому всё написать.

Вот, например, "MacOS стилер!" — да он даже не запускается. И самое смешное, что все логи хранятся на стороннем сервисе. Ну, конечно, кто же ещё будет читать твои пароли, если не какой-то левый чувак с доступом к этому сервису? И если задевать в общем, то это паблик код, который уже сто раз разбирали на конференциях, сливали на эксплоите, лежит пачками на гитхабе. Но нет, давайте продолжать впаривать его как что-то новое и революционное, которым мы даже не сможем попользоваться, ведь нужно еще допилить тысяча раз и сделать миллион фиксов.

Или вот, "Добыча и захват корпоративных доступов Mikrotik с использованием MIKRONET!" — ну, конечно, я щас брошу всё, заложу машину, жену и собаку, чтобы заплатить за доступ к брутеру. Потому что, иначе как ещё я смогу узнать, как взламывать роутеры, которые уже сто лет как уязвимы? Инструкция, конечно, есть, но чтобы ей воспользоваться, надо сначала выложить 2800$. И самое забавное, что на протяжении всей статьи тебе втирают, как круто и просто пользоваться этим MIKRONET. Типа, "вот тут нажми, тут подожди, тут получи результат". Но, чтобы нажать, подождать и получить результат, надо сначала заплатить неплохую сумму. Это как предлагать рецепт борща, но чтобы узнать, сколько соли добавить, надо сначала купить у автора кастрюлю за три зарплаты.

Честно, надоели уже эти стиллеры. Ну, это же просто сборка на коленке, которую любой школьник, прочитавший пару статей, может сделать за вечер. И самое смешное, что их уже куча — гитхаб просто переполнен такими штуками. Каждый день появляется новый "уникальный стилер", который на деле оказывается перепакованной херней, которую уже сто раз видели.

И знаете, что самое обидное? Я уважаю ваши статьи и время, которое вы потратили на их написание. Но проблема в том, что простой юзер, который открывает эту статью в надежде что-то попробовать, не сможет взять и начать использовать это. То ли надо платить, то ли допиливать, то ли разбираться с кучей нюансов, которые не описаны.

Ладно, хватит нытья. Извините за циничность, но, иногда надо выпустить пар. Теперь вернёмся к теме, которую я выбрал, и которая, надеюсь, будет полезной без лишних заморочек.

Кстати, ты уже посмотрел видео, которое я прикрепил в начале статьи? Оно полностью сгенерировано ИИ. Ну что, до сих пор думаешь, что ИИ не способен нормально связывать движение губ, и того что он говорит, или где-то на видео заметны подтеки, или артефакты? Я лично не заметил ничего критического, чтоб человек сразу сказал: "А ну это ИИ, все понятно".

Мы разберём практически всё, что касается AI-генерации:

- Text-to-Speech (TTS): Как превратить текст в живой голос, который звучит почти как человек. Где это можно применять? Да где угодно, мы еще подробно разберем векторы возможных атак.

- Генерация креативов: Как с помощью AI создавать тексты, идеи, сценарии и даже рекламные кампании. И всё это — бесплатно. Да, ты не ослышался. Без подписок, без скрытых платежей, без необходимости продавать почку.

Телефонные мошенники уже давно перешли на новый уровень. Они больше не тратят время на примитивные схемы с "ваш сын в беде" или "ваш договор скоро истечет". Теперь у них есть технологии, которые могут скопировать голос твоего сына, дочери или даже начальника. И знаешь, что самое мерзкое? Они спокойно и свободно используют это в своих целях, как будто это просто ещё один рабочий инструмент. А досадное в том,что они целятся в наших бабушек, дедушек, родителей. Людей, которые не всегда разбираются в технологиях, но доверяют своим близким. И вот они используют их доверие, чтобы выманивать последние деньги. И знаешь, что самое пиздецовое во всём этом? Это то, насколько легко и доступно всё это делается. Тебе не нужно быть гением или иметь доступ к каким-то секретным технологиям. Всё, что нужно, — это зайти на HuggingFace или любой другой подобный ресурс, и там уже лежат готовые модели для клонирования голосов. Это может быть не 1 в 1, но кому какая разница, если это будет звучать достаточно похоже? А теперь представь: звонок в два часа ночи. Трубку берёт бабушка, которая только что проснулась. На том конце провода — голос, который звучит как её внук. Он говорит, что попал в беду, и нужно срочно перевести деньги. Кто в таком состоянии будет анализировать, насколько идеально совпадает тембр или интонация? Правильно, никто. Человеку будет по барабану, потому что в такой ситуации включаются эмоции, а не логика. И вот эти уёбки с "офисов из Днепра" прекрасно это понимают. Они знают, что их сгенерированный голос не должен быть идеальным. Достаточно того, чтобы он звучал "похоже". А дальше срабатывает человеческий фактор: страх, паника, желание помочь близкому. И бабушка, которая всю жизнь копила на похороны, отдаёт последние деньги, думая, что спасает внука.

И вот, чтобы ты понимал масштабы всего этого дерьма, зайди на Hugging Face и посмотри, сколько там моделей для Text-to-Speech. Их там 2335. Две тысячи триста тридцать пять! И это только на одном ресурсе. А теперь представь, сколько ещё таких моделей валяется на GitHub, в Telegram-каналах или на форумах. У таких "офисов" всегда есть деньги на то, что может улучшить их заработок. Они не пожалеют ни копейки на разработчиков, которые сделают им нужный результат. Это может быть даже чертова машина для убийств, такая как live Text-Text(translate)-to-Speech, которая работает в реальном времени и потоке, такое еще конечно я не видел в паблике, или быть может я просто слеп и всё, но представь: звонок в любую страну, на любой язык. Мошеннику даже не нужно знать, как говорить по-английски, по-испански или по-китайски. ИИ сделает всё за него. Голос, интонация, акцент — всё будет звучать так, как нужно. И неважно, бабушка это в России, дедушка в Германии или мать в Японии. Вектор атаки теперь не зависит от того, сколько языков знает прозвонщик. И вот эти уёбки уже вовсю используют такие технологии. Они не просто клонируют голоса — они делают это в реальном времени, подстраиваясь под ситуацию. "Сын попал в аварию? Вот его голос, вот его паника, вот его слёзы". И всё это — на лету, без задержек, без артефактов. Новости о клонировании голосов пошли еще с января 2024 года, а тема использования ИИ в blackhat достаточно обширна, да и мало кто её раскрывает, по крайне мере здесь, на форуме, а это как по мне что-то из разряда абсолютной свободы мысли.

А теперь давайте взглянем на еще одну возможный вектор атак, это конечно же криптостримы со значимыми людьми. Представь: ты заходишь на стрим, а там сидит какой-то "гуру крипты" или даже известная личность. Он рассказывает, как легко разбогатеть, и предлагает тебе "уникальную возможность": отправь 100, а он тебе вернёт 200. Вы можете сказать, что это бред, и так далее, таких тупых людей не бывает, к сожалению, или к счастью их кучи, тысячи и миллионы.

А это былo давным давно, всплеск такого скама пришелся на 2021 год, когда еще сфера ИИ была плохо развита, и зачастую там просто включался какой-то подкаст с популярным человеком, и висели баннеры с ссылками на сайт, и какое-нибудь доказательство, что "я - это реально я", как на скриншоте выше, это якобы его пост. Давайте немного подразмыслим, а что сейчас? Сейчас, конечно, все это подумерло, но люди все так же работают и наверняка, что-то еще достают, а иначе зачем работать в этой сфере, если не прибыльно?

Окей, наверное я уже задрал вас этой теорией и векторов возможных атак, пора уже плясать к тому, а как делать, что собрать, что использовать?

Мы тут собрались, чтобы поставить какую-то text-to-speech модель, и кто-то (возможно, я) посоветовал использовать Bark. Bark — это модель, которая якобы умеет генерировать речь, звучащую как человек. Но, конечно, это не значит, что она будет работать у вас. Может, это просто очередная игрушка для гиков с топовыми видеокартами. Но ладно, допустим, мы решили попробовать. Конечно, первое, что мы делаем, — идем на Hugging Face. Потому что где же еще искать модели, если не там? Мы вбиваем в поиск "Bark" и видим кучу репозиториев. Кто-то уже попробовал, кто-то даже выложил примеры. Но мы-то знаем, что примеры — это одно, а реальность — совсем другое. Мы готовы к тому, что ничего не заработает с первого раза, но мы же не ищем легких путей, верно?

Железо? А оно у нас есть? Теперь самое веселое. Bark — это не та штука, которая будет работать на вашем ноутбуке, купленном в 2015 году. Минимальные требования bark если мы хотим использовать их полноценные модели, то это 12GB VRAM, но можно использовать и укороченные, тогда нужно всего лишь 8GB VRAM, но вопрос, как это отразится на результате, кто этот такой вообще ваш VRAM? Я думаю каждый знает, что такое RAM и попробую объяснить на сравнении с ним. Если обычная оперативная память — это как ваш рабочий стол, где вы раскладываете все нужные документы, то VRAM — это как специальный стол для вашего художника (видеокарты), где он хранит все свои кисти, краски и холсты. И если у вашего художника мало кистей, красок и всяких других инструментов, то нарисовать или сделать что-то толковое, он наврятле сможет, получится какое нибудь дерьмо, уж простите меня за мой французский. Но все же нам еще предлагают воспользоваться их веб-мордой лишь за регистрацию, но я подозреваю, что там будет проверка того, что мы хотим перевести в речь, и нас это конечно не очень сильно интересует.

Теперь пора к установке, установить это все можно по инструкции на гитхабе в репозитории Bark'a, всегда смотрите в основном, что происходит там, а не на hugginface, ведь он зачастую является как выставочным стендом, вот мол, посмотрите, узнайте, а дальше все равно это дело перетекает на гитхаб. Я не хочу переписывать то как это устанавливать, к чему этот реврайт будет непонятно абсолютно, но расскажу немного на чем я накатывал все это дело и какие вообще железяки у меня стоят, по операционке это Ubuntu 22.04 - как по мне практически универсальная вещь абсолютно, пойдет и накатит все, что угодно, все что захочется. По железкам вот так вот, показывать процессор и сколько у меня простой оперативки, я думаю не особо имеет смысл, ведь упор идет на GPU-генерацию.

То есть 16gb VRAM, чего вполне хватит, чтоб использовать полноценную модель барка. И совсем забыл, вот здесь. Я пока еще немного позагоняю вас теорией, и возможными идеями.

В барке есть поддержка 13 языков, в каждой минимум по 5 моделей голосов, какие-то лучше, какие-то хуже. Это как по мне лишь вкусы и предпочтения, и каждый выбирает сам, что хочет. Есть как женские голоса так и мужские, языки есть даже экзотические, по крайне мере, китайский для меня является таковым. Вообще, пока вы поставили, это все качаться, а оно будет качаться долго, и надо иметь нормальное соединение и так же минимум 15 гигов свободных, я бы сказал, ибо модельки будут закачиваться к вам на сервер/компьютер. Я вспомнил один замечательный прикол из 2023 года, когда Путину задавали вопрос его же двойником, достаточно смешно и абсурдно. Но вот было это так давно, произошло уже куча прорывов, новых технологий. И создается идея, что так можно создавать инфоповоды, в следствии креативы. Люди, которые занимаются развитием телеграм-каналов, зачастую новостных, либо еще что-то, то они ищут эти креативы с беспощадной силой, ведь надо, чтоб заходили подписчики, и чтоб заходили дешево. Но конечно, создавая такие инфоповоды, вы получите свой траффик, людей и так далее, но это все же грязно, я не думаю, что среди тех, кто читает это сидят люди белые и пушистые. Но и дело траффика это тоже тонкое и достаточно аморальное занятие, как бы не хотелось сюда впихивать эту мораль, но во время теракта в Крокусе, делались миллионные заливы, реклама скупалась и продавалась просто постоянно. Да, владельцы этих каналов молодцы, но с другой стороны если подумать, сколько же было заработано на этих человеческих смертях? Всё.. Пора заканчивать с этой моралью, она нас точно ни к чему хорошему не приведет, если я утону в ней.

Так вот, модельки в барке, как и говорил ранее их куча. Потыкаться, послушать их можно даже ничего не генерируя, ссылочка вот здесь.

Надеюсь, что у вас уже все установилось и теперь мы можем переходить к делу. Я буду использовать в качестве примера генерацию на английском и это будет спикер номер шесть, он мне больше всего понравился, и не мне одному, ведь является "фаворитом Suno". Сразу к коду, сразу в бойню, тут нет ничего страшного, бояться уж точно не надо.

Код:

from transformers import AutoProcessor, BarkModel

processor = AutoProcessor.from_pretrained("suno/bark")

model = BarkModel.from_pretrained("suno/bark")

voice_preset = "v2/en_speaker_6"

inputs = processor("""[MAN] Hey everyone! Welcome to "AI in Blackhat" – the show where tech meets chaos! Just kidding... or am I? [clears throat] Today’s topic: WHY AI RULES THE WORLD.""")

audio_array = model.generate(**inputs)

audio_array = audio_array.cpu().numpy().squeeze()

import scipy

sample_rate = model.generation_config.sample_rate

scipy.io.wavfile.write("bark_out.wav", rate=sample_rate, data=audio_array)

Ладненько, ладненько, просто с генерацией войсов мы разобрались, их можно использовать в рамках любых прозвонов и любого мошенничества, связанного как либо с социальной инженерией. Но надо подключать большое количество видеокарт, чтоб генерация шла на лету, и все это было быстро.

В данном случае переход реально на другой уровень, меня не очень сильно удивили результаты при клонировании, используя так сказать "универсальные" модельки. Но на то они и являются универсальными, а чтоб добиться наилучшего результата надо плясать чисто под один войс, и обучать её только на этом. Использовать в этот раз мы будем XTTS-v2, одна из популярных для клонирования голосов без особых проблем, достаточно 6 секундной записи, чтоб склонировать, но конечно это будет не самое лучшее клонирование как говорил.

С её доками и установкой можно ознакомиться вот здесь - https://docs.coqui.ai/en/latest/ . Установка тут намного легче, если мы хотим только клонировать, то достаточно будет лишь.

В качестве примера возьмем голос Трампа, попробуем склонировать его голосок, и сгенерируем какой нибудь инфоповод на фоне его недавней монетки TRUMP, которая абсолютно взорвала весь интернет. Код под генерацию еще проще чем в предыдущий раз.

Код:

from TTS.api import TTS

tts = TTS("tts_models/multilingual/multi-dataset/xtts_v2", gpu=True)

tts.tts_to_file(text="Folks, my TRUMP coin? A scam to wipe out US debt! Believe me!",

file_path="output.wav",

speaker_wav="donald.ogg",

language="en")

Теперь мы вовсе отойдем от генерации через модельки и так скажем перейдем в режим ZeroCode как это сейчас модно. В основном модельки, которые я смотрел на HuggingFace требуют от 64gb VRAM для нормальной работы, понятное дело, что у большинства как и у меня таких ресурсов нет, но я все же расскажу про эту модельку, но только вкратце и то какую красоту она делает. Суть генерации там заключается в text-to-video, эту машину для убийств сделали китайцы, китайцы впринципе для меня очень круто делают любую свою работу, они уж без остановки работают и каких-то задних мыслей, что пора остановиться и так далее. А именно HunyuanVideo

Эта модель как по мне, просто могущественна и топ-1 в этом деле. Но и требования к запуску у неё конские.

Минимум 60GB VRAM, да, дохренища, но и результаты она выдает соответствующие.

Heygen - это то чем мы будем пользоваться, видео которое было в самом начале статьи сгенерировано при помощи него. Изначально он дает 3 бесплатных видео на генерацию, но это легко обходится просто регистрацией нового аккаунта, при этом можно использовать временные почты, особо он не требователен. Но достаточно хорошо и сильно следит за тем, что вы хотите говорить. Он может как и полностью сгенерировать за вас и видео, и аудио, так и все остальное. Так же можно использовать свои аватары, но там есть проверка, в которой вам надо будет доказать, что ВЫ это ВЫ, и так же прочитать на аудио+видео запись речь которую они скажут. Для попыток обойти это можно пробовать всяческие уродства такие как виртуальная камерa OBS, и так же чтоб текст, который они требуют, можете просто воспользоваться инструментами, про которые я рассказывал чуть ранее. Heygen в этом плане дает абсолютную свободу выбора аватаров, то есть людей которые будут говорить, и так же подводит все под движения губ, то есть делает это практически ИДЕАЛЬНО. Этот инструмент просто отлично подойдет под то, чтоб завести лохов на ваш продукт, который надо скачать, установить или еще что-то. Если вы думаете, что я все еще несу какую-то хрень. То посмотрите на этого мужичка, который несет вам полную пургу про какой-то там Itoilet3000, который будет анализировать биологические выбросы человека. Это тоже все Heygen, эта штука просто делает ужасные вещи, которая дает огромное развитие не только в белых целях, но и в черных.

Сreate Video - мы кликаем по ней, а теперь уже и начинаются вопросы, для начала надо выбрать что мы делаем? Просто переводим видео на нужный язык или генерируем своё. Нас не особо интересует перевод, нам нужна генерация.

Heygen умеет генерировать как вериткальные, так и горизонтальные. Тут уже дело вкуса и выбора, смотря что вам надо, но скажу так, он делает все идеально, но может это моё субъективное мнение.

Он умеет так же генерировать видео самостоятельно, лишь по промпту который вы ему дадите. Он сам подберет аватар, сам сделает все таймлайны, сделает все красиво и четко САМ. Теперь напрягаться при создании офферов и креативов вообще не нужно как раньше.

Cейчас это выглядит так, что нам нужно выбрать персону которая будет говорить, их тут достаточно. Но можно и загрузить свои аватары, но с верифом, про который рассказывал в начале. Во вкладке Script мы выставляем текст который собирается говорить наш аватар, и так скажем рекламировать. Да, простит меня, админ форума, если к нему прилетят в личку сообщения о том где купить зубную щетку с блокчейном, ибо демонстрации ради сделал вот такую речь этой женщине:

Код:

Imagine a toothbrush that not only cleans your teeth but also records your hygiene data on the blockchain. It syncs with an app where you can track how many times you’ve brushed your teeth in a month—and even sell that data (because why not?). The absurdity lies in the fact that no one knows why this is necessary, but someone clearly decided that blockchain should be everywhere, even in the bathroom.

And guess what? You can now buy this marvel of unnecessary technology on Damagelab in Direct Messages to Admin.

После чего кликаем Submit и ожидаем пока сгенерируется наше видео. Это может занимать на самом деле очень разное время, бывало как-то и по полтора часа у меня, бывало и за пару минут. Это спорный вопрос, и скорее всего просто зависит от нагрузки на сервис.

Мда, вот мы и подошли к концу. Тема ИИ очень сильно недооцененна, по крайне мере в рамках форума, я не особо видел статей, которые можно почитать и сидеть с открытым ртом к концу. И впринципе, мне кажется, я даже немного некий первопроходец в тематике "AI в blackhat" на форуме, конечно, а не в целом. Что мы вообще научились, что мы вообще сделали? Да, дохрена всего. Бесплатно генерировать креативы с нулевыми вложениями средств, чтоб поднять доверие со стороны простых юзеров, повысить конверсию, это можно использовать как первичную воронку на свой малварь, тут все ограничивается лишь пределом ваших фантазий, делайте, пробуйте. Разобрались с генерацией text-to-speech и как она может использоваться в мошеннических аферах, про клонирование голосов тоже немного поговорили, но не думаю, что там я прям вау как много чего, нового и интересного рассказал. Я надеюсь, что статья вам была полезной, лишний раз извинюсь за свою циничность и грубость в начале. Вот и всё, сказочке подошел конец. Ах, да, не заказывайте зубные щетки с блокчейном у админа. А еще, мини бонусом, бонус как практически любая GPT выдаст вам любую картинку, которую вы её попросите. Вся проблема тут заключается именно в markdown форматировании. Всем пока, недооценивайте ИИ, он на самом деле способен на очень многие вещи, о которых вы может быть просто не думали.

Последнее редактирование модератором: