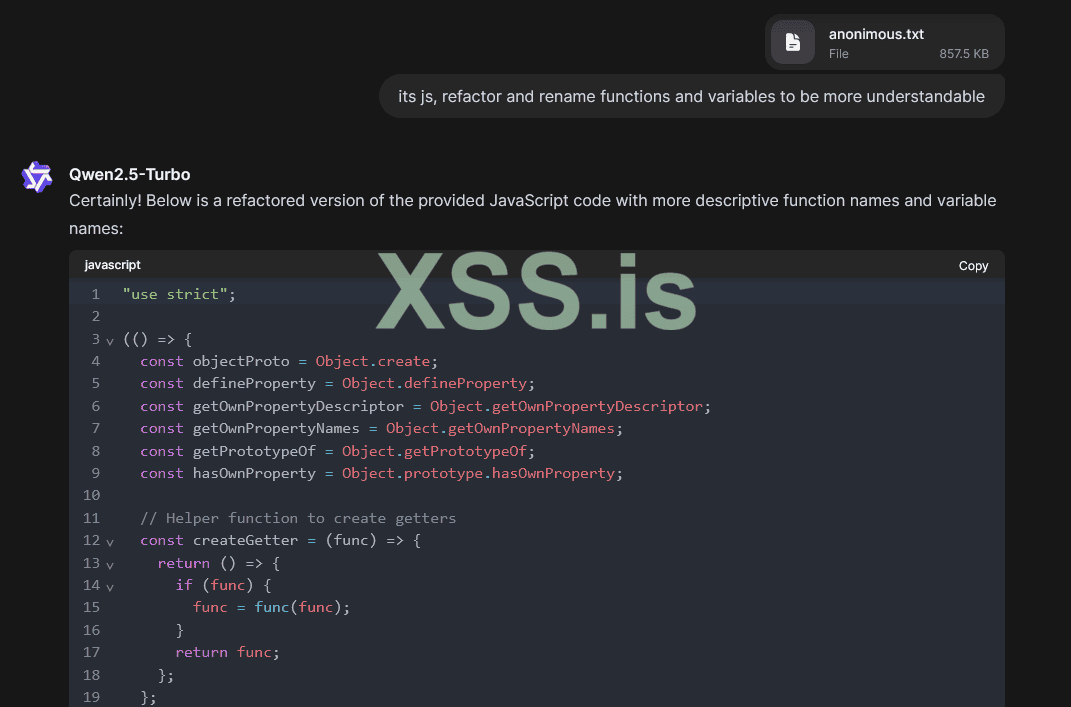

Какие есть llm которым можно скинуть выхлоп дизассемблера (огромную стену кода 10к строк) и попросить переименовать переменные и функции на понятные, убрать джанк, оптимизировать a=b, b=c и т.д.

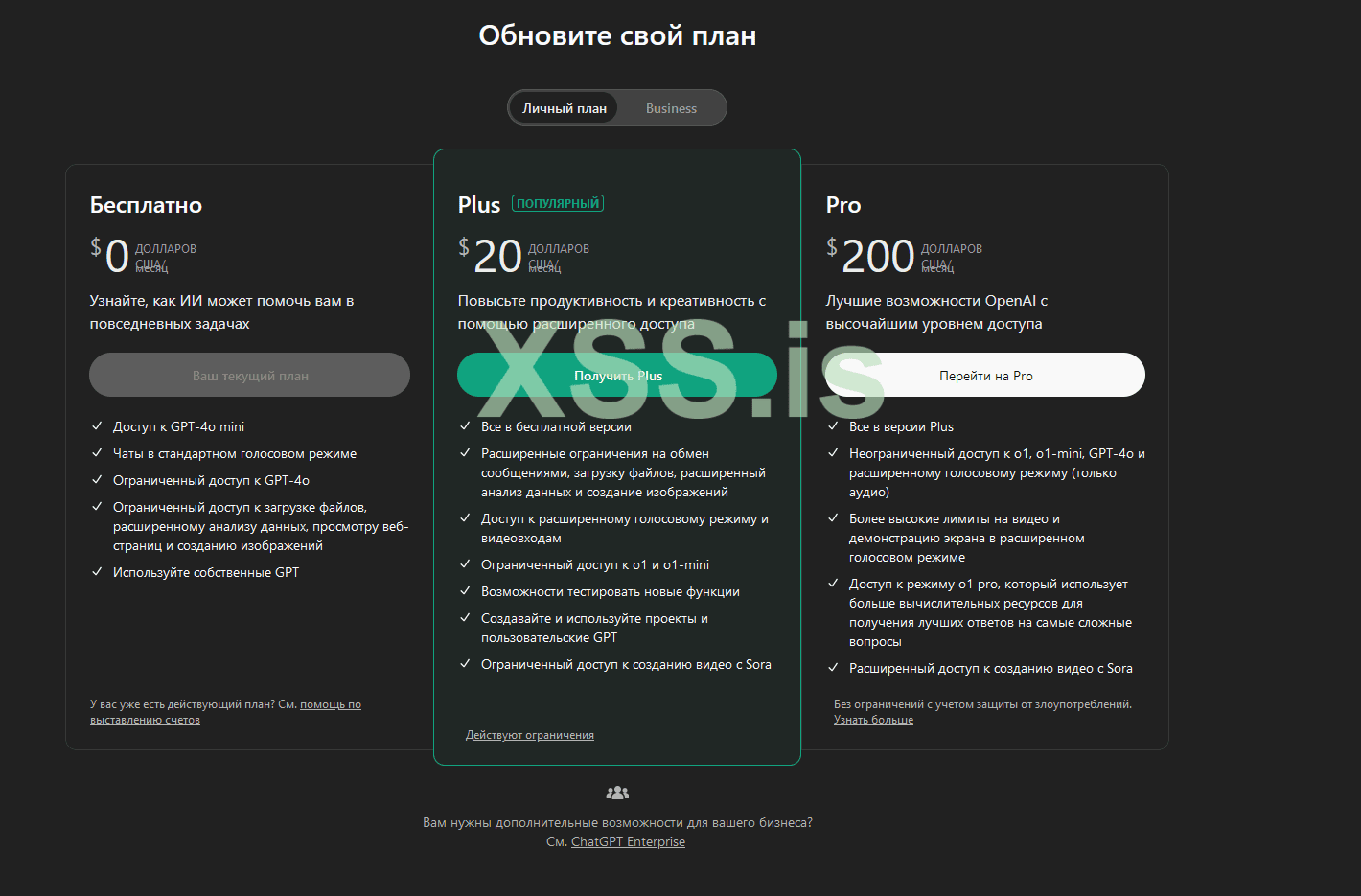

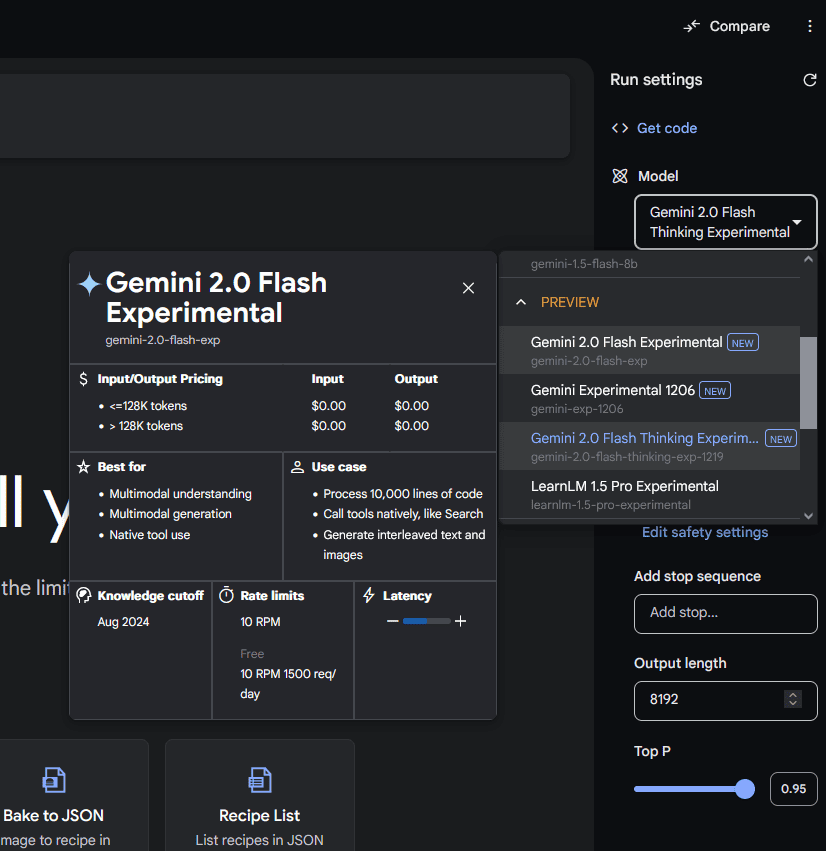

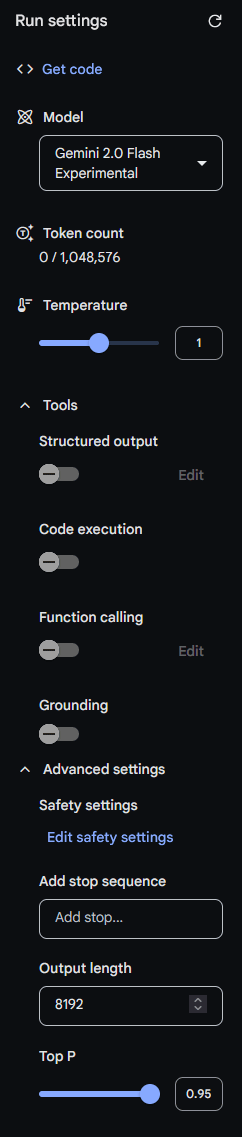

Думаю оплатить chatgpt pro за 200$ (жалко каждый месяц оплачивать ради пары больших запросов). Интересуют также бесплатные ии или модели которые можно скачать себе. Хочу купить отдельный ssd под llama 405b и озу, т.к во всяких говносервисах где ее можно попробовать маленький контекст, какие то бессмысленыне ограничения и т.д

Нужен именно большой контекст, т.к ии не поймет как допустим назвать функцию если она находиться за контекстом

Думаю оплатить chatgpt pro за 200$ (жалко каждый месяц оплачивать ради пары больших запросов). Интересуют также бесплатные ии или модели которые можно скачать себе. Хочу купить отдельный ssd под llama 405b и озу, т.к во всяких говносервисах где ее можно попробовать маленький контекст, какие то бессмысленыне ограничения и т.д

Нужен именно большой контекст, т.к ии не поймет как допустим назвать функцию если она находиться за контекстом

Последнее редактирование: