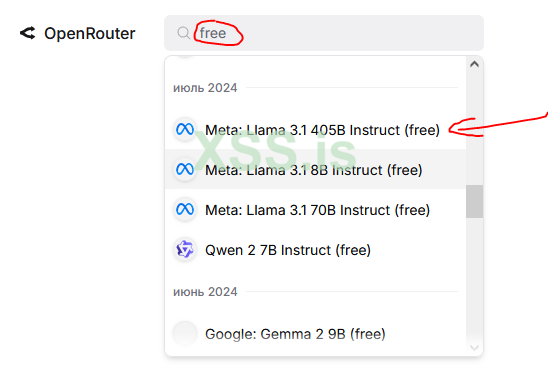

Какие есть локальные текстовые модели ai, что бы они были не мега тупыми?

Искал искал, огромное куча всего, хочу сразу просто спросить у людей кто знает, что лучше юзать

Искал искал, огромное куча всего, хочу сразу просто спросить у людей кто знает, что лучше юзать