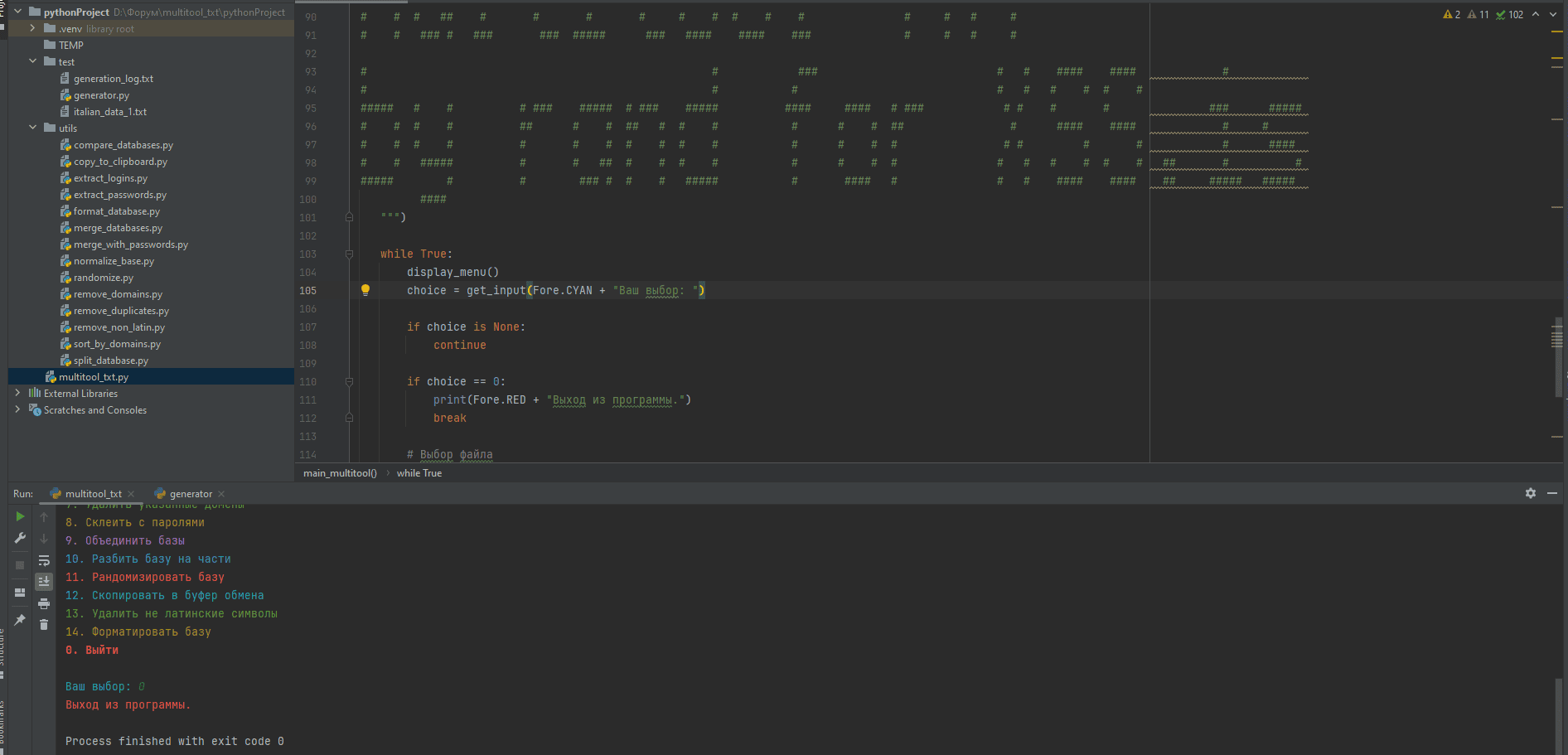

Контекстное меню сделать не сложнотоварищи незнаю где такое выставить попробую выставить тут.

https://nohide[.]space/threads/luch...raboty-s-tekstom-text-utils-pack-by-lays.250/

самый шикарный софт был в свое время, но как я понял сейчас всю дорогу зараженный...

мб у кого то есть такой чистенький?

а так же предлагаю тсу спрятать софт в пкм и будет просто пушка!

или может развить софт до такого же уровня как у Lays?

за удобство люди будут готовы платить деньги

сколько людей качало этот софт by Lays не счесть. прям народный

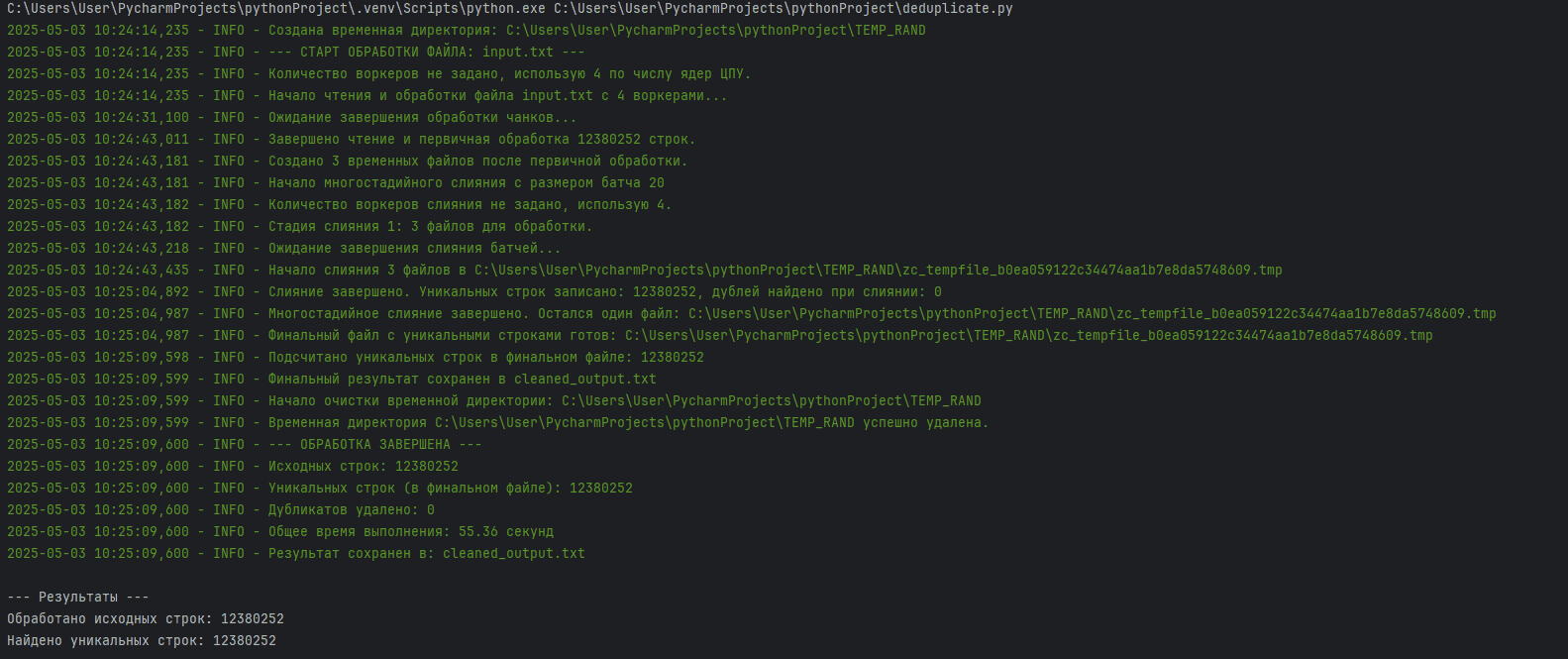

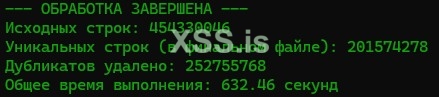

*может быть что удаление дублей там работало не оч

Но нужно четкое тз, что подразумевается под каждой функцией, что должно входить и выходить, куда, формат баз и тд