- Автор темы

- Добавить закладку

- #21

Попробовал такой подход реализовать на питоне, да всё работает, но увы очень медленно пишет в БД строки....такой подход мне не понравился, может я что-то не так делал. Но код даже показывать не охото, ибо стыдно =)вообще попробуй переписать чтоб ты сверял реально по базе, самая оптимальное что наверное могу посоветовать и без установки доп бд и всяких пакетов это sqlite и лимиты вроде позволяют https://www.sqlite.org/limits.html

Посмотреть вложение 95179

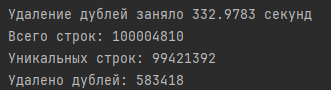

Я ищу вариант где можно и рыбку съесть (быстрая работа), и косточкой не подавится (экономия ресурсов ОЗУ).

Последнее редактирование: