Скажу прямо - на данный момент скрипт сыроват, и будет дорабатываться.

Что делает скрипт? Полностью автоматически собирает сайты с xss и sql уязвимостями.

Как это работает? Через гугл дорки. Вы вводите запрос, количество проверяемых сайтов, опцию проверки, потоки, и скрипт проходится по сайтам.

Функционал:

1. Работа через прокси

2. Выбор кол-ва потоков

3. Выбор проверки: xss, sql, xss&sql

4. Возможность добавления сайтов в исключение

5. Проверка прокси перед запуском проверки

Известные мне недочеты:

1. Плохая проверка xss(фактически нерабочая)

2. Достаточно долгая проверка(хотелось бы быстрее)

3. Неудобное добавление прокси.

Что будет добавлено в новой версии:

1. Фикс всех недочетов

2. Будут добавлены новые источники

3. Более удобный и красивый вывод сайтов с уязвимостями

4. Фикс мелких ошибок

Зачем я выкладываю сырой скрипт?

Что бы получить фидбек, а нужно ли это вообще. Ну и конечно же что бы получить предложения по улучшению.

Работа скрипта

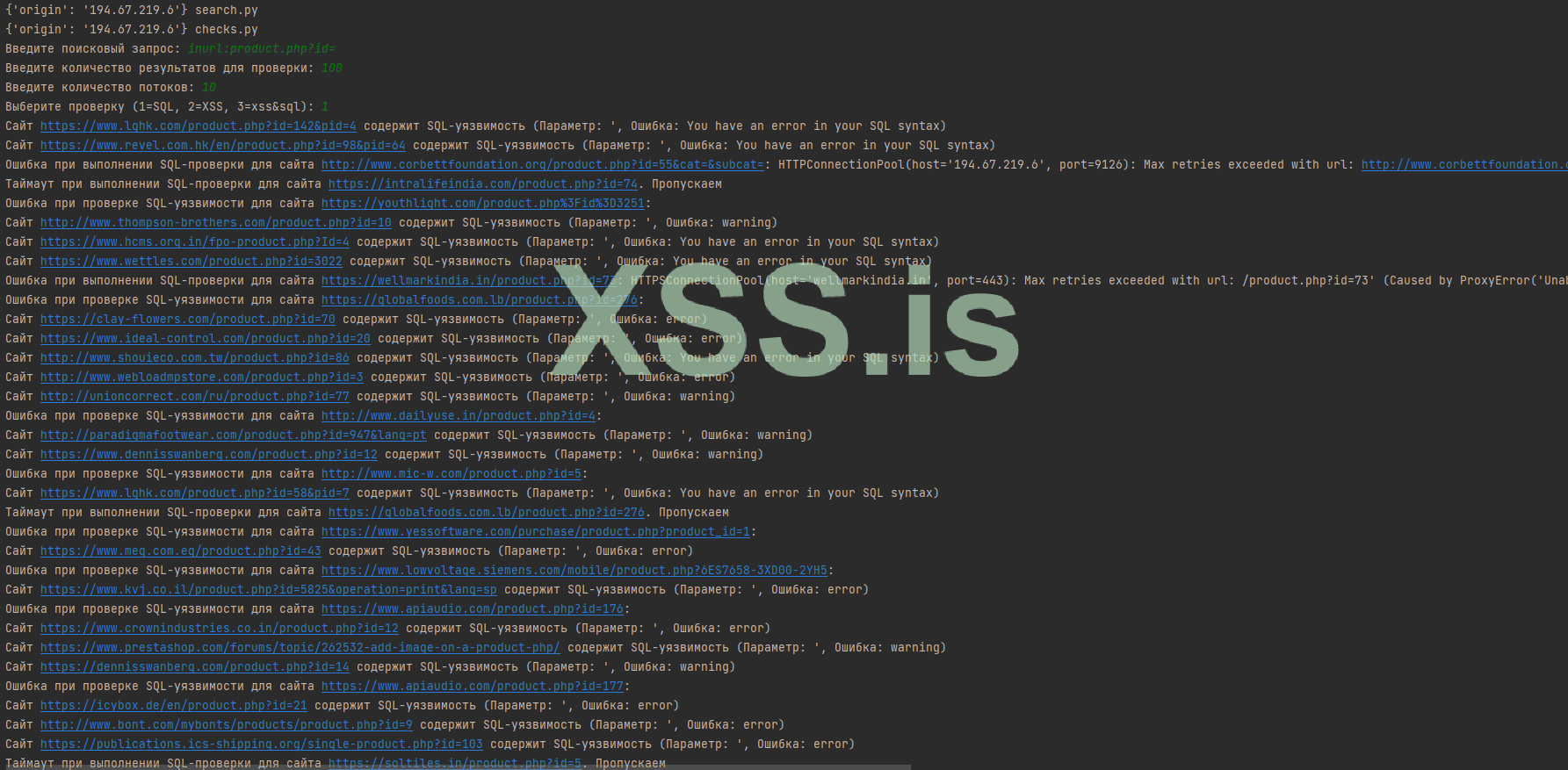

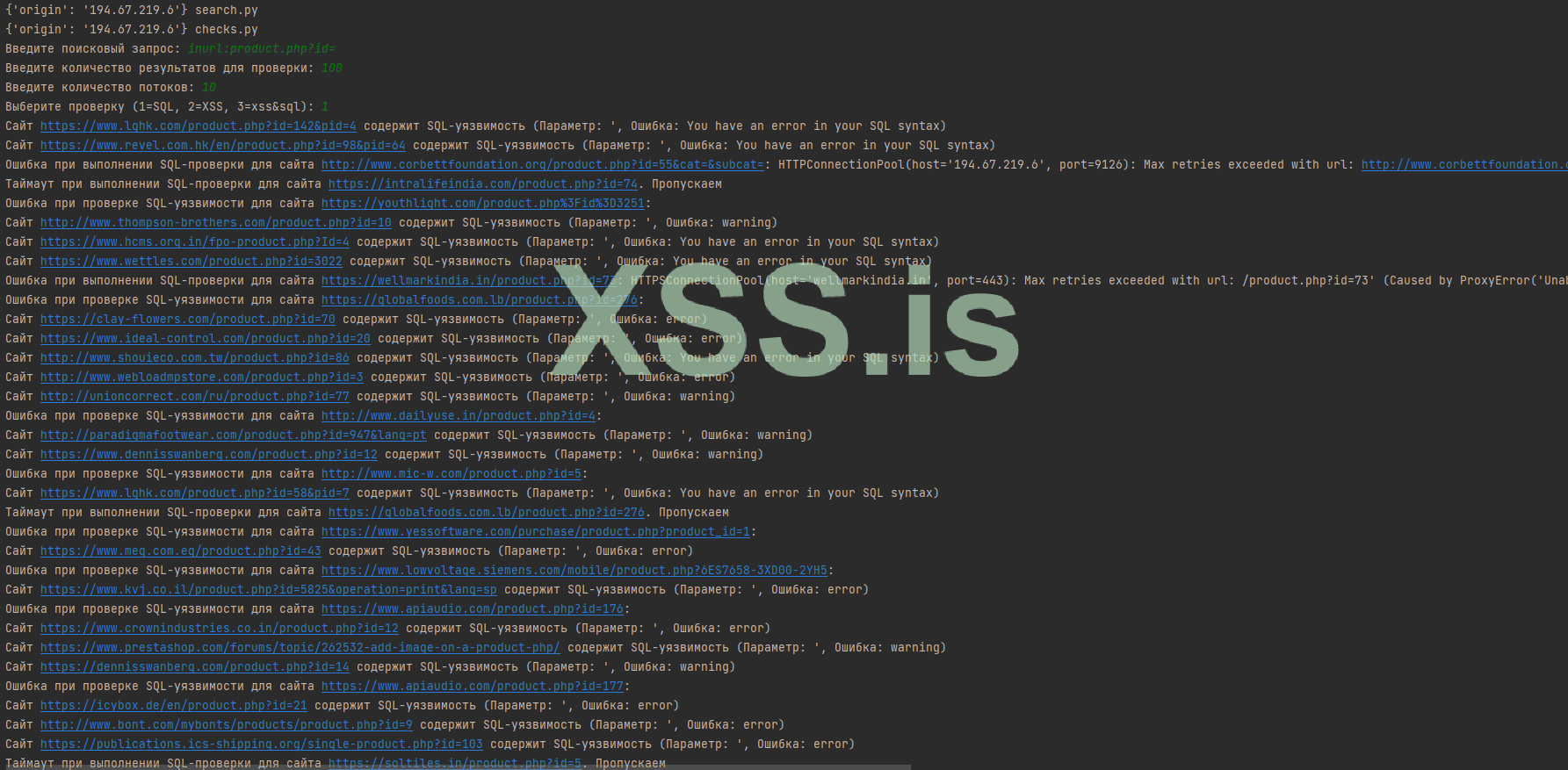

Вывод в cmd:

Как вы можете увидеть, проверка происходит через подстановку в ссылку пэйлоада, а уязвимость ищется по ошибкам. Так же в скрипте установлен таймаут, если от сайта нет ответа в течение определенного времени, то он пропускается.

Как вы можете увидеть, проверка происходит через подстановку в ссылку пэйлоада, а уязвимость ищется по ошибкам. Так же в скрипте установлен таймаут, если от сайта нет ответа в течение определенного времени, то он пропускается.

В самом начале происходит проверка работоспособности прокси для каждого файла где они используются.

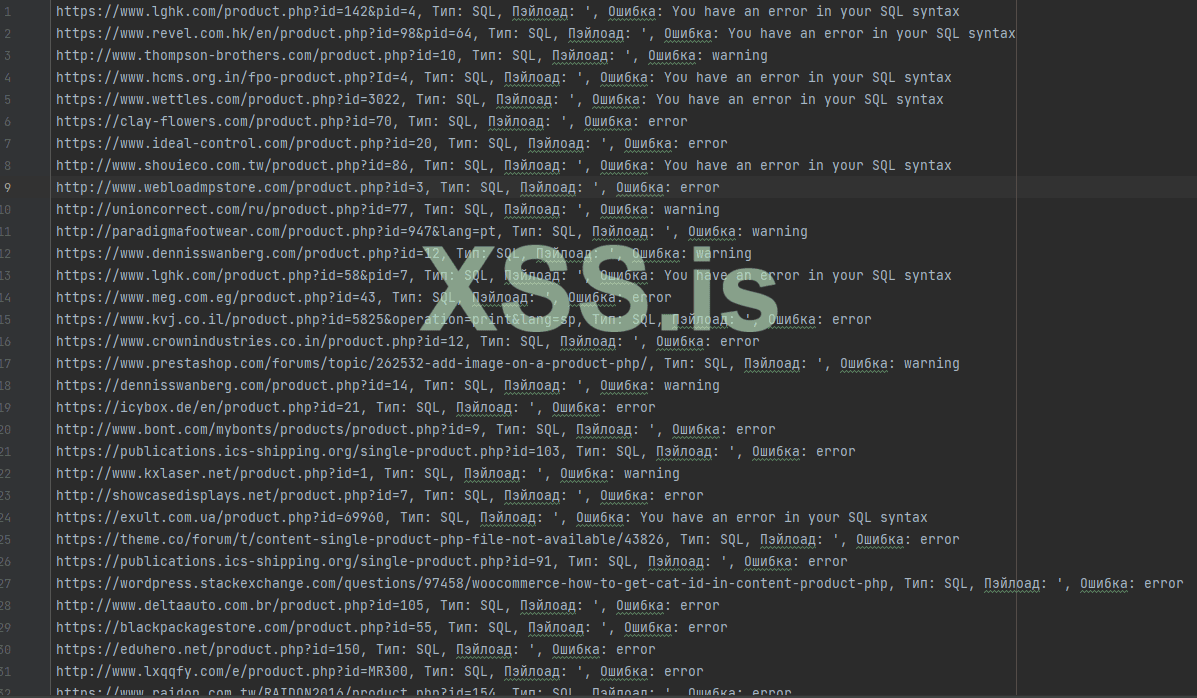

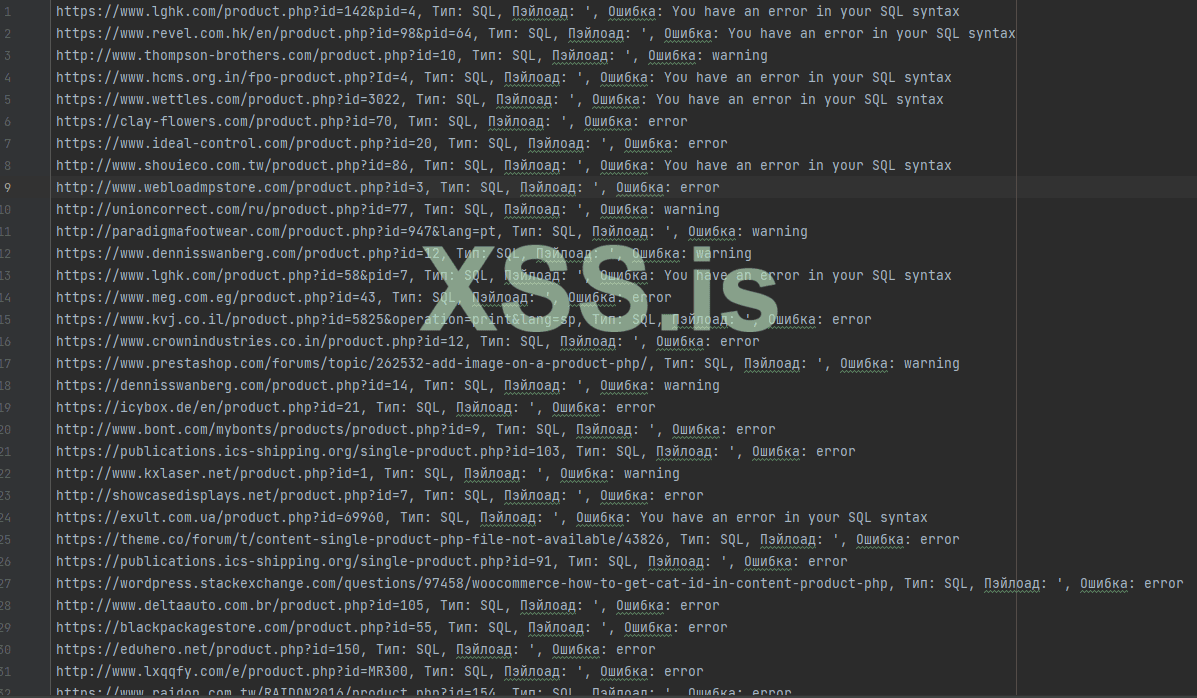

Вывод в файл:

Знаю, всего много и всё непонятно. Не могу придумать красивый вывод.

Знаю, всего много и всё непонятно. Не могу придумать красивый вывод.

Правильность проверки:

Из 20 сайтов помеченных как уязвимые, 4 были без уязвимости. Я считаю что результат довольно приемлемый.

Что и куда добавлять:

файлы dorks и proxies можно не трогать, они нужны на следующее обновление.

Что бы добавить сайты в исключения, нужно добавить домены построчно в файл exclude_domains

так же вы можете добавить свои пэйлоады и ошибки в файлы sql_errors и sql_payloads соответственно.

В файлах checks.py и search.py вставляются прокси(без них работать не будет)

Сам скрипт на данном этапе я не считаю конкурсным, но по мере обновления думаю что дотянет Ожидаю фитбеков!

Ожидаю фитбеков!

Что делает скрипт? Полностью автоматически собирает сайты с xss и sql уязвимостями.

Как это работает? Через гугл дорки. Вы вводите запрос, количество проверяемых сайтов, опцию проверки, потоки, и скрипт проходится по сайтам.

Функционал:

1. Работа через прокси

2. Выбор кол-ва потоков

3. Выбор проверки: xss, sql, xss&sql

4. Возможность добавления сайтов в исключение

5. Проверка прокси перед запуском проверки

Известные мне недочеты:

1. Плохая проверка xss(фактически нерабочая)

2. Достаточно долгая проверка(хотелось бы быстрее)

3. Неудобное добавление прокси.

Что будет добавлено в новой версии:

1. Фикс всех недочетов

2. Будут добавлены новые источники

3. Более удобный и красивый вывод сайтов с уязвимостями

4. Фикс мелких ошибок

Зачем я выкладываю сырой скрипт?

Что бы получить фидбек, а нужно ли это вообще. Ну и конечно же что бы получить предложения по улучшению.

Работа скрипта

Вывод в cmd:

В самом начале происходит проверка работоспособности прокси для каждого файла где они используются.

Вывод в файл:

Правильность проверки:

Из 20 сайтов помеченных как уязвимые, 4 были без уязвимости. Я считаю что результат довольно приемлемый.

Что и куда добавлять:

файлы dorks и proxies можно не трогать, они нужны на следующее обновление.

Что бы добавить сайты в исключения, нужно добавить домены построчно в файл exclude_domains

так же вы можете добавить свои пэйлоады и ошибки в файлы sql_errors и sql_payloads соответственно.

В файлах checks.py и search.py вставляются прокси(без них работать не будет)

194.67.219.6:9126 log:pass tYEHNF:4qL46y

Используйте только для тестов!

Используйте только для тестов!

Сам скрипт на данном этапе я не считаю конкурсным, но по мере обновления думаю что дотянет

Вложения

Последнее редактирование:

а ещё без дублей)

а ещё без дублей)