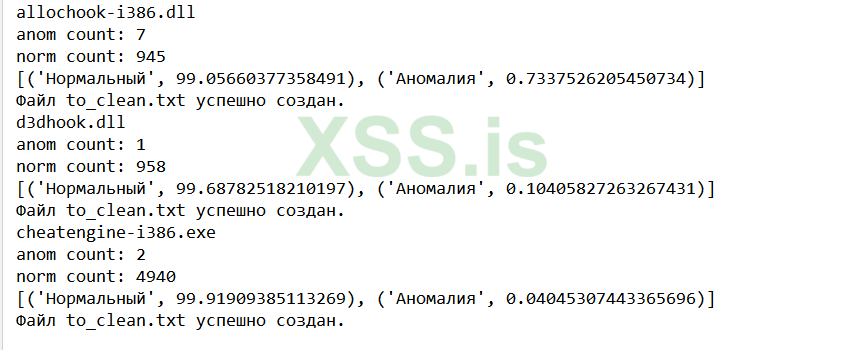

Вижу в этом плюс для тематики чтобы сделать модельку норм + плохую модельку из образцов малвари. Думаю полезная инфа.

Тут был на форуме тип который обучал модель но потёр посты.

Метод RELIEF для выбора наиболее важных признаков работает следующим образом:

1. Для каждого признака (например, n-граммы опкодов) задается вес равный 0.

2. Случайным образом выбирается опорный вектор x из обучающей выборки.

3. Находятся два его ближайших соседа:

- ближайший попадание (nearest hit) xh из того же класса

- ближайший промах (nearest miss) xm из другого класса

4. Обновляются веса для каждого признака по формуле:

wi = wi + (xi - xmi)2 - (xi - xhi)2

5. Повторяются шаги 2-4 много раз для разных случайно выбранных опорных векторов.

6. Выбираются nsf признаков с наибольшим весом - это наиболее важные признаки.

Построение модели нормального ПО на основе этих признаков осуществляется с помощью итеративного алгоритма кластеризации на базе машин опорных векторов, описанного в статье. Суть в том, чтобы разбить все векторы признаков незараженных файлов на несколько кластеров, соответствующих разным "нормальным" моделям поведения.

Затем для каждого кластера строится описание границы нормальных объектов с помощью машин опорных векторов или описаний опорных векторных данных. Это и есть итоговая модель нормального ПО.

Обобщенная инфа с pdf

Тут был на форуме тип который обучал модель но потёр посты.

Метод RELIEF для выбора наиболее важных признаков работает следующим образом:

1. Для каждого признака (например, n-граммы опкодов) задается вес равный 0.

2. Случайным образом выбирается опорный вектор x из обучающей выборки.

3. Находятся два его ближайших соседа:

- ближайший попадание (nearest hit) xh из того же класса

- ближайший промах (nearest miss) xm из другого класса

4. Обновляются веса для каждого признака по формуле:

wi = wi + (xi - xmi)2 - (xi - xhi)2

5. Повторяются шаги 2-4 много раз для разных случайно выбранных опорных векторов.

6. Выбираются nsf признаков с наибольшим весом - это наиболее важные признаки.

Построение модели нормального ПО на основе этих признаков осуществляется с помощью итеративного алгоритма кластеризации на базе машин опорных векторов, описанного в статье. Суть в том, чтобы разбить все векторы признаков незараженных файлов на несколько кластеров, соответствующих разным "нормальным" моделям поведения.

Затем для каждого кластера строится описание границы нормальных объектов с помощью машин опорных векторов или описаний опорных векторных данных. Это и есть итоговая модель нормального ПО.

Обобщенная инфа с pdf

В соответствии с инструкциями я проанализирую эту научную статью, чтобы определить ее основную идею, методологию, результаты и выводы.

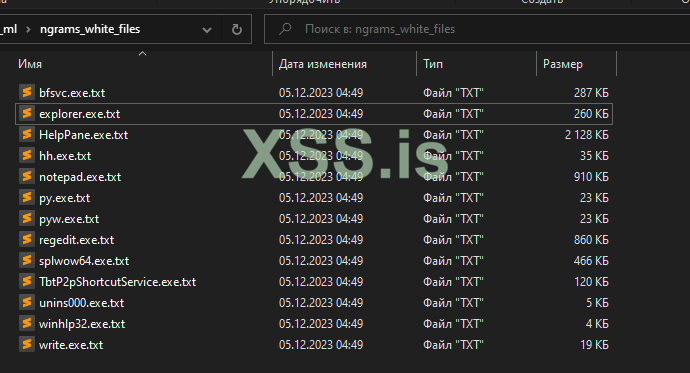

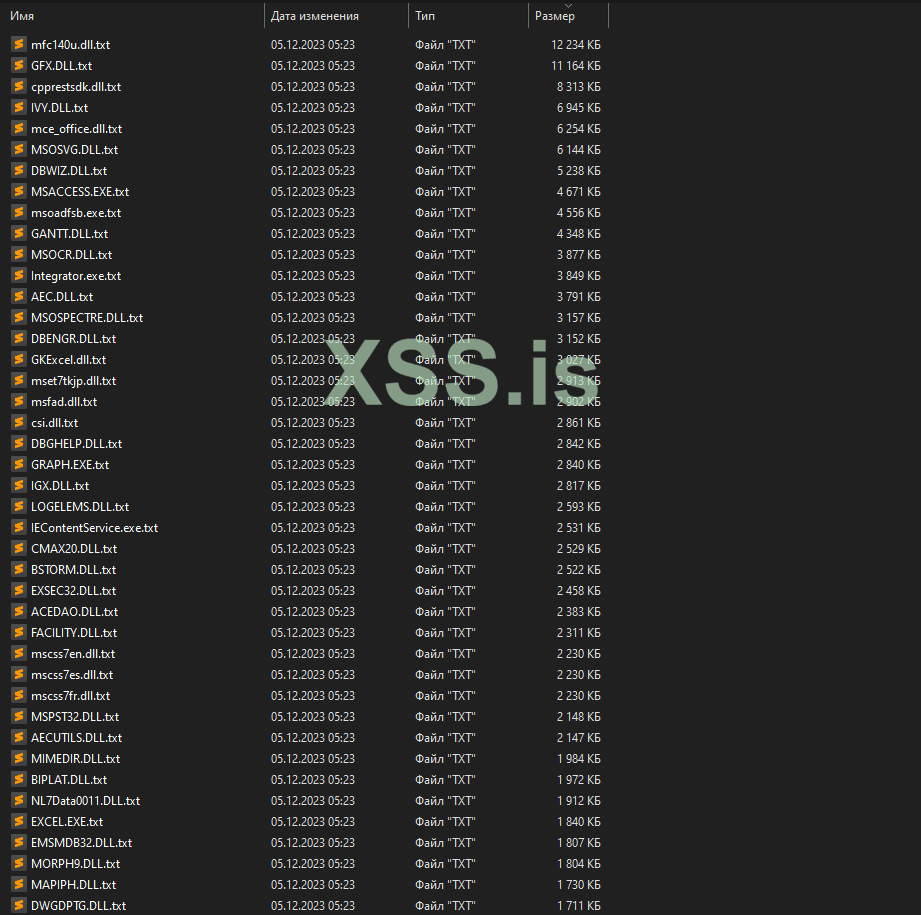

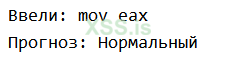

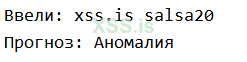

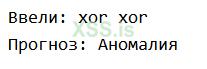

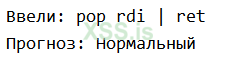

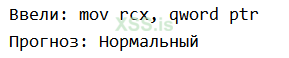

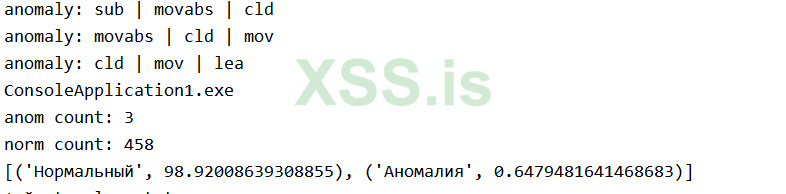

Основная идея статьи заключается в использовании аномального подхода к обнаружению вредоносного ПО, основанного на анализе последовательностей опкодов. Авторы применяют n-граммные модели для извлечения важных признаков из этих последовательностей, а затем используют итеративный алгоритм группировки на основе машин опорных векторов в сочетании с описаниями опорных векторных данных для построения модели нормального поведения программного обеспечения.

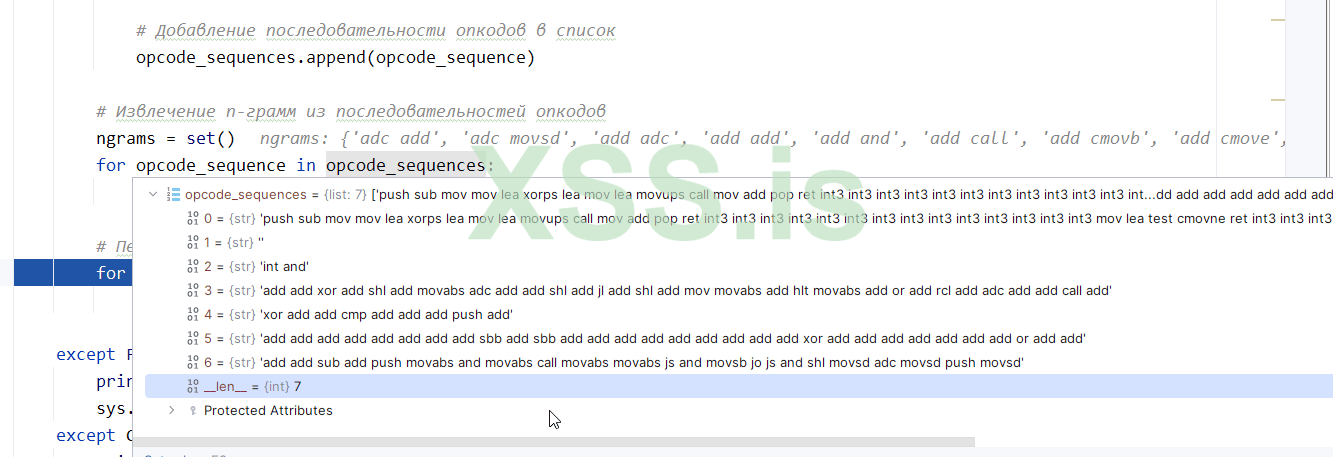

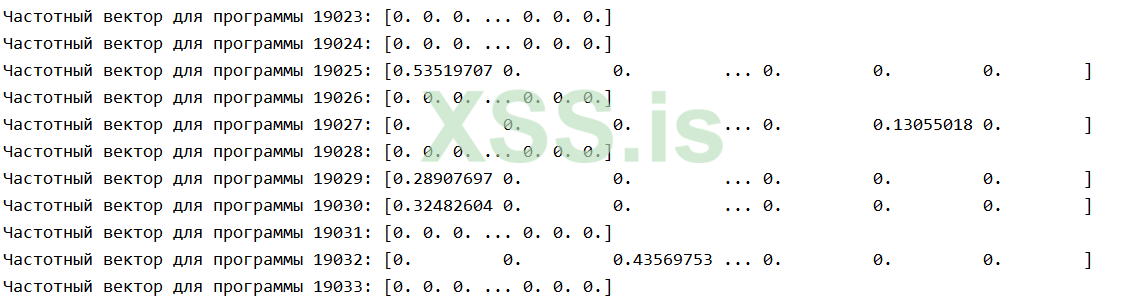

В качестве методологии авторы извлекают последовательности опкодов из исполняемых файлов, применяют к ним n-граммные модели для получения векторов признаков, используют метод RELIEF для выбора наиболее важных признаков и строят модель нормального ПО с помощью итеративной группировки на основе машин опорных векторов и описаний опорных векторных данных.

Основными результатами являются построенная модель нормального поведения ПО и показанная эффективность предложенного метода обнаружения неизвестных ранее вредоносных программ. По сравнению с существующими аналогами предложенный алгоритм продемонстрировал более высокую точность классификации (97,09%).

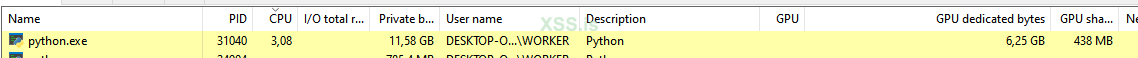

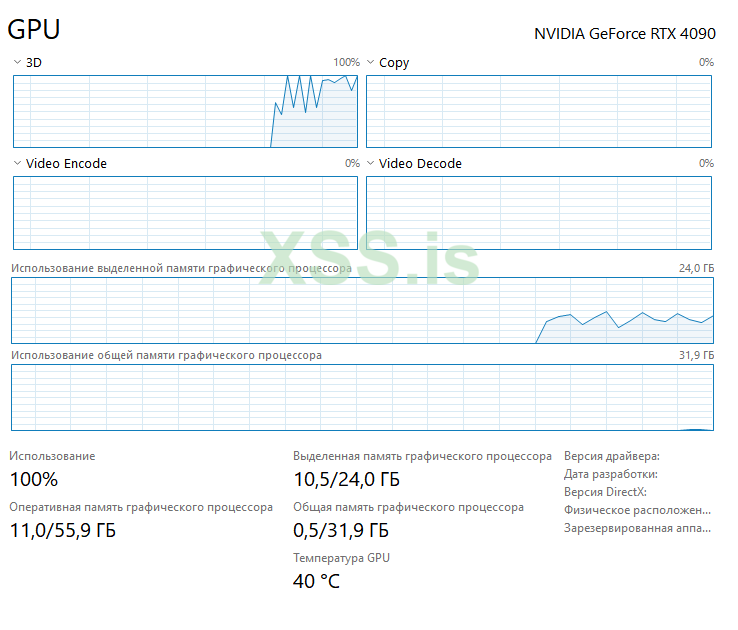

К сожалению, в статье не указаны конкретные ошибки или неточности. Авторы лишь отмечают, что алгоритм требует значительных вычислительных ресурсов на этапе обучения при большом объеме обучающей выборки.

В целом, эта статья предлагает эффективный метод аномального обнаружения вредоносных программ на основе анализа последовательностей опкодов с помощью опорных векторов. Полученные результаты позволяют сделать вывод о применимости данного подхода для построения систем обнаружения неизвестных ранее угроз. Дальнейшие исследования могут быть направлены на оптимизацию алгоритма и включение в анализ параметров опкодов.

Таков мой анализ основной идеи, методологии, результатов и выводов данной научной статьи. Я готов ответить на любые дополнительные вопросы по ее содержанию.