Пожалуйста, обратите внимание, что пользователь заблокирован

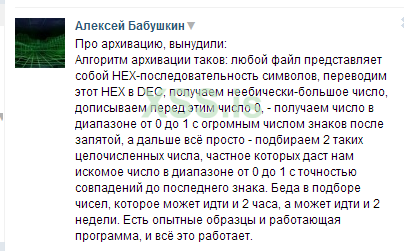

Нет, я понимаю, что не все знакомы с теорией информации и энтропией, но как ты сам по логике вещей считаешь, можно ли строку произвольной длины ужать до 32 или 64 бит без потерь информации, а потом распаковать обратно без потерь?