- Автор темы

- Добавить закладку

- #21

а почему ты думаешь что это уже prod?)бить боксеров, грабить банки, играть в бейсбол

Ведь мой папа, ведь мой папа - пиздабол)

сабж.

supra уже 3 поста, и 0 цитат темниковой... стареешь... скучно)

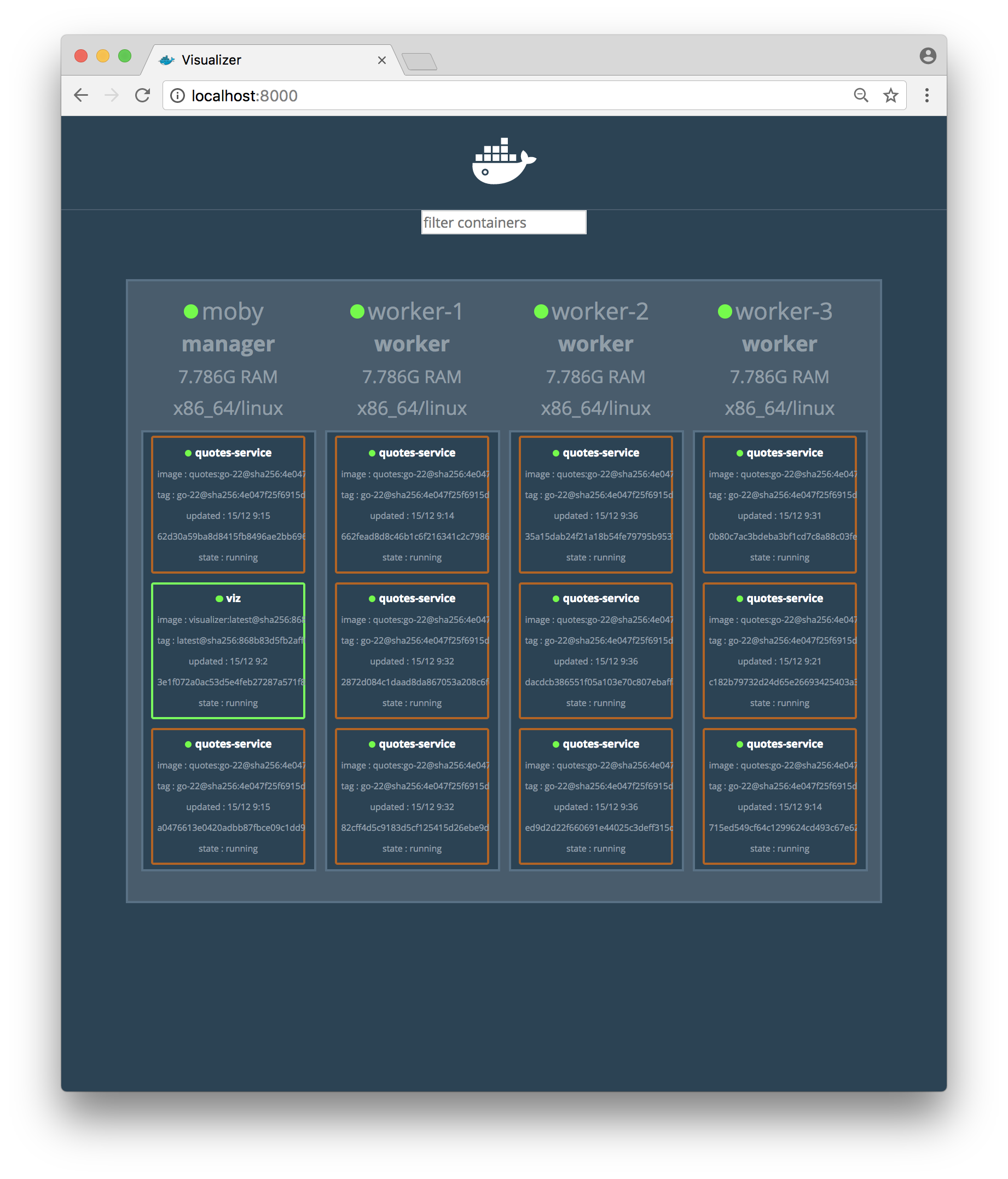

про композ абсолютно согласен. композ+докер акшон = авто деплой, без костылей с сшш и прочей мутотени.

в общем и целом, без грамнотного распределения, отработки ошибок, нормального управления машинами и единой целостной системы - это все так, лирика. оно и ежу понятно, что этот пок будет ворк. народ требует, хлеба, зрелищь! и прод версию!)

да и где конкурсная объективность, друзья? у новорегов до каждой "точки с запятой" доебываются, а сторожилы - "хуяк, хуяк и в прод" и все, сразу аплодисменты) не надо так)