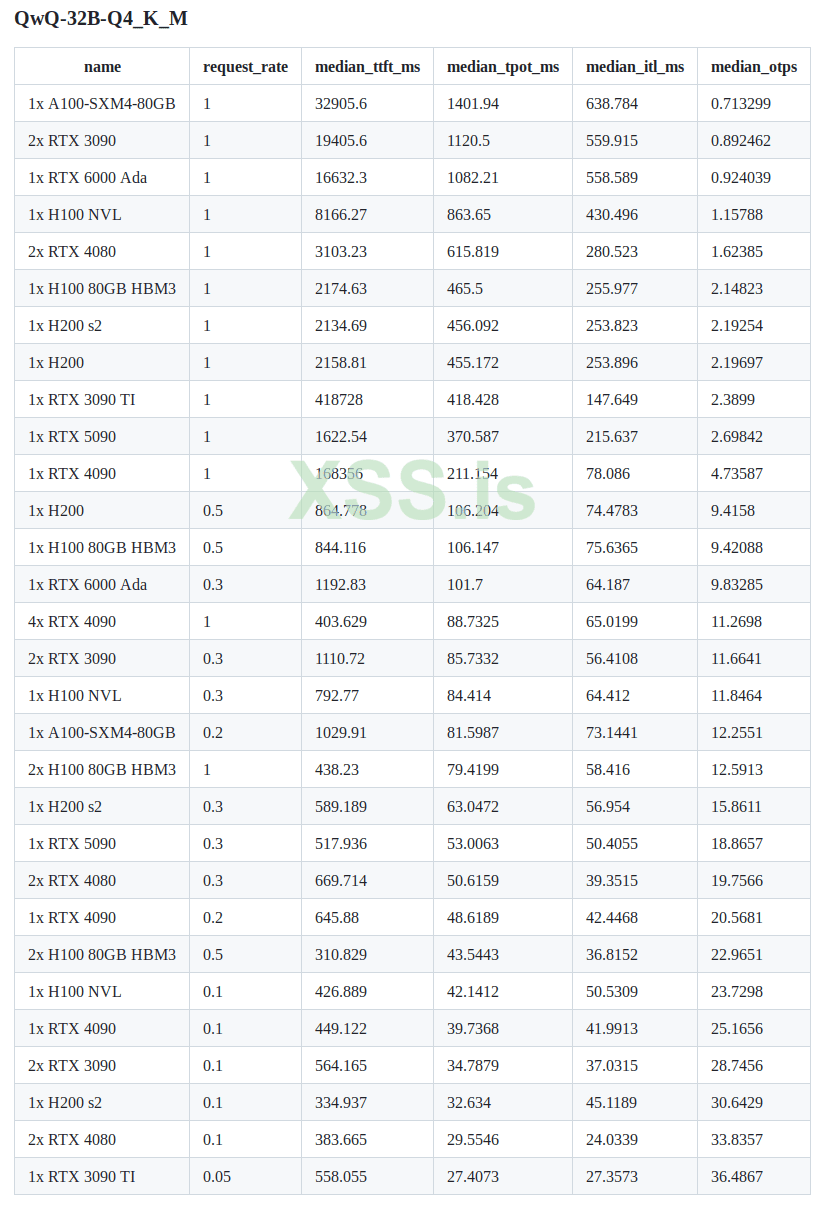

бенчмарк нескольких топовых видеокарт, пары эппловских компов, и комбинаций из нескольких "потребительских" карт типа 3090:

взято отсюда: https://github.com/XiongjieDai/GPU-Benchmarks-on-LLM-Inference

взято отсюда: https://github.com/XiongjieDai/GPU-Benchmarks-on-LLM-Inference

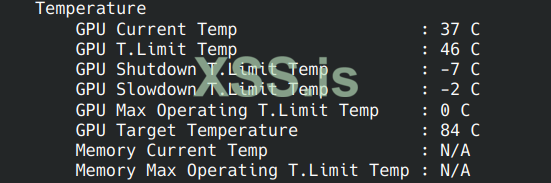

попробуй сам, отпиши в топике.

попробуй сам, отпиши в топике.

4090D на 11% медленнее, но на 26% дешевле.

4090D на 11% медленнее, но на 26% дешевле.