Пожалуйста, обратите внимание, что пользователь заблокирован

приехал параллельноимпортированный E-2388, и я что-то не понял прикола.

У них прикол есть, если грузить все ядра - иногда может по превышению TDP троттлить.

приехал параллельноимпортированный E-2388, и я что-то не понял прикола.

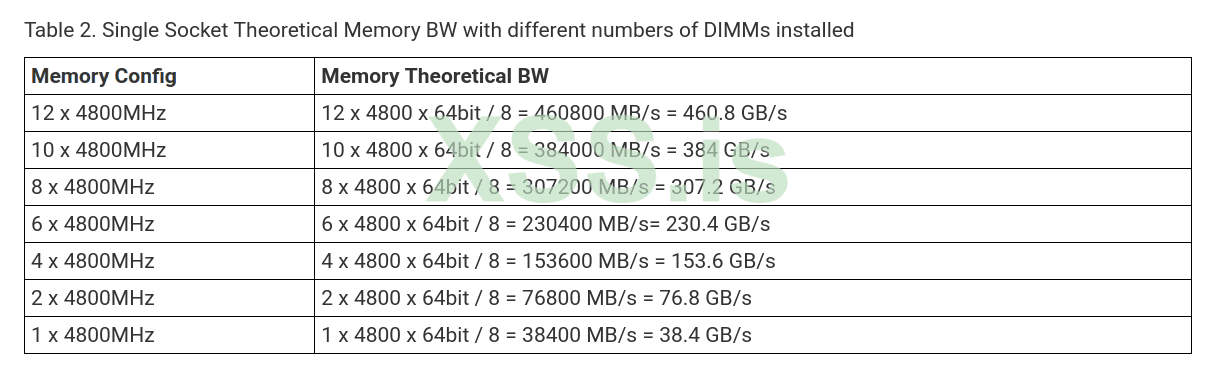

кажется, я понял, в чём дело: я забыл, что апгрейднул сервер с 64 до 128 гб оперативы, старые планки по 16 были single rank, а новые по 32 - dual rank.фигня какая-топо попугаям 5% прирост должен быть, плюс 2 дополнительных ядра, итого должно быть на 10% быстрее, если не больше.

$1300 за модульВсё таки приблуды от nvidia для этих целей лучше подойдут, если 512 маловато, то там есть на 2048 (Jetson AGX Orin 64 Gb)

NVIDIA Jetson Xavier Series

It’s the next evolution in next-generation intelligent machines.www.nvidia.com

это дешевле, чем сервер, но, блин, куда этот сервер теперь девать?

это дешевле, чем сервер, но, блин, куда этот сервер теперь девать? $1300 за модульэто дешевле, чем сервер, но, блин, куда этот сервер теперь девать?

а теперь я точно понял, в чём дело: 64 гб оперативы работают на частоте 3200 МГц, а при установке 128 гб дофига умный контроллер на мамке сбрасывает скорость до 2933.кажется, я понял, в чём дело: я забыл, что апгрейднул сервер с 64 до 128 гб оперативы, старые планки по 16 были single rank, а новые по 32 - dual rank.

nvidia.com/ru-ru/autonomous-machines/embedded-systems/jetson-agx-xavier/

developer.nvidia.com/embedded/jetson-modules

Всё таки приблуды от nvidia для этих целей лучше подойдут, если 512 маловато, то там есть на 2048 (Jetson AGX Orin 64 Gb)

NVIDIA Jetson Xavier Series

It’s the next evolution in next-generation intelligent machines.www.nvidia.com

а теперь, кажется, я совсем точно понял, в чём делотеперь я точно понял, в чём дело

да, можно, но это будет ОЧЕНЬ медленно, или модель будет очень тупая.Dread Pirate Roberts спасибо за хорошую инфу. Прочитал в твоем ответе о том, что допустимо запускать большие модели, если оперативки меньше, чем вес модели (без дискретной видяхи), если использовать ссд в качестве оперативного стореджа для модели во время использования (но ьудет медленно). В силу этого вопрос - как это можно реализовать на винде, а в идеале в чем-то похожем на lm studio.

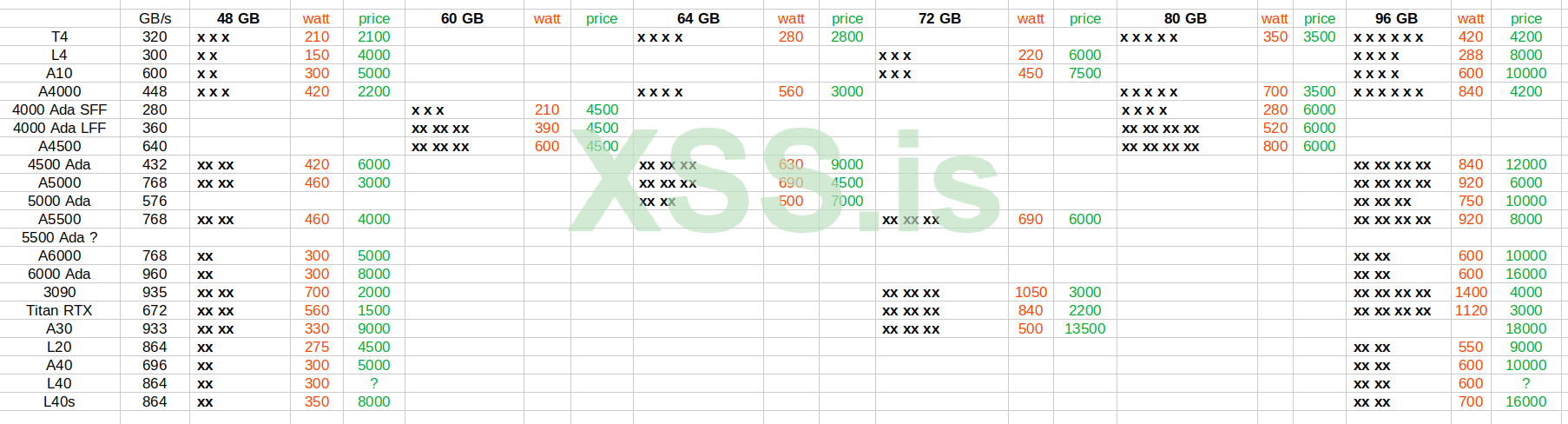

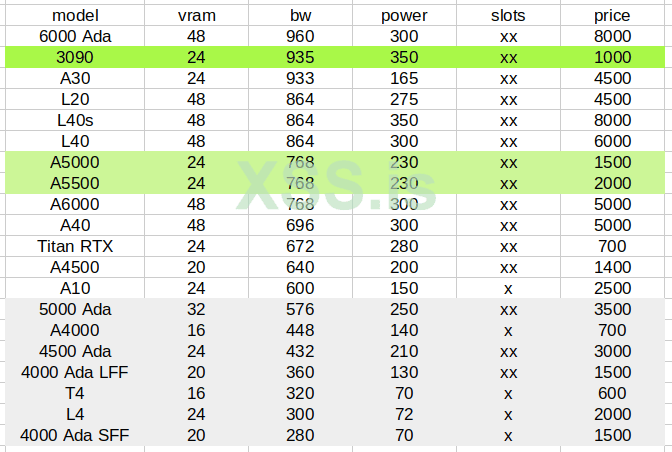

| Tesla T4 | 16 | 320 | 70 | 700 |

| L4 | 24 | 300 | 72 | 2500 |

| A10 (не путать с A10G) | 24 | 600 | 150 | 2500 |

| RTX 4000 Ada | 20 | 360 | 130 | 1500 |

| RTX A4000 | 16 | 448 | 140 | 800 |

| A2 | 16 | 200 | 60 | 700 |

| неведомая GALAX single slot RTX 4060Ti | 16 | 288 ??? | 165 ??? | ??? |

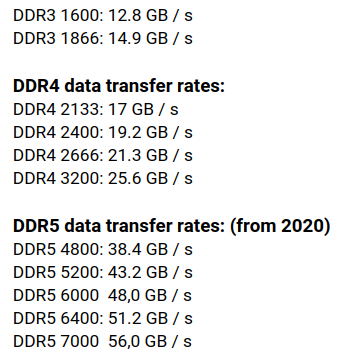

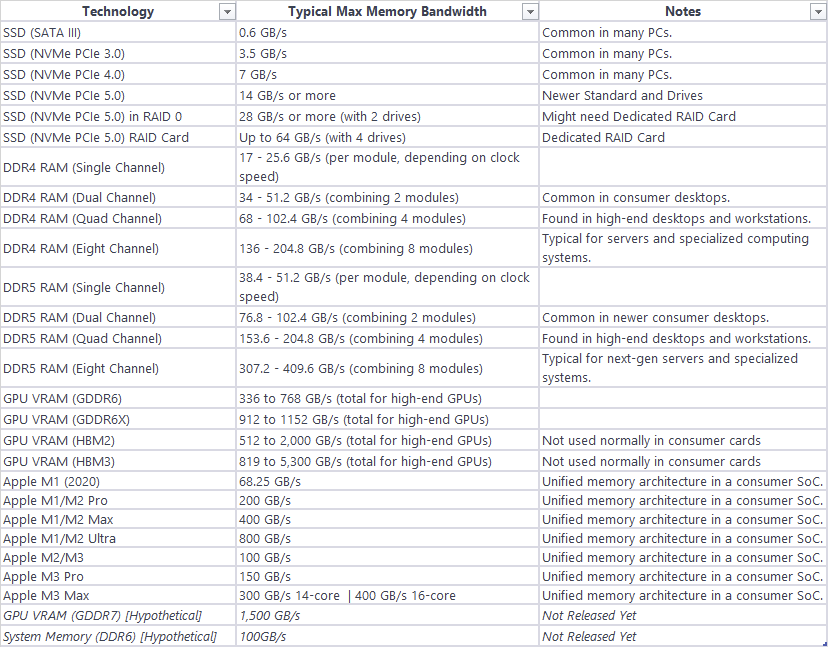

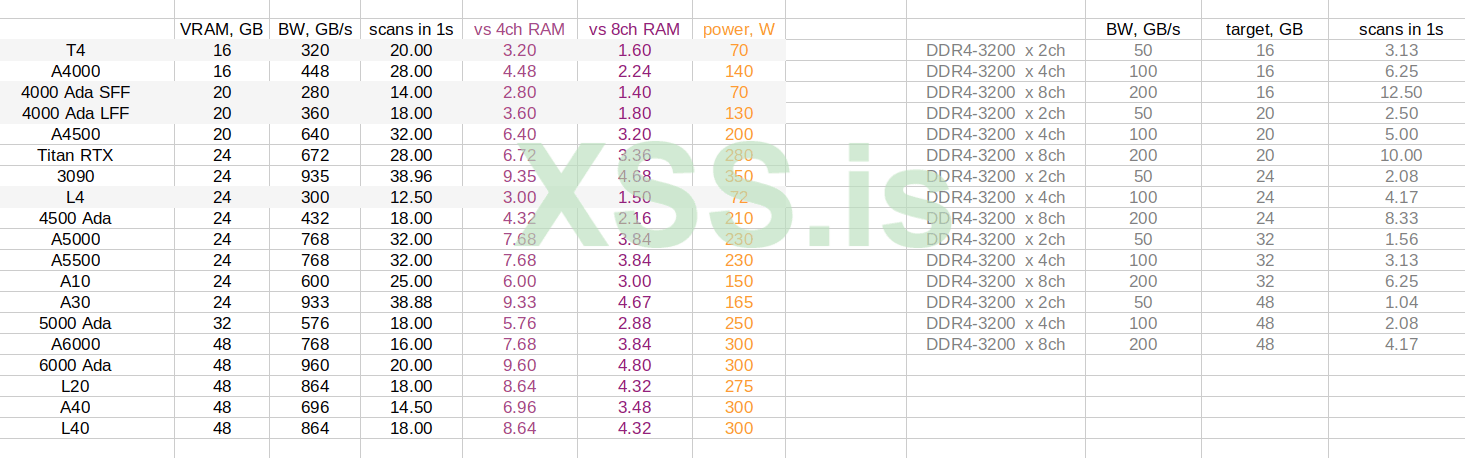

пока что 64 GB DDR4-3200 Dual Channel RAM (51.2 GB/s).Dread Pirate Roberts а какой конфиг ты юзаешь (наиболее интересны объем vram и ram) и какие модели (в идеале названия+сколько млрд параметров) на нем запускаешь?

подумываю насчёт 2x L4 или 3x T4 (300 GB/s), но не уверен, что это выйдет дешевле и намного быстрее, чем собрать новый сервер на AMD EPYC с Quad/Eight Channel RAM (100/200 GB/s) и запускать модели без видюхи, в оперативе. вот 2х A10 точно выйдет быстрее, но точно не дешевле.

модели пока никакие, хочу гонять дикпик 2бит (~250 GB) и ламу3 70Б 4/8бит (40/80GB)

| A10G | 24 | 600 | 150 | 2500 |

| A30 | 24 | 933 | 165 | 4500 |

| RTX 3090 | 24 | 935 | 350 | 1000 |

| L20 | 48 | 864 | 275 | 4500 |

| A40 | 48 | 696 | 300 | 5000 |

| Titan RTX | 24 | 672 | 280 | 800 |

учитывая низкую скорость L4, лучше брать A10, благо они стоят примерно одинаково - $2500итого топ за свои деньги - 4х Tesla T4, но если у вас есть такая возможность - лучше брать 3х или 4х L4.

составил таблицу, сколько места будут занимать видюхи, сколько электричества потреблять и сколько стоить, в зависимости от желаемого суммарного объёма VRAM.варианты двухслотовых карт: модель | VRAM GB | BW GB/s | TDP W | примерная цена в долларах

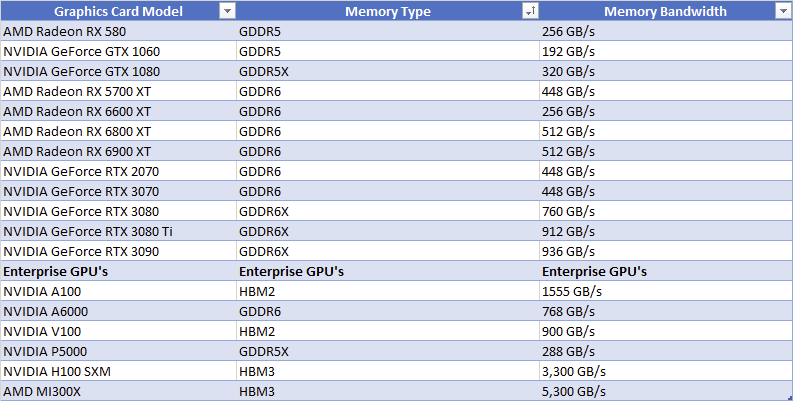

сравнил скорости видюх с оперативой, пришёл к неутешительному выводу: T4 - фигня, и даже казавшаяся перспективной L4 - фигня, потому что у них скорость меньше чем в 2 раза выше, чем у восьмиканальной оперативы DDR4-3200.всё ещё не уверен, что покупка нескольких видюх имеет смысл, учитывая то, что у оперативы DDR4-3200, подключённой к восьмиканальному процессору, суммарный bandwidth = 200 GB/s.

я узнал, что Epyc 4 с самой медленной оперативой DDR5-4800 уже вплотную подбирается к топовым видеокартам, а с быстрой оперативой даже превосходит.

я узнал, что Epyc 4 с самой медленной оперативой DDR5-4800 уже вплотную подбирается к топовым видеокартам, а с быстрой оперативой даже превосходит.

а исходя из вышесказанного A4000 и даже A10 не представляют особого интереса.интерес представляют только A10, внезапно старая A4000 (нвидия зачем-то урезала bandwidth на более новых картах), 3090 и старый Титан RTX (остальные карты отпадают из-за их высокой стоимости)

представляется, 4-битный Deepseek R1 выдаёт около 8 токенов в секунду на Epyc 4 с DDR5-4800:запуск нормальных (крупных и умных) моделей в домашних условиях не представляется возможным.

Epyc 9374F

12 x Samsung M321R4GA3BB6-CQK 32GB DDR5 RDIMMs

Asus K14PA-U12 motherboard

с бюджетом около $5000 можно собрать комп, выдающий приемлемую скорость (10-20 токенов в секунду) с LLaMa 3.3 70B, ужатой до 8 бит, и размером 75 гигабайт.

запуск даже самого тупого и ужатого до 1.5 бит дикпика размером 250 гигабайт потребует вложений больше $10k, чтобы получить скорость хотя бы около 10 токенов в секунду.

а запуск относительно нормального 4-битного дикпика размером 420 гигабайт могут себе позволить только брутеры кошельков, у которых дома кластеры из компов с 8х3090 в каждом.

да, обязательно надо читать документацию к серверу, обычно чем больше планок оперативы втыкаешь, тем медленнее скорость - типа с 1-2 планками DDR4-3200, а с 4-8 уже DDR4-2133.память 3200 на многих серверных платах работает как 2666, они больше не умеют