Сильно ногами пинать не надо, прошу совет. Собственно как и чем лучше просканировать с десяток сайтов на наличие базовых дыр? Максимально эффективно и желательно бесплатно. За дельные советы заранее благодарен!

-

XSS.stack #1 – первый литературный журнал от юзеров форума

Как и чем лучше просканировать с десяток сайтов на наличие базовых дыр?

- Автор темы jay56

- Дата начала

Пожалуйста, обратите внимание, что пользователь заблокирован

Acunetix

На форуме лежит

На форуме лежит

Сильно ногами пинать не надо, прошу совет. Собственно как и чем лучше просканировать с десяток сайтов на наличие базовых дыр? Максимально эффективно и желательно бесплатно. За дельные советы заранее благодарен!

Zed Attack Proxy - free and quite simple in use, good for new to pentesting

acunetix, arachni, netsparker, burp enterprise

Пожалуйста, обратите внимание, что пользователь заблокирован

да акунетикс самое то будет для новичка)acunetix, arachni, netsparker, burp enterprise

Для начало рекомендую нуклеем пройтись. Хороший сканер и темплейты часто пополняются. После каждый сайт окунём прогнать.

https://github.com/projectdiscovery/nuclei

https://github.com/projectdiscovery/nuclei

Лучше сразу все существующие сканнеры запустить, что-бы засрать логи на таргете и админ начал чекать все скрипты/директории в которые вы ломитесь.

Поработать руками и головой видимо ни кто так и не предложит. SQLi, SSTI и прочие вульны очень часто не детектятся сканнерами, но прекрасно детектятся и эксплуатируются руками. Буквально на днях прогонял таргет нетспаркером, бурпом, акунетиксом (поочередно), результат - 0 SQLi. Полез руками тыкать параметры, натыкал 2 инъекции всего за 10 минут. И так практически всегда - сканнеры много чего не детектят, в силу того что пейлоады у них стандарные, старые, без обходов WAF, без изюминки, проще говоря.

Поработать руками и головой видимо ни кто так и не предложит. SQLi, SSTI и прочие вульны очень часто не детектятся сканнерами, но прекрасно детектятся и эксплуатируются руками. Буквально на днях прогонял таргет нетспаркером, бурпом, акунетиксом (поочередно), результат - 0 SQLi. Полез руками тыкать параметры, натыкал 2 инъекции всего за 10 минут. И так практически всегда - сканнеры много чего не детектят, в силу того что пейлоады у них стандарные, старые, без обходов WAF, без изюминки, проще говоря.

Я так понимаю он тоже SQL находит?Для начало рекомендую нуклеем пройтись. Хороший сканер и темплейты часто пополняются. После каждый сайт окунём прогнать.

https://github.com/projectdiscovery/nuclei

а у тебя какие то пэйлоады для рук с "изюминкой" или нестандартные и новые, на тысячелетних багах? ))) Что нельзя настроить при скане рулезами?Лучше сразу все существующие сканнеры запустить, что-бы засрать логи на таргете и админ начал чекать все скрипты/директории в которые вы ломитесь.

Поработать руками и головой видимо ни кто так и не предложит. SQLi, SSTI и прочие вульны очень часто не детектятся сканнерами, но прекрасно детектятся и эксплуатируются руками. Буквально на днях прогонял таргет нетспаркером, бурпом, акунетиксом (поочередно), результат - 0 SQLi. Полез руками тыкать параметры, натыкал 2 инъекции всего за 10 минут. И так практически всегда - сканнеры много чего не детектят, в силу того что пейлоады у них стандарные, старые, без обходов WAF, без изюминки, проще говоря.

SSTi \ OSCi да и вообще SSi детектить руками - такое себе, изящный способ самоубийства. У каждого сервака свои особенности, win, nix (iis,apache,nginx). Особенно весело, если сервак работает за прокладкой (nginx proxy напр.) и ты не знаешь, что за ней. Все варианты будешь перебирать руками, под каждый включительно? Плюсом надо отлавливать респонзы на своем стороннем сервере, а то ты надетектишь (фоллсов), плюсом надо еще отлавливать фидбэки на DNS channel, и особо интересно, как ты отлавилвать руками delay (sleep) будешь. Особенно за vpn и тором \ носками, с неустойчивым соединением, а большие значения недопустимы. С секундомером сидеть?

А так да, ты прав, руками действительно надо работать, и много. Но это скорее относится к проверить уже найденную багу (а не совать свою кавычку везде), обойти ваф, понять причину, почему не эксплуатируется, найти ошибку в запросе, прочекать нестандартные варианты, etc. для дальнейшей автоматизации рутины. Всё ты руками один х не сделаешь.. И овердохyя уязвимостей руками без кучи итераций детектить не получится, физически. Новичку советовать "руками" чекать десяток сайтов, когда он еще очень слабо ориентируется - опрометчиво.

А на твоем месте я бы берп натравил на эти же параметры (раз ты догадался их руками проверять, значит было подозрение конкретно на них) с backslash powered scanner плагином и все. Ну можно еще error message checks плюсом (советую вместе использовать, хорошие регулярки) Детект скули, или как минимум interested output \ iterable input в 99% случаев, и сразу видно, где скуля. Ни разу не было, чтобы мне берп с плагинами и рулезами не указывал на ту же скулю. Голый берп да, шляпа, ни рыба ни мясо. Тогда уж лучше что нибудь от invicti.Так же посоветую arjun софтину, для детекта параметров, т.к. у многих скриптов на таргете даже при полном крауле и отсылке руками всех параметров во все возможные места, ты можешь просто не увидеть GET/POST, неявные XML/JSON/HEADERS точки вставки, А он сразу отошлет в берп найденные (логическим перебором). Скажем, некий test.php\aspx, обращается к тестовой таблице в бд, и выводит тебе в 200 - Good. Хз что он там передает, руками будешь чекать имена переменных? А там в 80% случаев скуля. Просто пример. В общем рукаами всё проверить нереально, а вот определенные параметры, на заданные баги (кот. ты подозреваешь), с твоими рулезами - вполне. Но да, опять же до скана, и опять же, расчитывать исключительно на сканер или исключительно на руки - глупо. Надо комбинировать.

Нетспаркером, акунетиксом - одним и тем же ты считай прогнал. Вот почему именно они не детектят многое - тут я хз, это видимо особенности кряков. Нужны именно гибкие инструменты. Советую бёрп, с extensions

Да, он на шаблонах работает. Но шаблоны у него по скулям все равно считай из мапаЯ так понимаю он тоже SQL находит?

Тут:

nuclei-templates/vulnerabilities/generic/error-based-sql-injection.yaml at master · projectdiscovery/nuclei-templates

Community curated list of templates for the nuclei engine to find security vulnerabilities. - projectdiscovery/nuclei-templates

Код:

id: SQLInjection_ERROR

info:

name: SQLI

requests:

- method: GET

path:

- "{{BaseURL}}'"

- "{{BaseURL}} 1 or 1"

- "{{BaseURL}} %22%22|0;#"

- "{{BaseURL}} 1 or 1"

- "{{BaseURL}} ''"

- "{{BaseURL}} ' or#"

- "{{BaseURL}} ' OR '1"

- "{{BaseURL}} ' OR 1 -- -"

- "{{BaseURL}} %22 OR 1 = 1 -- -#"

- "{{BaseURL}} %22%22|0;#"

- "{{BaseURL}} OR 1=1"

- "{{BaseURL}} AND 1"

- "{{BaseURL}} AND 0"

- "{{BaseURL}} AND true"

- "{{BaseURL}} AND false"

- "{{BaseURL}} 1-false"

- "{{BaseURL}} 1-true"

- "{{BaseURL}} 1*56"

- "{{BaseURL}} -2"

- "{{BaseURL}} 1' ORDER BY 1--+"

- "{{BaseURL}} 1' ORDER BY 2--+"

- "{{BaseURL}} 1' ORDER BY 3--+"

- "{{BaseURL}} 1' ORDER BY 1,2--+"

- "{{BaseURL}} 1' ORDER BY 1,2,3--+"

- "{{BaseURL}} 1' GROUP BY 1,2,--+"

- "{{BaseURL}} 1' GROUP BY 1,2,3--+"

- "{{BaseURL}} ' GROUP BY columnnames having 1=1 --"

extractors:

- type: regex

part: body

regex:

- "SQL syntax.*MySQL|Warning.*mysql_.*|valid MySQL result|MySqlClient.|mysqli_error|mysqli_query"

- "PostgreSQL.*ERROR|Warning.*Wpg_.*|valid PostgreSQL resultNpgsql."

# - "Driver.* SQL[-_ ]*Server|OLE DB.* SQL Server|(W|A)SQL Server.*Driver|Warning.*mssql_.*|(W|A)SQL Server.*[0-9a-fA-F]{8}|(?s)Exception.*WSystem.Data.SqlClient.|(?s)Exception.*WRoadhouse.Cms.)"

- "Microsoft Access Driver|JET Database Engine|Access Database Engine"

- "ORA-[0-9][0-9][0-9][0-9]|Oracle error|Oracle.*Driver|Warning.*Woci_.*|Warning.*Wora_.*"

- "CLI Driver.*DB2|DB2 SQL error|bdb2_w+"

- "SQLite/JDBCDriver|SQLite.Exception|System.Data.SQLite.SQLiteException|Warning.*sqlite_.*|Warning.*SQLite3::|SQLITE_ERROR"

- "(?i)Warning.*sybase.*|Sybase message|Sybase.*Server message.*"Только после {{BaseURL}} пихаешь свои payloads, а после regex:свои регулярки для детекта. Но лучше тогда уж мапом, если отдельно по скулям ))) Или собрать свой отличный шаблон из мапа, своих наработок, или со своими prefix \ sufix под вафы

Кстати для берпа есть годный генератор шаблонов под nuclei тут:

GitHub - projectdiscovery/nuclei-burp-plugin: Nuclei plugin for BurpSuite

Nuclei plugin for BurpSuite. Contribute to projectdiscovery/nuclei-burp-plugin development by creating an account on GitHub.

nuclei отличный инструмент, для чека на уже известные cve, они там с 2000-х собраны.

nuclei-templates/cves at master · projectdiscovery/nuclei-templates

Community curated list of templates for the nuclei engine to find security vulnerabilities. - projectdiscovery/nuclei-templates

Бля, как же лень отвечать такими же простынями. Постараюсь вкратце.а у тебя какие то пэйлоады для рук с "изюминкой" или нестандартные и новые, на тысячелетних багах? ))) Что нельзя настроить при скане рулезами?Или ты не зная какой WAF на таргете, сразу руками на месте багу одним запросом эксплуатируешь со своим универсальным обходом\обфусцированным пэйлоадом? Так сканеров задача уязвимость задетектить, а не раскрутить, и ваф тут особой роли играть не будет. Если он некие запросы с полезной нагрузкой в 403 (допустим) отправляет, тут и слепому видно станет (не в случае с акунетиксом), что там ваф. Да и ваф детектить надо еще до скана, на уровне разведки по таргету. Плагинами, руками, сторонним софтом (ex. wafw00f и т.д.).

SSTi \ OSCi да и вообще SSi детектить руками - такое себе, изящный способ самоубийства. У каждого сервака свои особенности, win, nix (iis,apache,nginx). Особенно весело, если сервак работает за прокладкой (nginx proxy напр.) и ты не знаешь, что за ней. Все варианты будешь перебирать руками, под каждый включительно? Плюсом надо отлавливать респонзы на своем стороннем сервере, а то ты надетектишь (фоллсов), плюсом надо еще отлавливать фидбэки на DNS channel, и особо интересно, как ты отлавилвать руками delay (sleep) будешь. Особенно за vpn и тором \ носками, с неустойчивым соединением, а большие значения недопустимы. С секундомером сидеть?

А так да, ты прав, руками действительно надо работать, и много. Но это скорее относится к проверить уже найденную багу (а не совать свою кавычку везде), обойти ваф, понять причину, почему не эксплуатируется, найти ошибку в запросе, прочекать нестандартные варианты, etc. для дальнейшей автоматизации рутины. Всё ты руками один х не сделаешь.. И овердохyя уязвимостей руками без кучи итераций детектить не получится, физически. Новичку советовать "руками" чекать десяток сайтов, когда он еще очень слабо ориентируется - опрометчиво.

А на твоем месте я бы берп натравил на эти же параметры (раз ты догадался их руками проверять, значит было подозрение конкретно на них) с backslash powered scanner плагином и все. Ну можно еще error message checks плюсом (советую вместе использовать, хорошие регулярки) Детект скули, или как минимум interested output \ iterable input в 99% случаев, и сразу видно, где скуля. Ни разу не было, чтобы мне берп с плагинами и рулезами не указывал на ту же скулю. Голый берп да, шляпа, ни рыба ни мясо. Тогда уж лучше что нибудь от invicti.Так же посоветую arjun софтину, для детекта параметров, т.к. у многих скриптов на таргете даже при полном крауле и отсылке руками всех параметров во все возможные места, ты можешь просто не увидеть GET/POST, неявные XML/JSON/HEADERS точки вставки, А он сразу отошлет в берп найденные (логическим перебором). Скажем, некий test.php\aspx, обращается к тестовой таблице в бд, и выводит тебе в 200 - Good. Хз что он там передает, руками будешь чекать имена переменных? А там в 80% случаев скуля. Просто пример. В общем рукаами всё проверить нереально, а вот определенные параметры, на заданные баги (кот. ты подозреваешь), с твоими рулезами - вполне. Но да, опять же до скана, и опять же, расчитывать исключительно на сканер или исключительно на руки - глупо. Надо комбинировать.

Нетспаркером, акунетиксом - одним и тем же ты считай прогнал. Вот почему именно они не детектят многое - тут я хз, это видимо особенности кряков. Нужны именно гибкие инструменты. Советую бёрп, с extensions

- Например еще в июне я наковырял методом "тыка" пейлоады под sleep вектор, для двух СУБД, пейлоад с обходом WAF CF (Enterprise). В паблике где-либо их нет, и они до сих пор работают у меня. Это и это, а так же масса других вариантов не работали, я проверил каждый. Баги могут быть хоть со времен динозавров, но донести рабочий пэйлоад до таргета через WAF довольно таки проблематично бывает.

- Настроить правилами при скане? А как это сделать например в нетспаркере? Или акунетиксе? Ни как. Ставил я недавно PGADMIN и подключался к локальной БД окуня, там х#й голову сломит, я часа 2 провозился, так и не нашел где что менять, и судя по всему через БД ничего не поменять.

- Если я не могу определить что за ваф на таргете, да, я пихаю свой пэйлоад который юзаю под CF. Если он не работает то начинаю перебирать варианты с тех двух ссылок которые выше скинул. Если и они не работают то начинаются эксперименты, с разными кодировками и прочими приблудами/комбинациями.

- На большинстве таргетов с которыми я сталкиваюсь - рейт лимиты, капчи, бот-файт моды, JS челленджи. Хyй их чем просканишь. Уважающие себя конторы имеют защиту от этого. Сайты которые можно сканировать часами и тысячами запросов - это задроченный мусор который с огромной вероятностью уже кем-либо просканен и выжат досуха, если есть/были какие-то баги). Поэтому я уже привык стирать пальцы и клавитуру задрачивая руками один сайт по несколько дней. Да и чувства совсем другие, когда ты сделал все сам, я передать не могу, у кого было тот поймет. Часто получается "заходить" через поддомены, т.к. они редко защищаются так жестко, и многие можно без проблем сканить и вообще процесс атаки автоматизировать. Но тут палка о двух концах, там уже возможно кто-то побывал до тебя.

- Все сделать руками невозможно, с этим согласен, но когда дают таргет который невозможно сканить (выше написал почему) и $ + 2 недели времени с задачей получить доступ к БД или залить шелл, то выхода нет, приходится только так. Процент успешного выполнения таких задач невысок, лично у меня.

- У меня часто бывают ситуации, когда окунь, бурп, нетспаркер не детектят вульну там где она есть, даже на таргете без вафа. Я знаю что она там есть и при 1"));waitfor delay '0:0:10'-- в определенном месте будет задержка, но сканнеры ни чего не видят в этом же месте, я смотрю по логам что они парсили эту страницу/параметр и пихали туда свой пейлоад, но детекта нет. Софт весь лицензионный кроме окуня. Поэтому как говорится, на сканнер надейся, а сам не плошай.

- Кароче я не знаю зачем мы тут все это пишем, большинству похую. Запустил софтину, линк вставил, нажал старт и пошел чай пить.

Я тогда еще был бодр и свеж.Бля, как же лень отвечать такими же простынями

Вообще ты уже все сказал тут:

100%Кароче я не знаю зачем мы тут все это пишем, большинству похую.

Я кстате тоже удивлялся, почему одна версия нетспаркера нормальна нашла а потом через апдейт сего перестало находить sql/xss.У меня часто бывают ситуации, когда окунь, бурп, нетспаркер не детектят вульну там где она есть, даже на таргете без вафа. Я знаю что она там есть и при 1"));waitfor delay '0:0:10'-- в определенном месте будет задержка, но сканнеры ни чего не видят в этом же месте, я смотрю по логам что они парсили эту страницу/параметр и пихали туда свой пейлоад, но детекта нет. Софт весь лицензионный кроме окуня. Поэтому как говорится, на сканнер надейся, а сам не плошай.

Бля да вы что мужики! Были бы здесь такие полезные диспуты под каждым постом.Кароче я не знаю зачем мы тут все это пишем, большинству похую.

ага, какие-то даже на статью потянутБля да вы что мужики! Были бы здесь такие полезные диспуты под каждым постом.

- Кароче я не знаю зачем мы тут все это пишем, большинству похую.

Что значит похую. После Ваших матерых дискуссий вдохновение приходит)

Автор указал "максимально эффективно и желательно бесплатно", и не указал какие именно сайты собирается проверять. Может в этот десяток входят вебки коммерческих продуктов (Confluence, Jira, Gitlab и т.д.), разные CMS или веб-сервера (iis, nginx и не говоря еще о бесчисленных продуктов Apache), которые, в первую очередь, лучше быстро проверить на все известные cve. А в нуклее их много) И да, руками работать надо и мноого. А в случае с самописанной вебкой, не надо, а нужно)) Но руками весь скоуп сразу и эффективно проверить невозможно. + вебки постоянно меняются, появляются новые хосты, цикл разработки бесконечен))Лучше сразу все существующие сканнеры запустить, что-бы засрать логи на таргете и админ начал чекать все скрипты/директории в которые вы ломитесь.

Поработать руками и головой видимо ни кто так и не предложит. SQLi, SSTI и прочие вульны очень часто не детектятся сканнерами, но прекрасно детектятся и эксплуатируются руками. Буквально на днях прогонял таргет нетспаркером, бурпом, акунетиксом (поочередно), результат - 0 SQLi. Полез руками тыкать параметры, натыкал 2 инъекции всего за 10 минут. И так практически всегда - сканнеры много чего не детектят, в силу того что пейлоады у них стандарные, старые, без обходов WAF, без изюминки, проще говоря.

Полностью с вами согласен. Нужно комбинировать. А если работать на качесво, в случае с самописанными вебками, их нужно для начало полностью изучить - анализировать трафик, фронт. На основе этого уже можно будет узнавать, работает ли вебка с шаблонизаторами или с участием клаент сайт рендеринга, собираешь ендпоинты, апи эндпоинты и начинаешь их фазить на SQLi, NoSQLi, XSS, SSTI, Path Traversl, SSRF и т.д. + не забываем о XXE и файл аплоуд с вызовом их, если, конечно, присутствует подходящий функционал.Но да, опять же до скана, и опять же, расчитывать исключительно на сканер или исключительно на руки - глупо. Надо комбинировать.

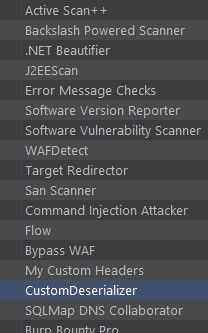

Советую бёрп, с extensions

Также отдельно хочу ометить Burp Bounty Pro. Вообще топовая вещь. А новичкам дает понимание, куда целится и чем фазить. Для начало можно отталкиваться от присутствующих профайлов, а со временем они будут изменяться и пополняться, в зависимости от накопленных знаний.

Также отдельно хочу ометить Burp Bounty Pro. Вообще топовая вещь. А новичкам дает понимание, куда целится и чем фазить. Для начало можно отталкиваться от присутствующих профайлов, а со временем они будут изменяться и пополняться, в зависимости от накопленных знаний.Кароче я не знаю зачем мы тут все это пишем, большинству похую

Нет, наоборот есть новички, как я, которые читают ваши посты и подчеркивают для себя многое, и учаться на этом. Спасибо вам большое!100%

если не секрет, плагины какие?берп с плагинами и рулезами

activescan++если не секрет, плагины какие?

J2EEScan

.NetBeautifier

Error Message Checks

Software Vulnerability Scanner

Backslash Powered Scanner

Их очень много. Какие то всегда включены, какие то свои, какие то - в зависимости от текущих задачесли не секрет, плагины какие?

Из стандартных, как минимум, хотя бы эти:

UPD: Turbo Intruder на скрин не попал + nuclei template. Это те, что включены на данный момент. Сорри, но руками мне лень переписывать. Прийдется самому.

Да вообще дохера их, каждый под себя подбирает. Не получится тут какой то общий для всех набор составить. Некоторые допиливаешь сам, некоторые рулезов требуют и ставятся не из BApp Store (мануал), некоторых вообще еще нет нигде

Последнее редактирование: